本文对transformers之pipeline的问答(question-answering)从概述、技术原理、pipeline参数、pipeline实战、模型排名等方面进行介绍,读者可以基于pipeline使用文...

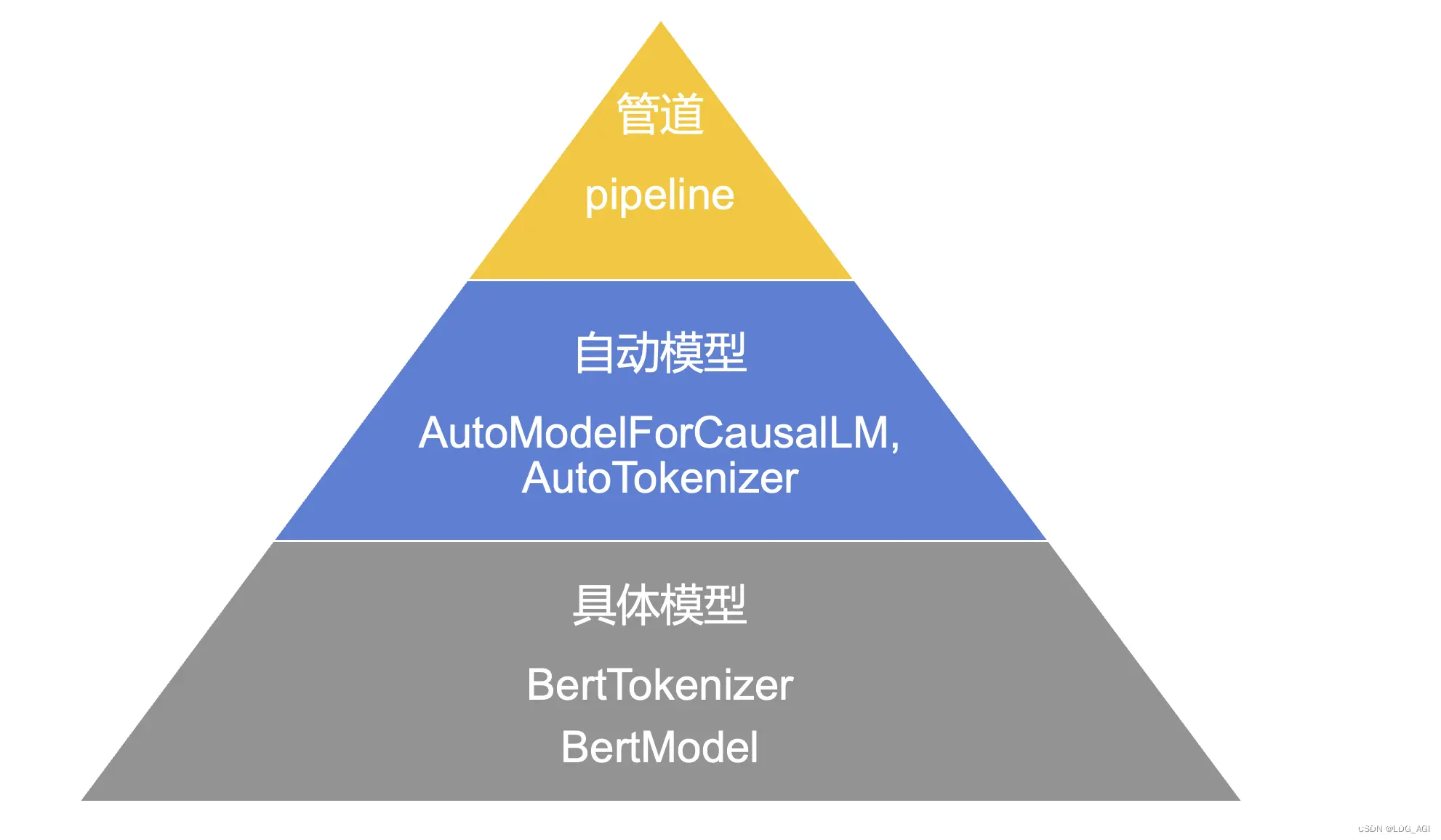

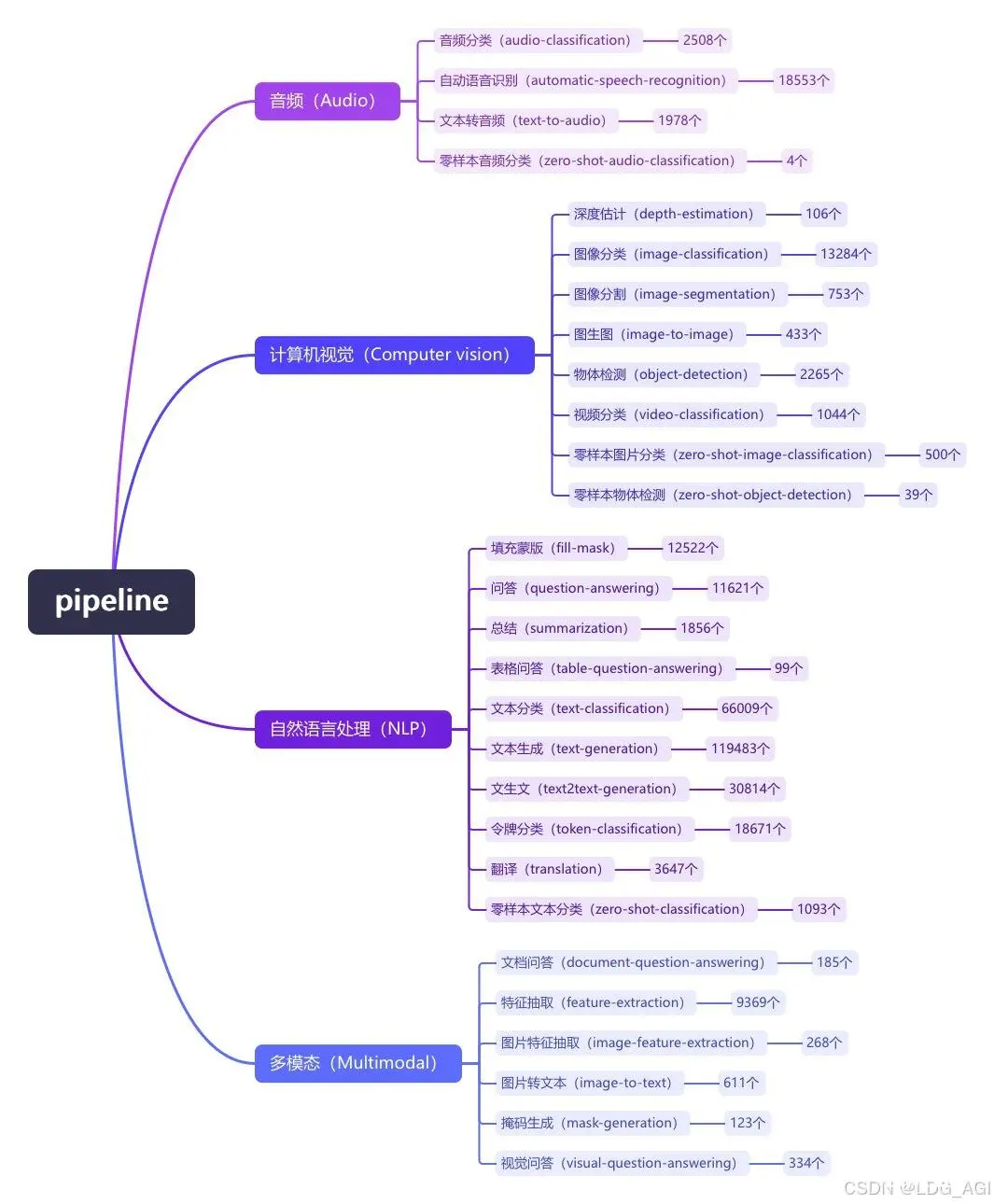

Transformers包括管道pipeline、自动模型auto以及具体模型三种模型实例化方法,如果同时有配套的分词工具(Tokenizer),需要使用同名调度。在上述三种应用方式中:管道方式使用最简单,但灵活...

本文对transformers之pipeline的填充蒙版(fill-mask)从概述、技术原理、pipeline参数、pipeline实战、模型排名等方面进行介绍,读者可以基于pipeline使用文中的2行代码极...

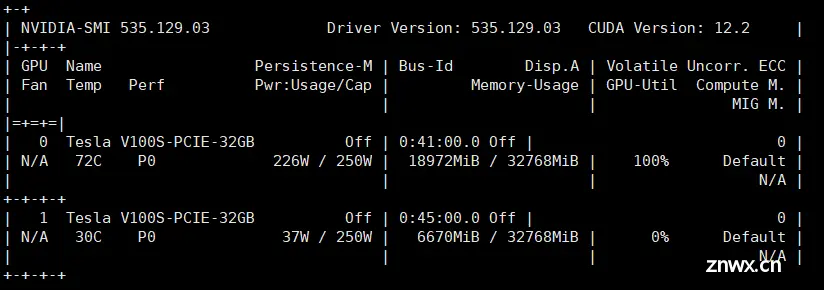

HuggingFace的库支持自动模型(AutoModel)的模型实例化方法,来自动载入并使用GPT、ChatGLM等模型。在方法中的device_map参数,可实现单机多卡推理。_transformer多卡推理...

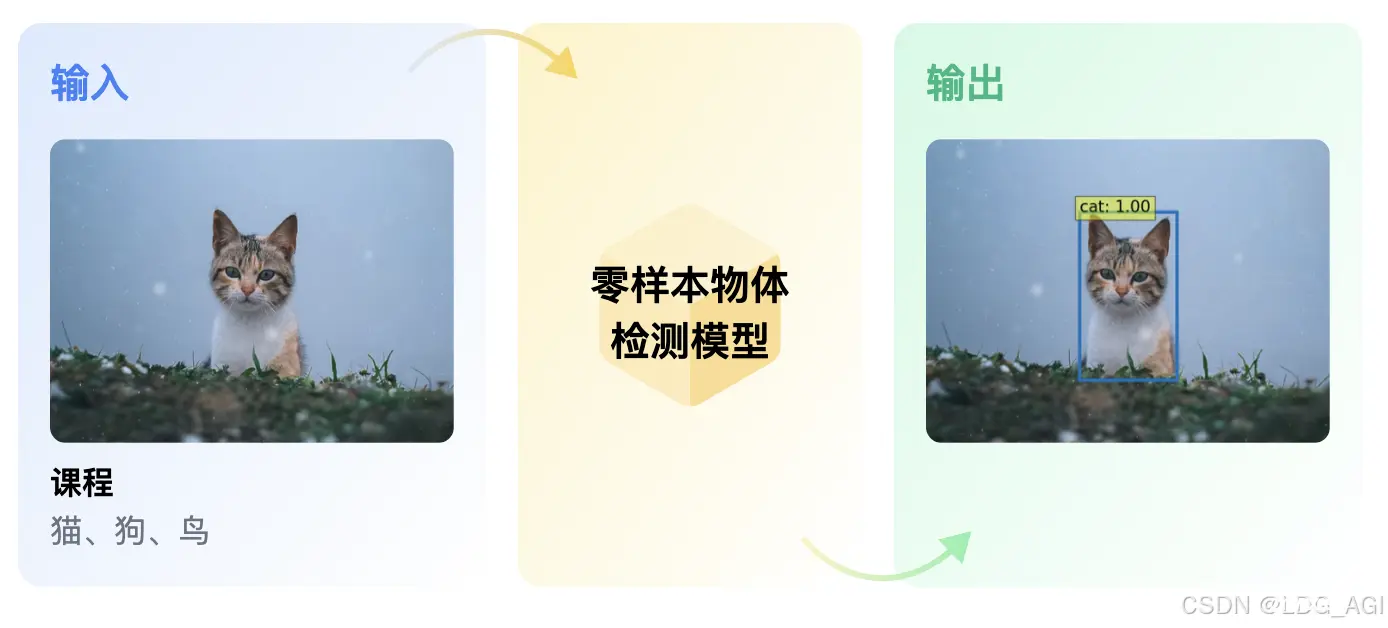

本文对transformers之pipeline的零样本物体检测(zero-shot-object-detection)从概述、技术原理、pipeline参数、pipeline实战、模型排名等方面进行介绍,读者可以...

本文对transformers之pipeline的零样本图片分类(zero-shot-image-classification)从概述、技术原理、pipeline参数、pipeline实战、模型排名等方面进行介...

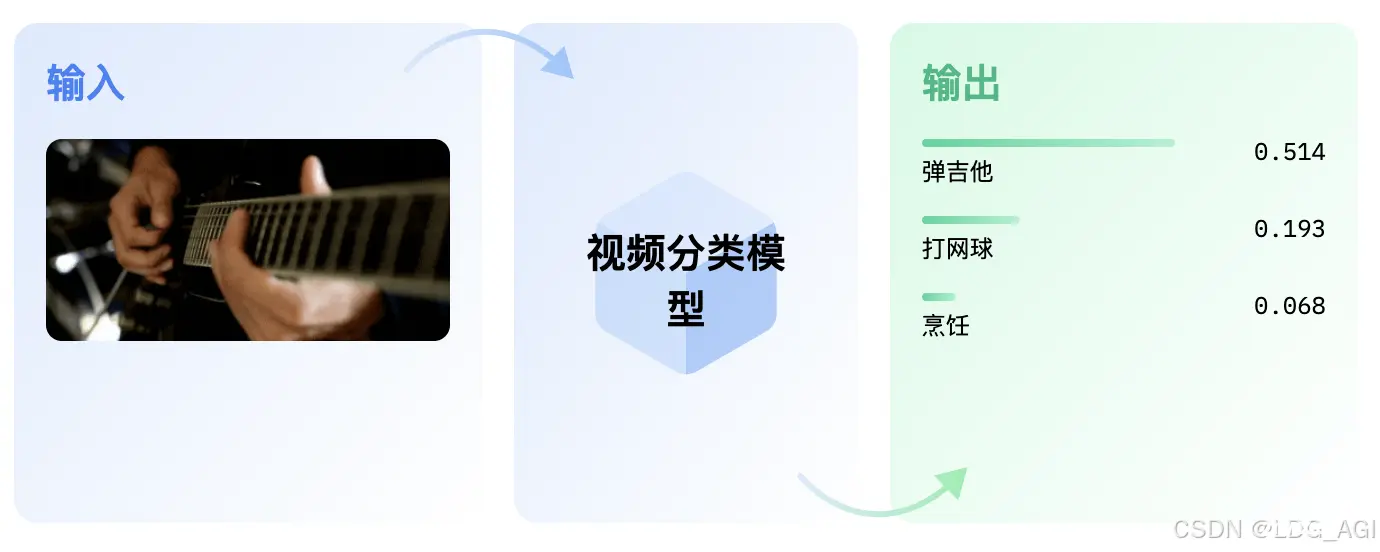

本文对transformers之pipeline的视频分类(video-classification)从概述、技术原理、pipeline参数、pipeline实战、模型排名等方面进行介绍,读者可以基于pipelin...

本文对transformers之pipeline的物体检测(object-detection)从概述、技术原理、pipeline参数、pipeline实战、模型排名等方面进行介绍,读者可以基于pipeline...

在HuggingFace的Transformers库中,Trainer类是一个强大的工具,用于训练和评估机器学习模型。它简化了数据加载、模型训练、评估和日志记录的过程。_transformers.trainer...

本文对使用transformers的AutoModelForCausalLM进行尝试,主要对CausalLM(因果推理模型)进行实例化,需要与同类的AutoTokenizer分词器一起使用。同时,列举了管道模型、...