在HuggingFace的Transformers库中,Trainer类是一个强大的工具,用于训练和评估机器学习模型。它简化了数据加载、模型训练、评估和日志记录的过程。_transformers.trainer...

希望这些提示词和技巧能够帮助你在Midjourney上创作出与众不同的AI绘画作品。无论你是想要创造引人注目的标题、独特的角色设计,还是精心构建的场景和情感表达,这些提示词都将为你提供丰富的灵感和支持。赶...

2024年,AI领域的发展日新月异,中国科学院自动化研究所、武汉人工智能研究院、360智脑、百度、百川智能、OpenAI等机构纷纷推出了新一代多模态大模型API服务,为用户提供了前所未有的AI体验。这些API服务支持...

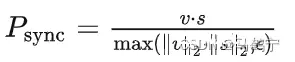

本文介绍了一种名为Wav2Lip的模型,它可以根据语音生成唇形同步的视频。这个模型是第一个通用的说话者模型,可以在真实世界的情况下进行应用。...

本文对使用transformers的AutoModelForCausalLM进行尝试,主要对CausalLM(因果推理模型)进行实例化,需要与同类的AutoTokenizer分词器一起使用。同时,列举了管道模型、...

不用写一行代码,只需要跟着步骤点点点,就可以完成task01!本笔记可视作学习手册速通指南的(无意义)扩充版本。灰色的备注是关于该步骤的解释和拓展,可以先跳过,等走完所有步骤再回头看!...

DatawhaleAI夏令营第四期魔搭-AIGC方向task01笔记及个人心得分享。从零入门AI生图原理&实践是Datawhale2024年AI夏令营第四期的学习活动(“AIGC”方向),基于魔搭...

第一步:将github项目中,PycharmProjects/Depix/images/searchimages/debruinseq.txt文件,复制到本地文本,截图后,放回PycharmProjects/Dep...

BiFormer(Bi-levelRoutingAttention)是一种新颖的注意力机制,它通过双层路由机制来捕捉局部和全局特征,从而提高模型的检测性能。其主要思想是在特征提取过程中,分别对局部特征和全局特征...

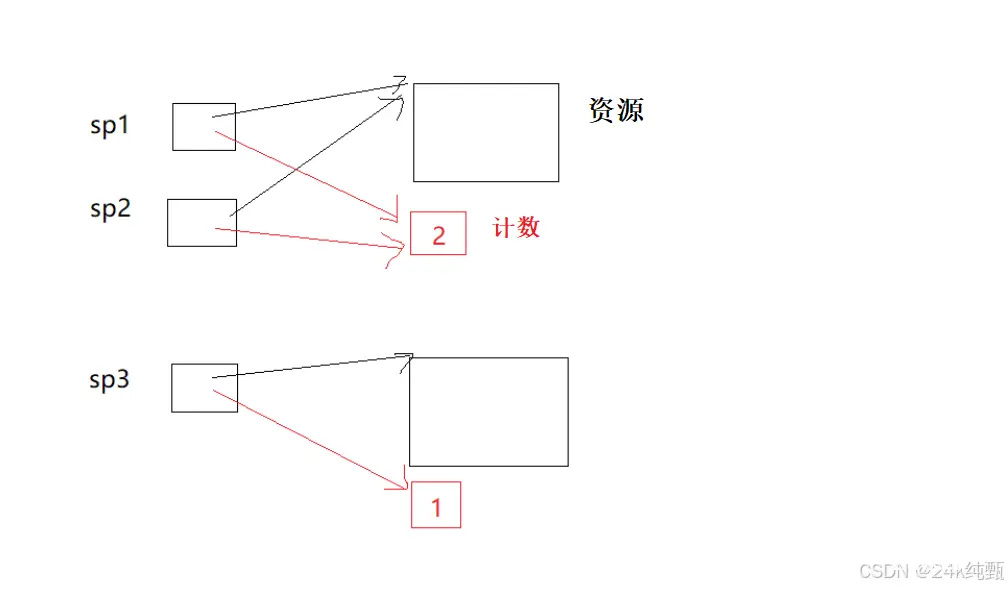

内存泄漏指因为疏忽或错误造成程序未能释放已经不再使用的内存的情况。内存泄漏并不是指内存在物理上的消失,而是应用程序分配某段内存后,因为设计错误,失去了对该段内存的控制,因而造成了内存的浪费。。...