用Ollama和OpenWebUI搭建你的私有ChatGPT!_couldnotconnecttoollamaapp,isitrunning?...

准备好linux和docker,随本文用最短的时间最少的步骤体验java版本的大模型应用_springaiollama...

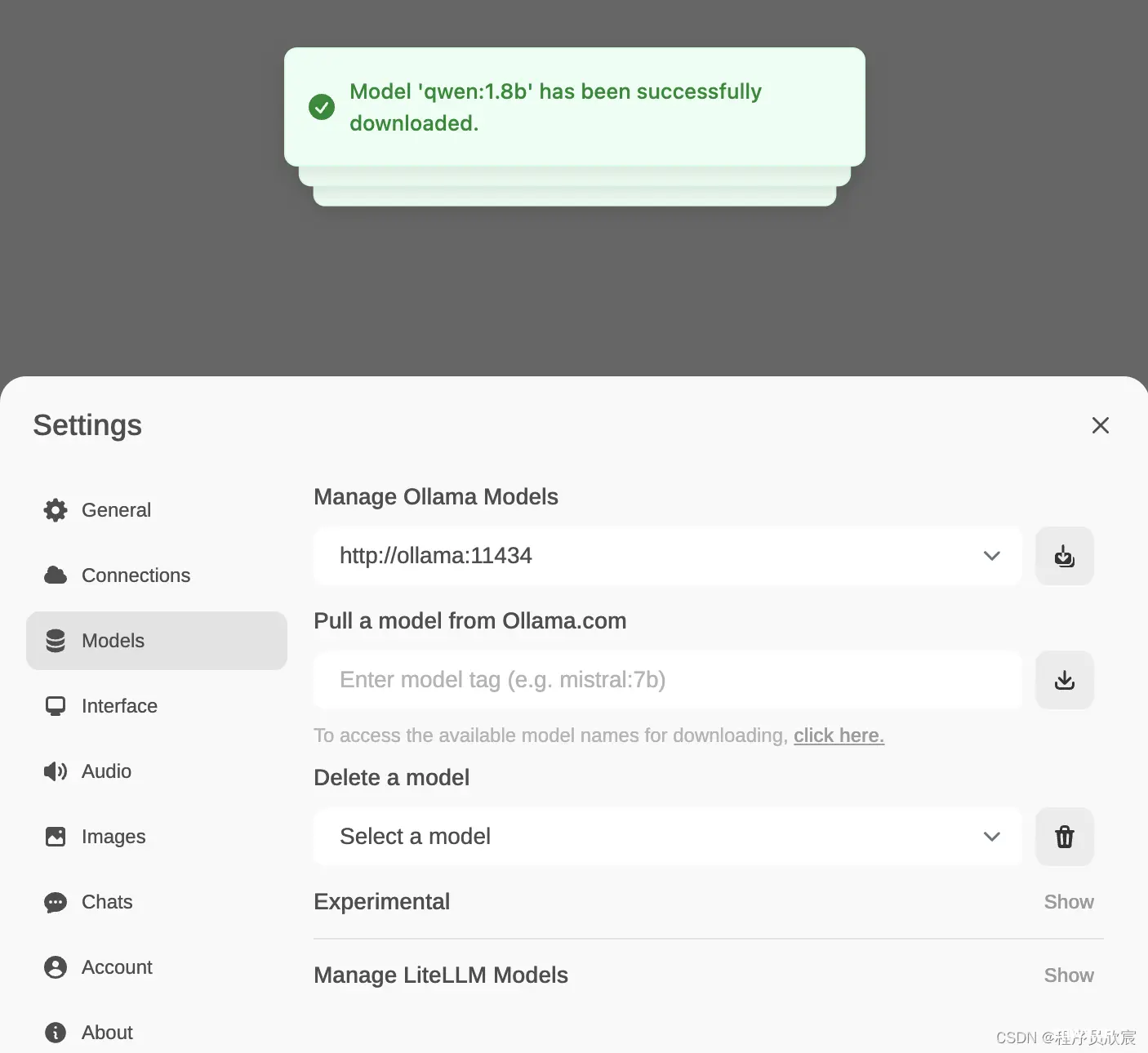

Ollama可以非常方便的管理和部署我们本地大语言模型,老牛同学希望通过本文对Ollama进行一次详细介绍,包括本地大模型管理和使用、WebUI对话界面部署、通过Python和Java使用Ollama的API接口等……...

本文介绍了如何使用LLaMAFactory框架,在ModelScope平台上对Yi-6B模型进行监督微调,包括环境配置、WebUI的使用、参数设置以及模型的训练、对话和合并过程。通过WebUI,用户可以直观地管理...

2024年4月18日,meta开源了Llama3大模型[1],虽然只有8B[2]和70B[3]两个版本,但Llama3表现出来的强大能力还是让AI大模型界为之震撼了一番,本人亲测Llama3-70B版本的推理...

在本地使用Docker部署LLMGGML模型是一种方便有效的使用自然语言处理的方式。将模型docker化使其易于在不同环境之间移动,并确保其能够一致运行。在浏览器中测试模型提供了用户友好的界面,让您可以快速评估其性...

docker部署ollama。_ollamadocker部署...

ollama是大模型部署方案,对应docker,本质也是基于docker的容器化技术。ollama提供了openAI兼容的api,可以最大限度的减少理解和开发成本。_ollama安装...

上述代码对于理解RAG系统中检索器部分的行为非常有用,它允许开发者或用户查看对于特定查询,系统究竟检索到了哪些文档,以及这些文档的具体内容和来源。由于这是一个自动化测试,查询的答案质量将取决于RAG系统中检索...

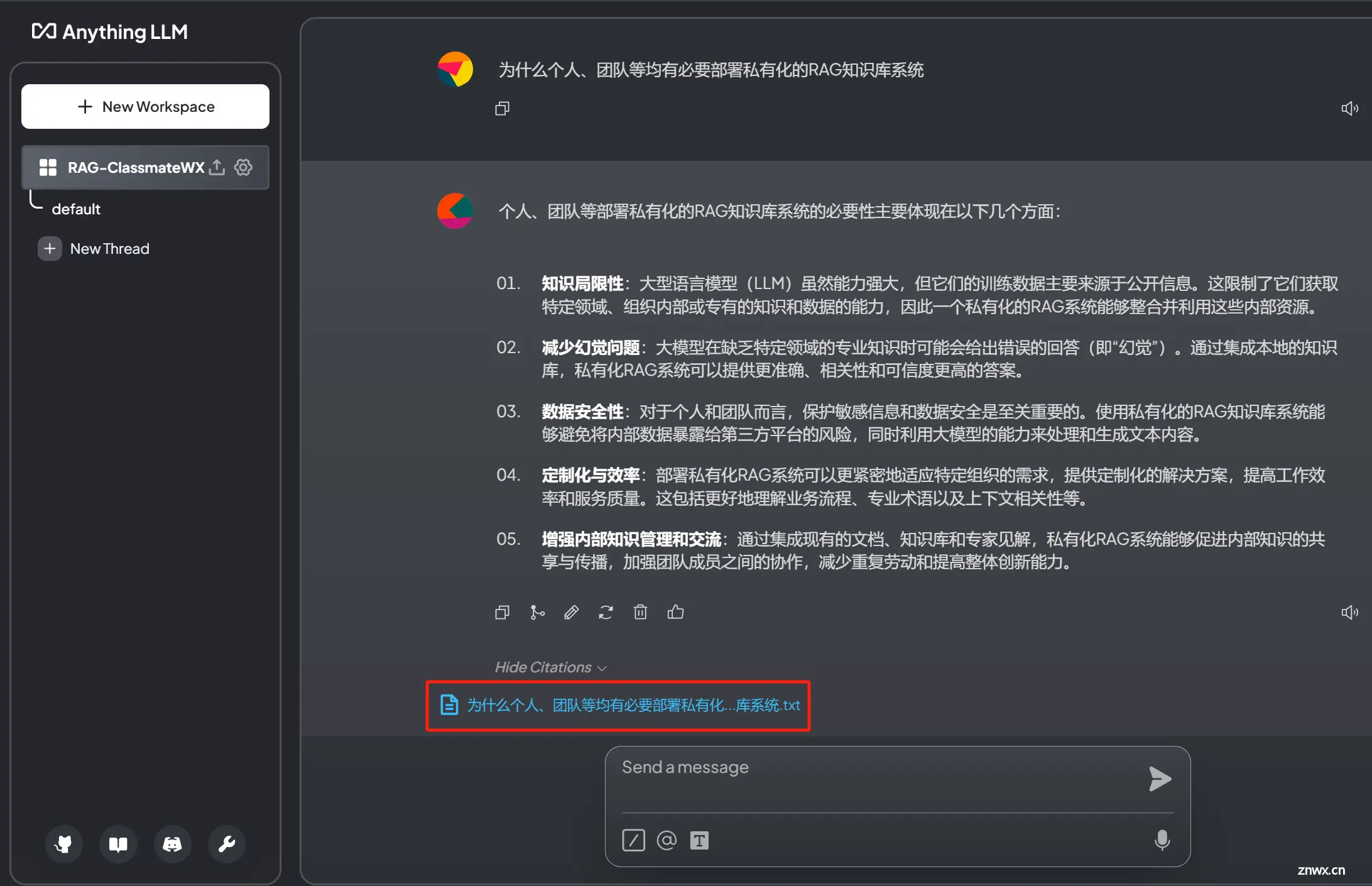

大语言模型在垂直细分领域存在知识局限、幻觉、数据安全等一些问题,可通过RAG(检索增强生成)方案来解决。本文基于AnythingLLM框架,搭建团队私有知识库系统,并进行使用和验证,RAG系统在保留输出的有效性同时,还保留了创造性……...