循环神经网络RNN)是一种专门为处理序列数据而设计的神经网络类型。序列数据在现实世界中非常常见,例如时间序列数据(如股票价格随时间的变化)、自然语言文本(单词的序列)等。与传统的前馈神经网络不同,RNN具有内部的...

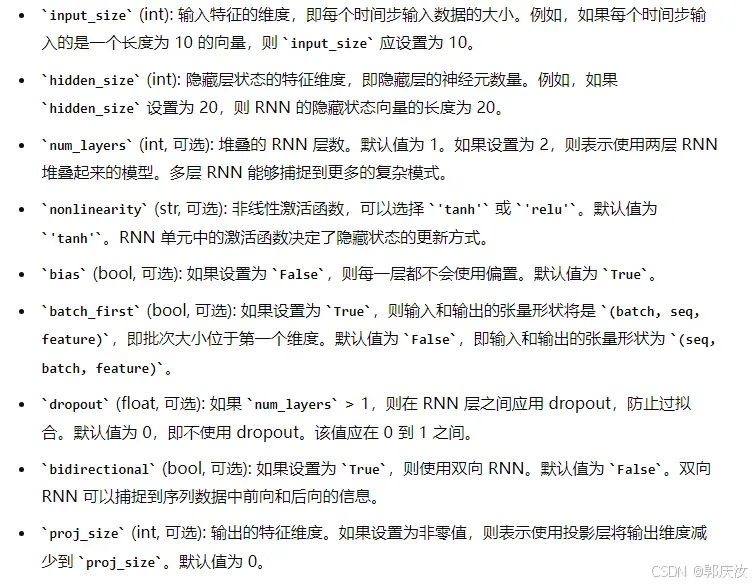

torch.nn.RNN()相关的参数设置...

在处理“我决定明年再回去”这一小部分时,自注意力机制允许模型直接关联到“去年我去了西湖”中的“西湖”,从而建立了一个直接的联系。这是因为在计算注意力分数时,每个单词的表示(查询)会与所有其他单词的表示(键)进行比较,从而直接捕捉到它们之间...

BERT是一种基于Transformer的预训练语言模型,它的最大创新之处在于引入了双向Transformer编码器,这使得模型可以同时考虑输入序列的前后上下文信息。GPT也是一种基于Transformer的预训练语...

RWKV在多语言处理、小说写作、长期记忆保持等方面表现出色,可以主要应用于自然语言处理任务,例如文本分类、命名实体识别、情感分析等。...

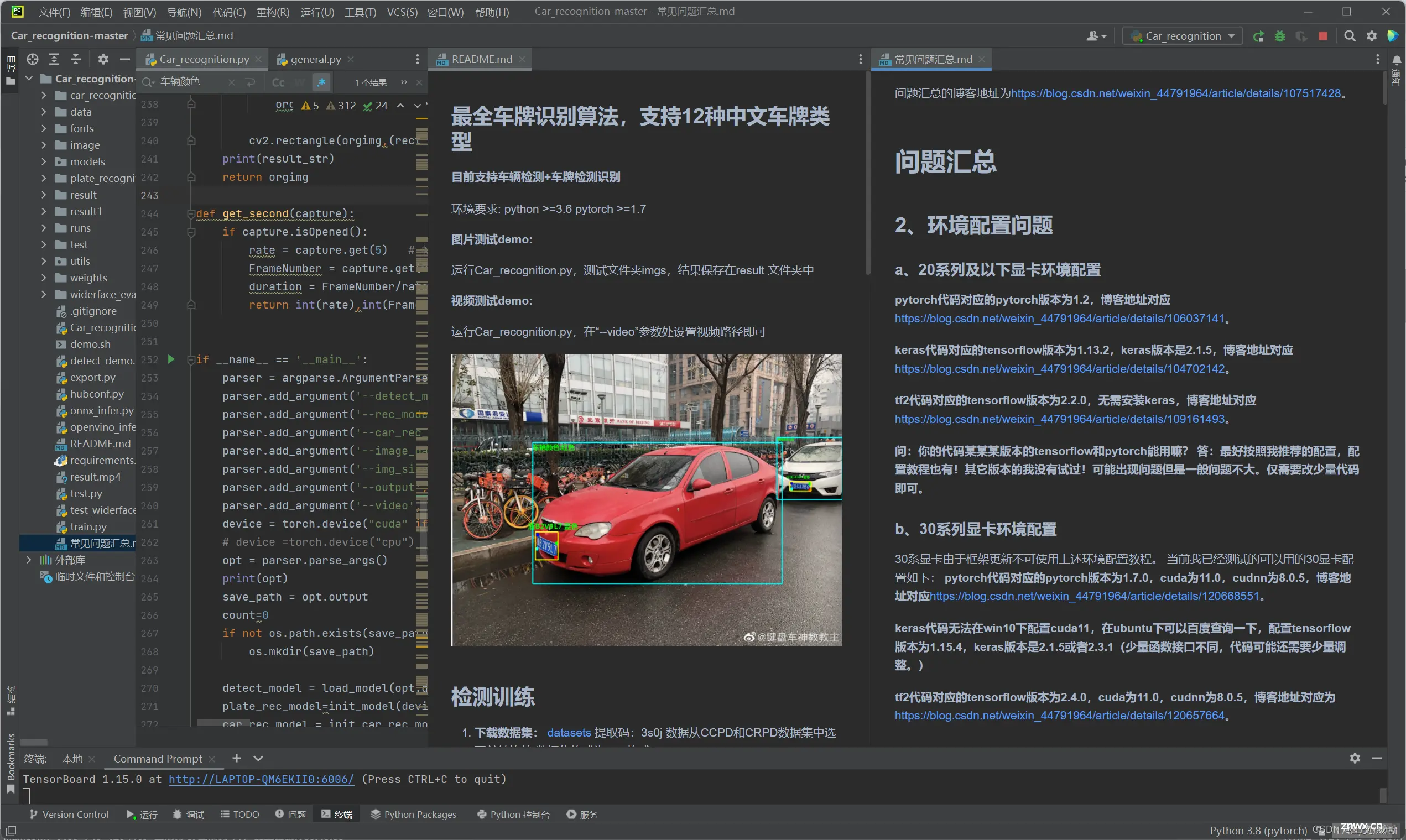

本项目通过yolov8/yolov7/yolov5+CRNN训练自己的数据集,实现了一个中文车牌识别、车牌关键点定位、车牌检测算法,可实现12种中文单双层车牌的字符识别:单行蓝牌、单行黄牌、新能源车牌、白色警用...

CNN主要用于处理图像数据,RNN用于处理序列数据,而DNN是一个通用的深度神经网络架构,可以应用于各种不同类型的数据。这些神经网络架构也可以结合使用,以解决复杂的多模态问题。_dnn和cnn的区别...