上次在MacbookPro上安装了StableDiffusion,体验了本地所心所欲地生成各种心仪的图片,完全没有任何限制的惬意。今天想使用MacbookPro安装一个本地大语言模型体验一下,刚好在2024...

一、大模型的相关问题描述1、大模型\"幻觉\"问题描述2、大模型\"时效性\"问题描述3、大模型\"数据安全\"问题描述二、RAG检索增强生成1、RAG引入2、RAG关键组件3、LL...

就可以访问anythingLLM了。3.安装Enchanted。1.拉取镜像,终端执行。3.配置ollama。_anythingllmdocker...

本文对GraphRAG的灵感来源、能力透视、应用场景都做了比较优秀的解读,同时也对图技术的应用价值做了深入探讨,相信会给大家带来不一样的收获。...

Ollama是一个开源的LLM(大型语言模型)服务工具,用于简化在本地运行大语言模型,降低使用大语言模型的门槛,使得大模型的开发者、研究人员和爱好者能够在本地环境快速实验、管理和部署最新大语言模型,包括如Lla...

使用SAPPhIRE因果关系模型表示系统可以激发设计灵感。然而,创建技术系统或自然系统的SAPPhIRE模型需要从多个技术文档中获取有关系统工作原理的技术知识。本研究探讨了如何使用大型语言模型(也称LL...

LLMs之memory:mem0(个性化的AI记忆层)的简介、安装和使用方法、案例应用之详细攻略目录mem0的简介mem0的安装和使用方法mem0的案例应用mem0的简介2024年7月19日,Mem0AI公司...

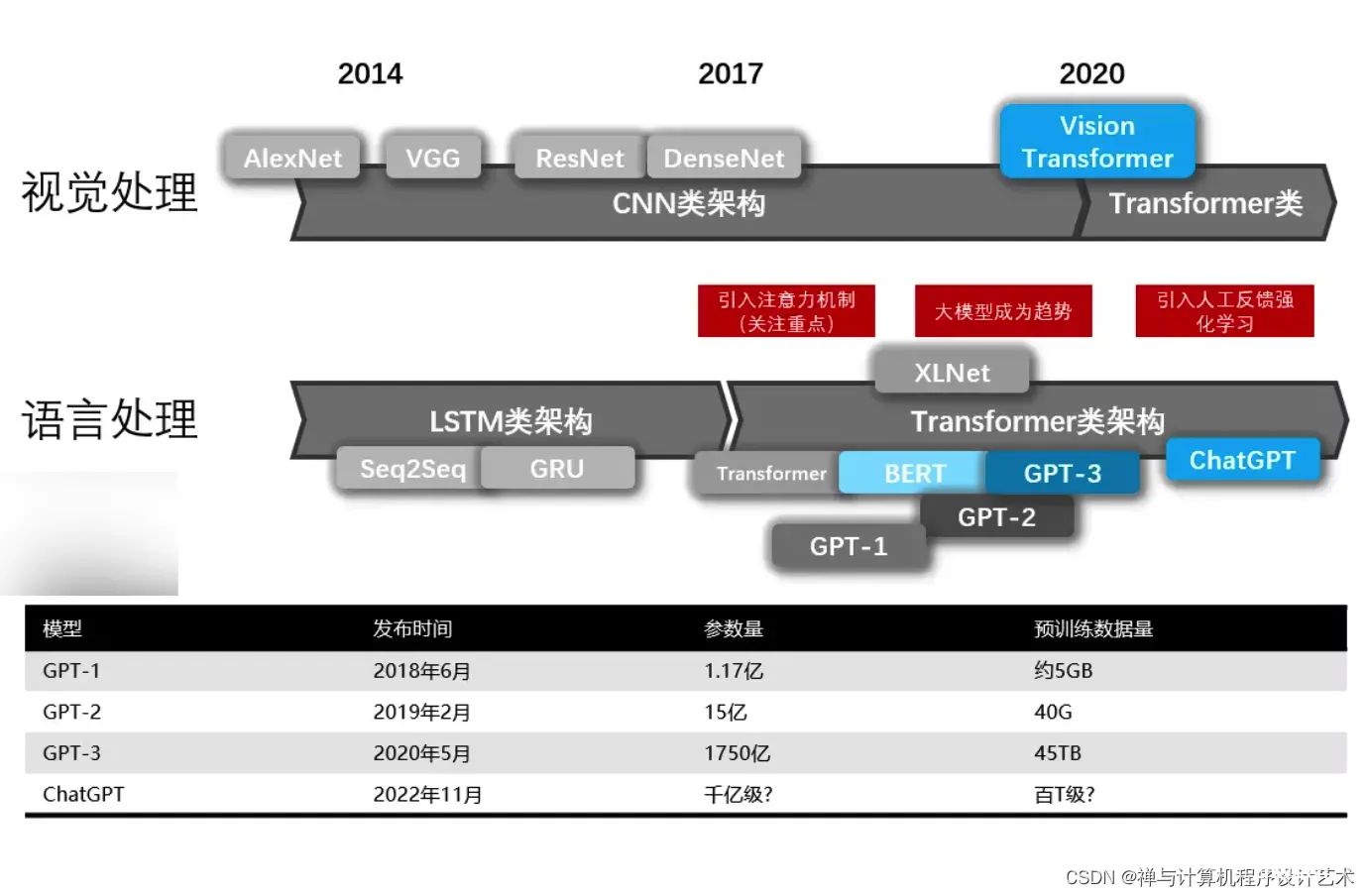

毫无疑问,AI是当下最热的话题之一,而大模型又是当前AI的主角。几年前,正当深度学习进入瓶颈时,以GPT为首的LLM的横空出世让之似乎又找到了“第二增长曲线”。当模型规模大到一定程度时,它所表现出来的涌现能力(Em...

总的来说,大型语言模型的能力极限仍然存在一些挑战和限制,但随着技术的不断进步和研究的深入,这些问题将逐渐被解决。未来,大型语言模型将继续在自然语言处理、语音识别、计算机视觉等领域发挥重要作用,并为人类社会带来更多的便利和进步。_llm大...

Vicuna-13B是在LLaMa-13B的基础上使用监督数据微调得到的模型,数据集来自于ShareGPT.com产生的用户对话数据,共70K条。使用GPT-4作为判断的初步评估表明,Vicuna-13B达到...