CARAFE是一种基于内容感知的特征重组上采样方法。它主要通过利用特征图的局部上下文信息来进行内容感知的特征重组,从而提高上采样的精度。与传统的上采样方法(如转置卷积、双线性插值)相比,CARAFE能够更好地保留和增强特征图中的细节信息...

直接去下载官方的yolov8源码就行,那里面集成了obb。...

DWRSeg机制:通过动态权重调整和扩张卷积有效提升了小目标的检测能力。C2f和Bottleneck模块修改:通过集成DWRSeg模块,增强了特征提取和残差学习能力。实验结果:在多个应用场景中,改进后的YOLOv8展现了更高的检测精度,...

高效的多头注意力机制:相比传统的ViT,EfficientViT通过改进的多头注意力机制,降低了计算复杂度。轻量级设计:EfficientViT通过减少网络参数和计算量,实现了更低的延迟和更少的资源消耗。增强的特征提...

LSKAttention是一种基于大核卷积的注意力机制,通过引入不同尺寸的卷积核来捕获图像中的多尺度特征信息。多尺度信息捕捉:通过大核卷积的感受野,能够有效捕捉目标物体的多尺度特征信息。增强全局特征:相比于小卷积核,大卷积核能够更好地捕...

本文深入探讨了如何将自适应特征金字塔网络(AFPN)集成到YOLOv8中,以提升目标检测的性能。AFPN作为一种改进的特征融合方法,通过多尺度特征融合和动态特征重标定,显著增强了YOLOv8在复杂场景和小目标检测中的表现。AF...

通过将RCS-OSA(减少通道的空间对象注意力机制)引入到YOLOv8中,并替换原有的C2f模块,我们显著提升了模型在多项指标上的性能,尤其是在小物体检测和复杂场景中的表现。实验结果显示,改进后的模型在COCO和PASC...

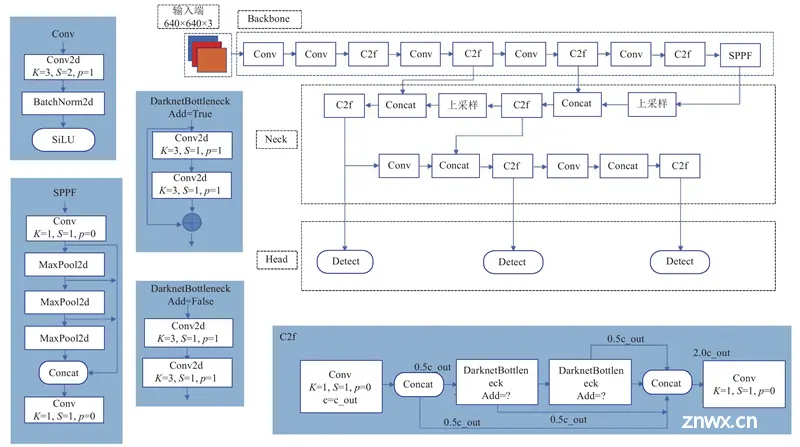

YOLOv8作为目标检测领域的最新版本,在速度和精度之间取得了良好的平衡。然而,随着计算机视觉任务的复杂性不断增加,YOLOv8的标准主干网络(Backbone)在处理高分辨率图像或多尺度目标时,可能存在一定的局限性。为了进一步提升YO...

从基础到实践,深入学习。无论你是初学者还是经验丰富的老手,对于本专栏案例和项目实践都有参考学习意义。每一个案例都附带关键代码,详细讲解供大家学习,希望可以帮到大家。正在不断更新中。...

ODConv是一种新型卷积操作,其核心思想是动态调整卷积核的参数,以适应不同的输入特征。ODConv通过引入多个维度的动态卷积,能够更好地捕捉空间和通道维度上的特征关系,从而提升模型的表达能力。...