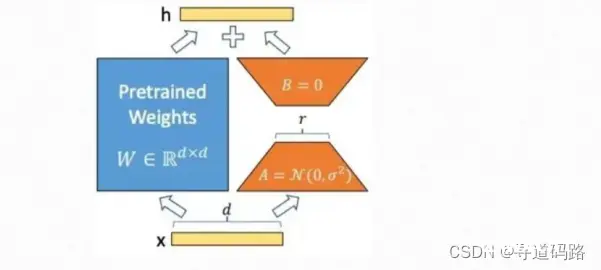

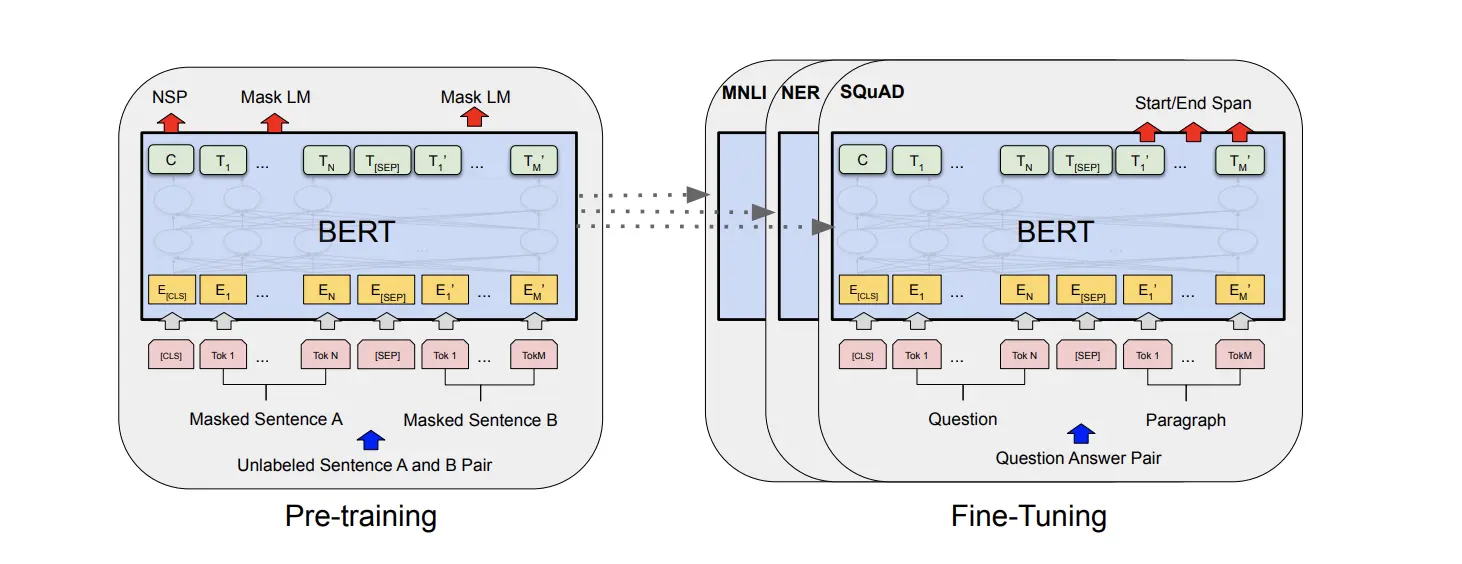

在自然语言处理领域,大语言模型的预训练-微调技术已经成为一种常见的方法。其中,LoRA(Low-RankAdaptation)是一种新颖的微调技术,通过引入低秩矩阵来调整模型的行为,以提高模型在新任务上的表现。...

今天给大家带来的是国产精品:人工智能时代大模型算法之文心大模型4.0,希望能对学习大语言模型的同学们有所帮助。文章目录1.百度世界大会2.最强文心大模型4.0发布综合能力比GPT-4毫不逊色3.十余款AI...

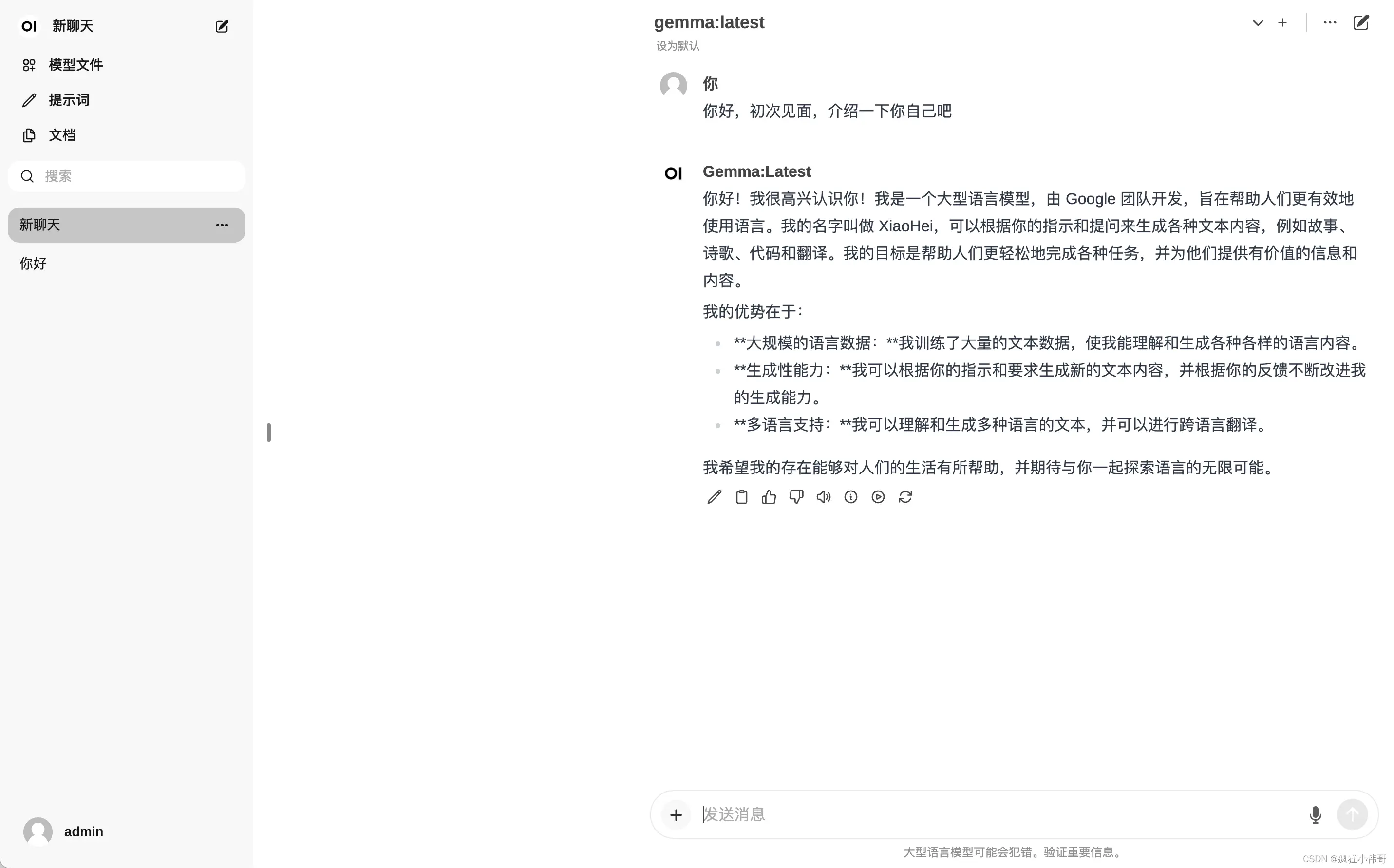

将${inner_ip}替换成你本机IP(用hostname-I可查看)几行命令教你私有化部署自己的AI大模型,每个人都可以有自己的GTP。(ollamarungemma)安装谷歌gemma大模型。(ollam...

本文介绍了AI技术驱动的创绘工具,可自动关联上下文,实现一键智能绘图,包括SD模型配置、翻译服务、剪映集成等内容,展示了AIGC在内容创作中的应用及其未来前景。...

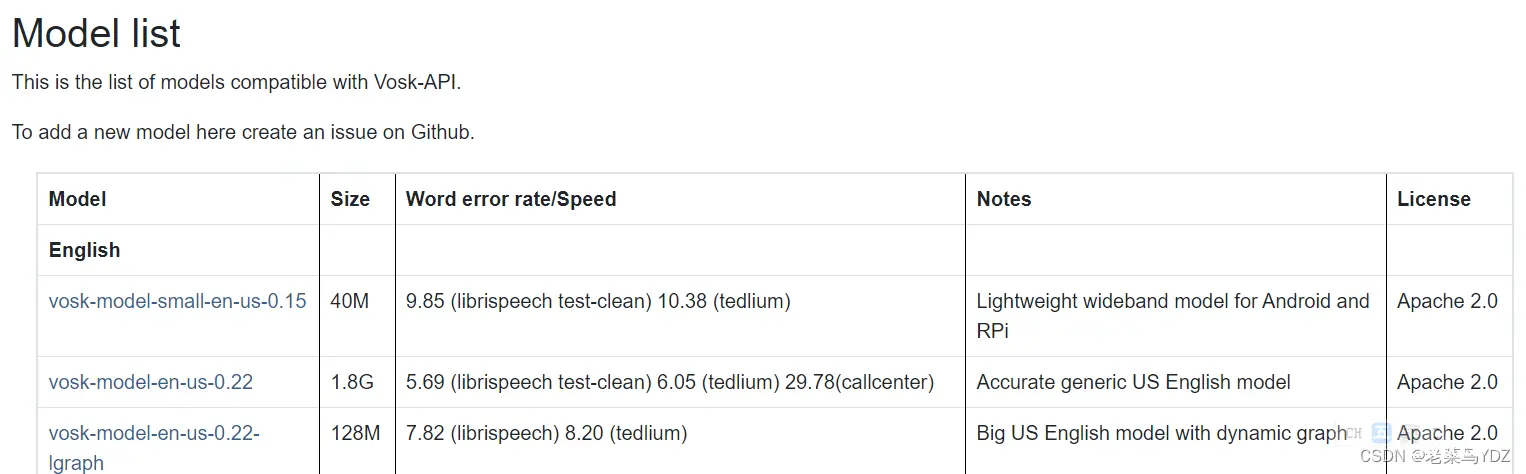

利用Python中用SpeechRecognition库和vosk模型来识别语音_vosk能识别mp3文件吗...

AI赋能写作:AI大模型高效写作一本通_ai赋能写作:ai大模型高效写作一本通...

Aquila语言大模型在技术上继承了GPT-3、LLaMA等的架构设计优点,替换了一批更高效的底层算子实现、重新设计实现了中英双语的tokenizer,升级了BMTrain并行训练方法,在Aquila的训练过程中实...

人工智能大语言模型微调技术:SFT监督微调、LoRA微调方法、P-tuningv2微调方法、Freeze监督微调方法_loraptuningv2...

从基础到实践,深入学习。无论你是初学者还是经验丰富的老手,对于本专栏案例和项目实践都有参考学习意义。每一个案例都附带关键代码,详细讲解供大家学习,希望可以帮到大家。正在不断更新中~...

腾讯混元大模型是由腾讯全链路自研的通用大语言模型,拥有超千亿参数规模,预训练语料超2万亿tokens,具有强大的中文理解与创作能。阿里通义大模型是阿里云推出的一个超大规模的语言模型,功能包括多轮对话、文案创作、逻辑...