使用docker集成vllm实现模型推理加速,并使用Tools(工具)增强模型的能力和准确性...

内附用Qwen2.5打造个人AI助理保姆级教程🤩_qwen2.5开源地址...

通过vLLM的Docker镜像,快速体验Qwen2-VL-7B-Instruct推理效果_qwen2-vldocker部署...

本文详细讲解transformers推理大语言模型的初始化过程,包括Python包搜索、LazyModule延迟模块、模块搜索和Python包API设计美学……...

通过docker方式实现Qwen2.5-7B-Instruct集成vllm,流式输出...

![初识langchain[1]:Langchain实战教学,利用qwen2.1与GLM-4大模型构建智能解决方案[含Agent、tavily面向AI搜索]](/uploads/2024/10/12/1728720069038074048.webp)

初识langchain[1]:Langchain实战教学,利用qwen2.1与GLM-4大模型构建智能解决方案[含Agent]...

Qwen2-57B-A14B作为一个强大的MoE模型,在保持较小激活参数规模的同时,实现了优秀的性能表现,为大规模语言模型的应用提供了新的可能性。任务中表现优异,超越了当前主流的MoE开源模型。SwiGLU激活函数...

最近在玩LLM,听闻PAI-DSW有三个月免费试用,试了一下感觉还不错,就是有一些学习成本。刚通过vllm+open-webui成功部署了Qwen2.5-7B-Instruct,也是摸索了一段时间,记录一下以便需...

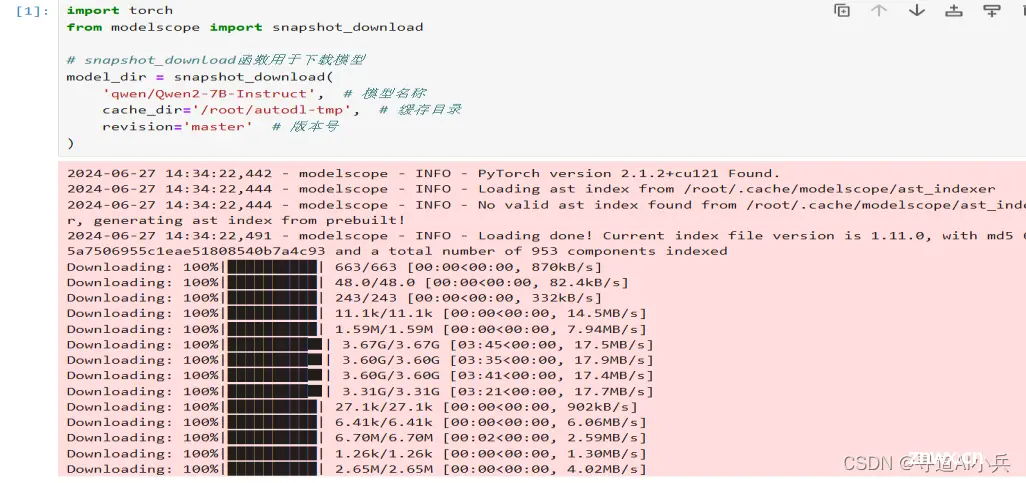

在人工智能的快速发展中,大型语言模型(LLM)逐渐成为研究和应用的新宠。它们在自然语言处理(NLP)领域的广泛应用,如文本生成、翻译、摘要等任务中展现出了卓越的性能。Qwen2-7B作为其中的一个代表,不仅因其强...

最近在给我们的客户私有化部署我们的TorchV系统,客户给的资源足够充裕,借此机会记录下部署千问72B模型的过程,分享给大家!_qwen2-72b-instruct...