【linux服务器】大语言模型实战教程:LLMS大模型快速部署到个人服务器

鸽芷咕 2024-07-09 08:37:04 阅读 85

🎬 鸽芷咕:个人主页

🔥 个人专栏: 《C++干货基地》《粉丝福利》

⛺️生活的理想,就是为了理想的生活!

引言

说到大语言模型相信大家都不会陌生,大型语言模型(LLMs)是人工智能文本处理的主要类型,也现在最流行的人工智能应用形态。ChatGPT就是是迄今为止最著名的使用LLM的工具,它由OpenAI的GPT模型的特别调整版本提供动力,而今天我们就来带大家体验一下部署大模型的实战。

文章目录

引言一、项目选择与系统介绍1.1 项目介绍1.2 Tiny-Llama语言模型1.3 进入系统1.4 进行远程连接

二、部署LLMS大模型2.1 拉取代码到环境2.2 自定义算子部署配置protoc 环境算子编译部署修改环境变量编译运行& 依赖安装

2.3 推理启动

三、 项目体验

一、项目选择与系统介绍

1.1 项目介绍

本来博主是准备来部署一下咱们的,清华大语言模型镜像这个目前也是非常的火啊,吸引了很多人的注意其优秀的性能和GPT3 不相上下,但是由于考虑到,大部分人电脑其实跑大模型是有一点点吃力的,为了让更多人来先迈出部署模型的第一步,于是就决定去 gitee 上找一个小型一点的大模型来实战一下。

1.2 Tiny-Llama语言模型

1.3 进入系统

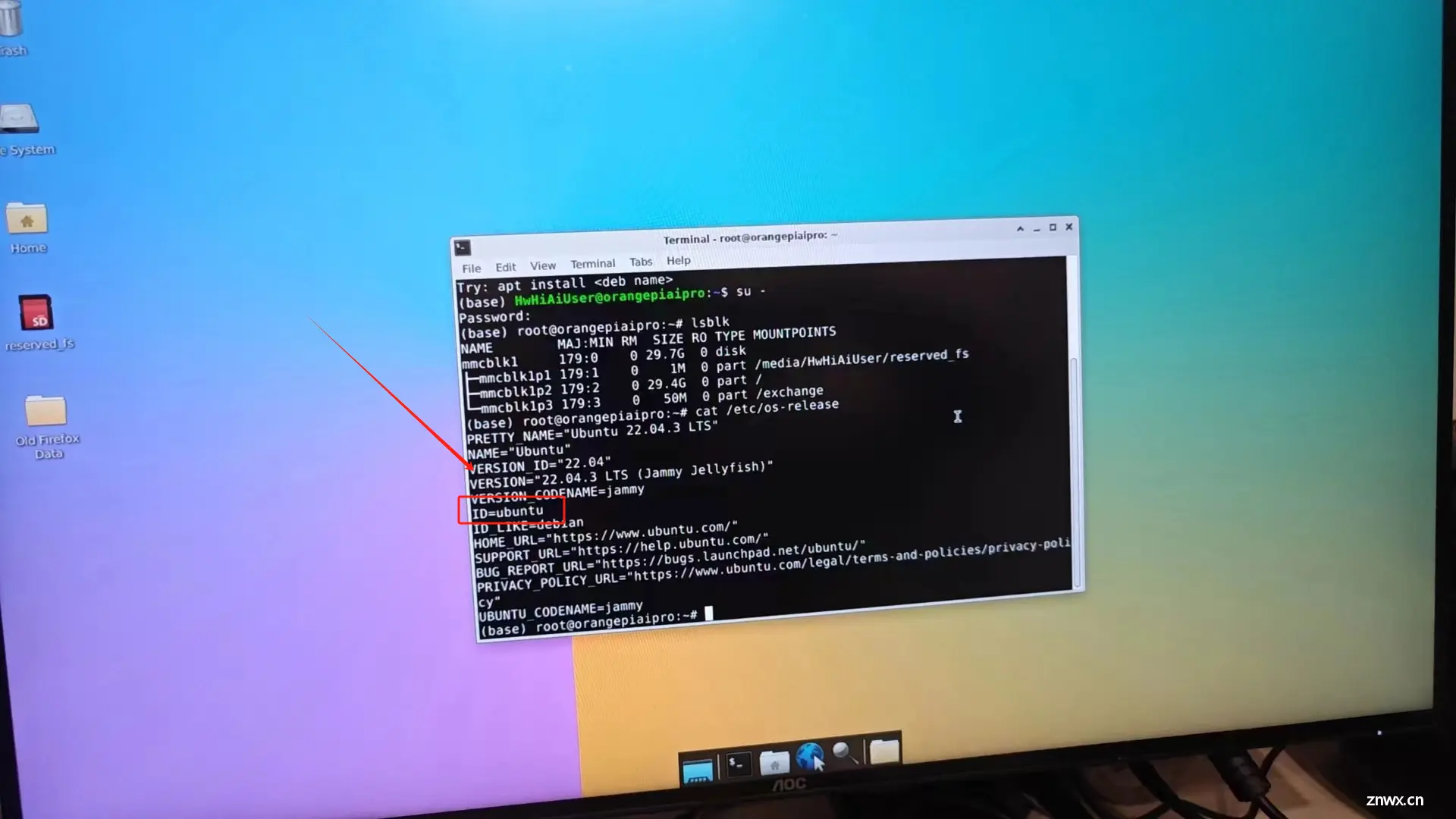

这里我们选择的是openEuler,是香橙派的这块板子内置的系统。但其实他的内核是ubuntu这里可以给大家看一下,所以我们用 ubuntu 服务器来部署应该是没有问题的。

<code>openEuler 是一由中国开源软件基金会主导,以Linux稳定系统内核为基础,华为深度参与,面向服务器、桌面和嵌入式等的一个开源操作系统。

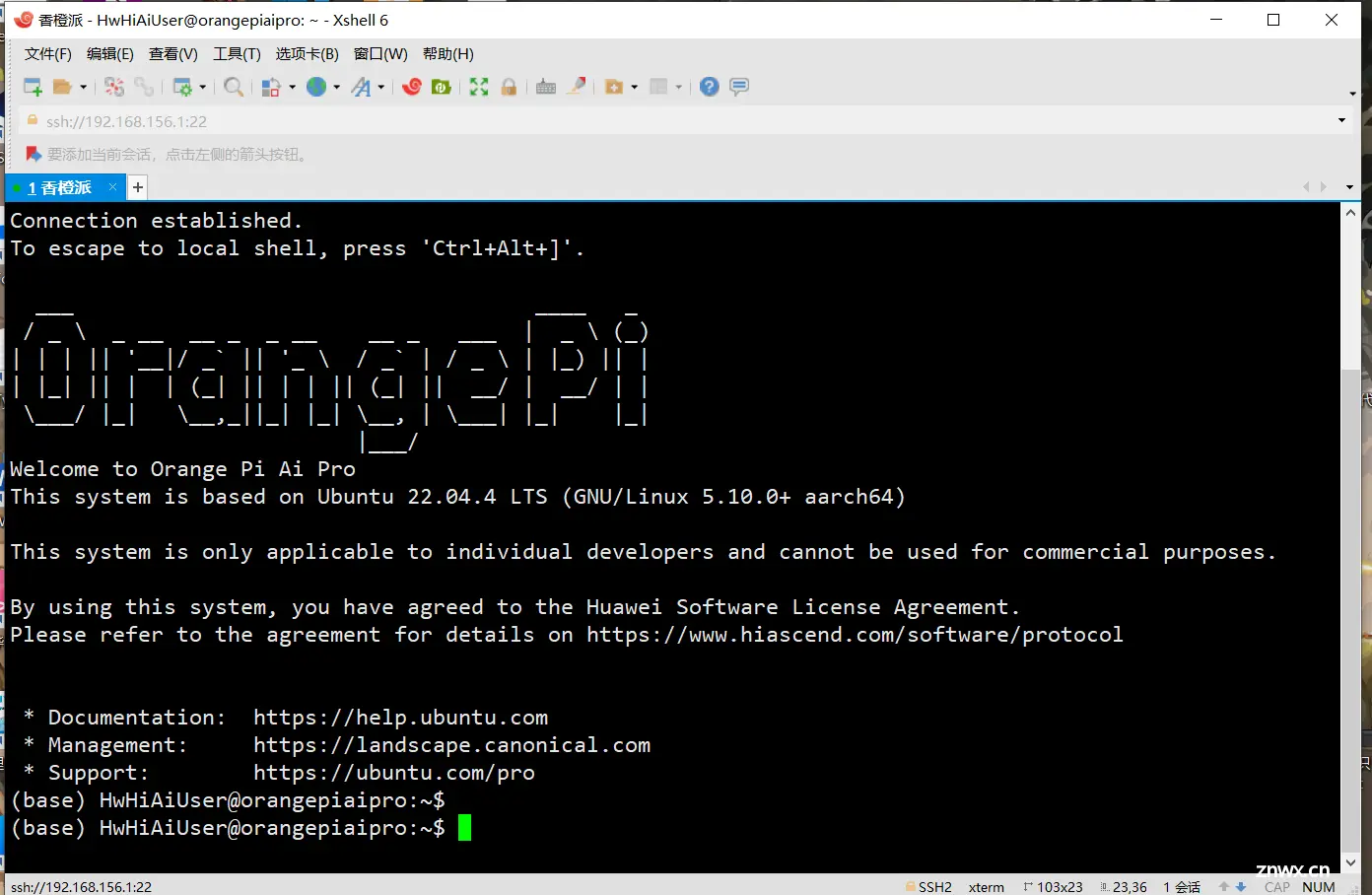

1.4 进行远程连接

Mind@123 当然root密码也是一样的

这里我们进来之后可以直接选择链接WiFi 非常便捷

Mind@123

二、部署LLMS大模型

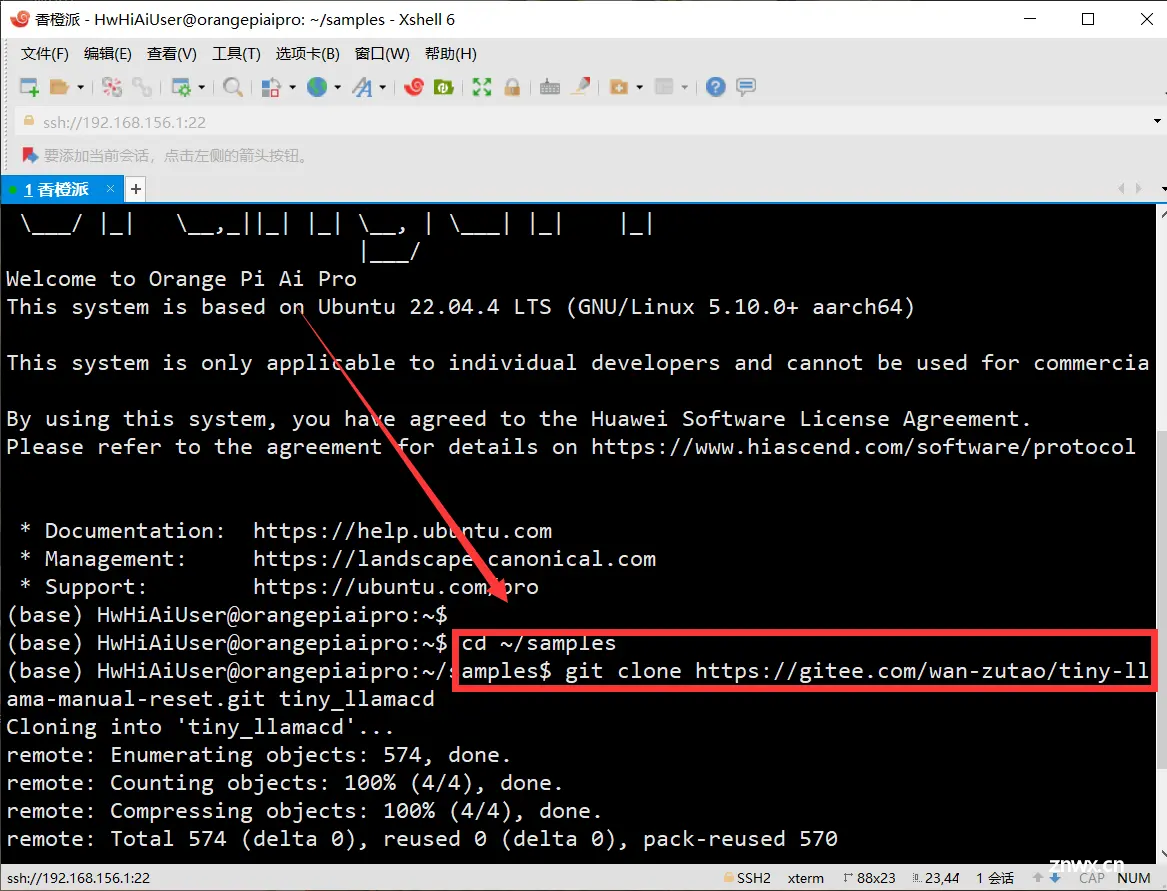

2.1 拉取代码到环境

先cd进入 <code>cd ~/samples 目录之后直接利用git 拉取我们的项目,git 由于系统镜像自带的有就不用我们手动安装了

2.2 自定义算子部署

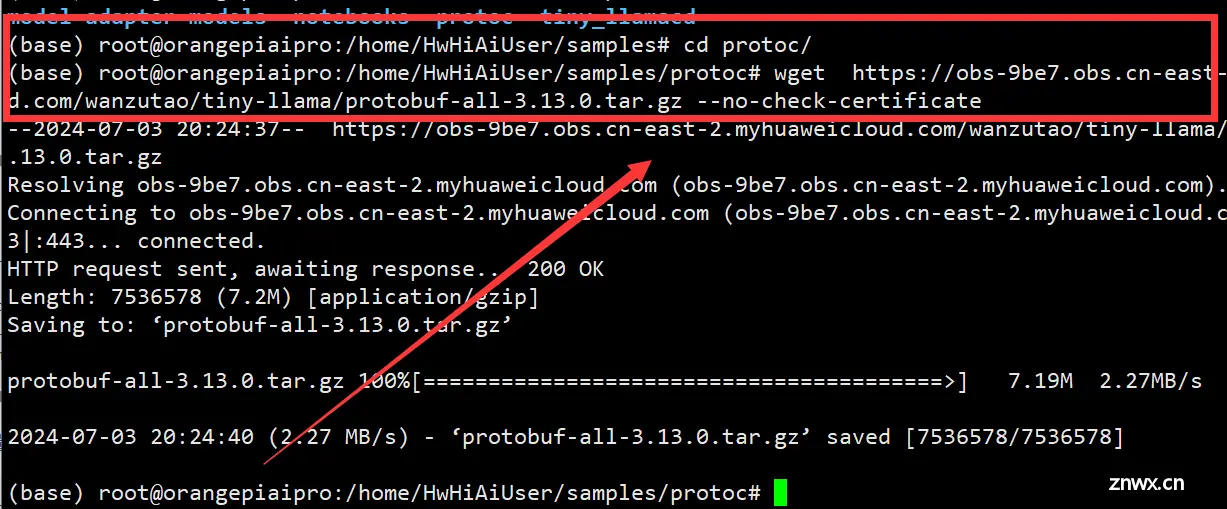

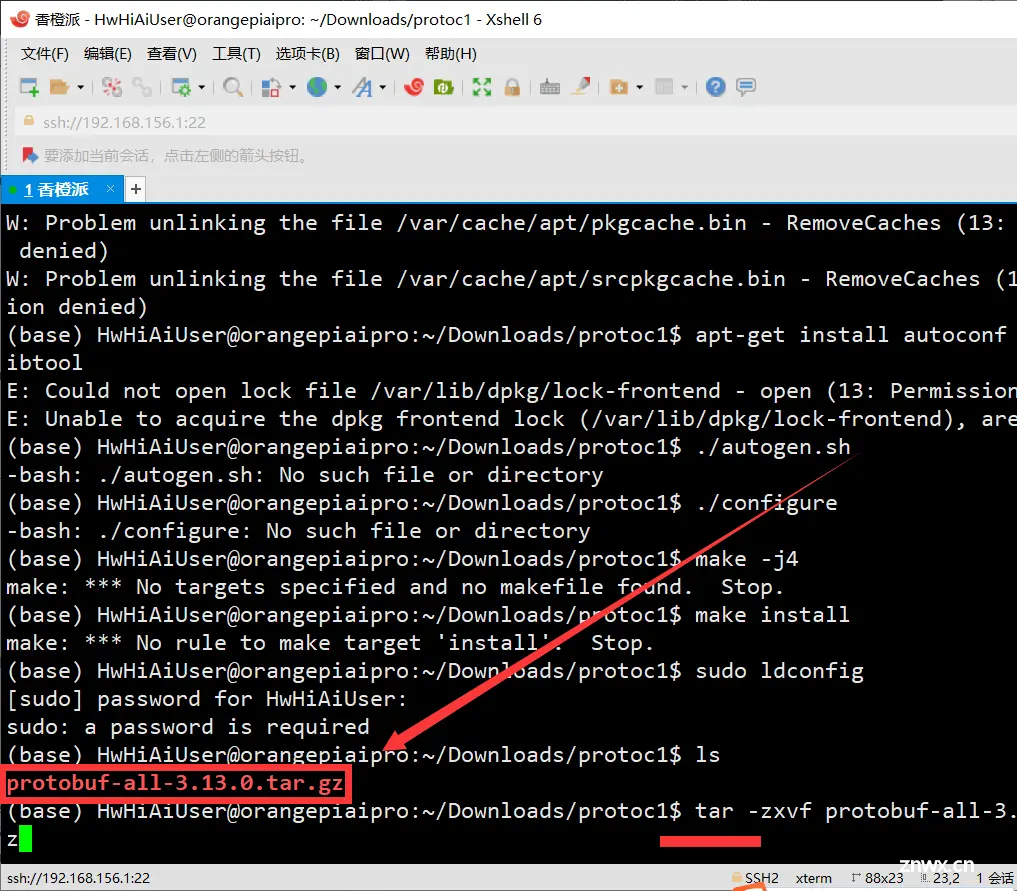

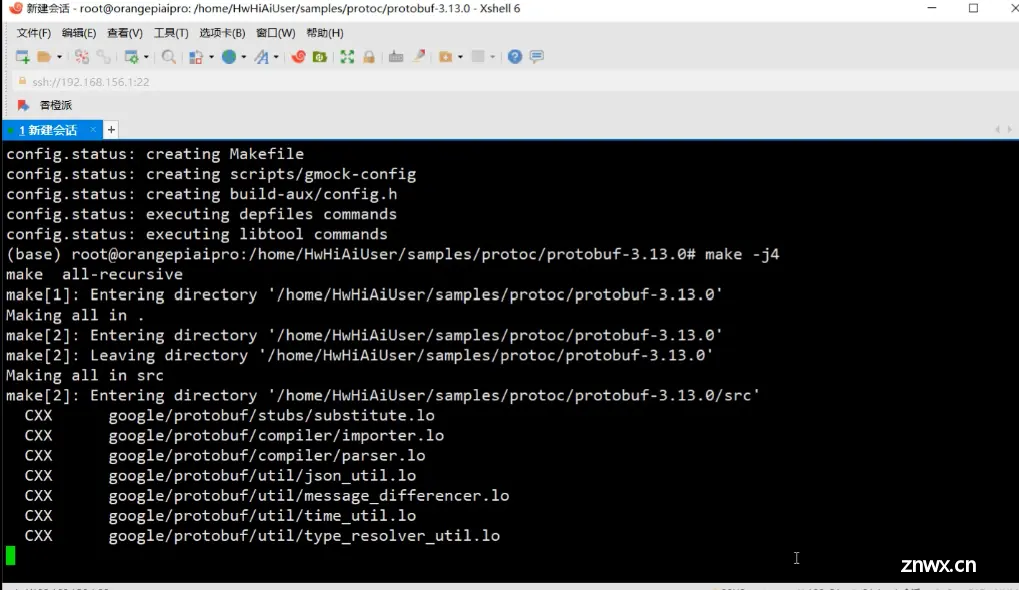

配置protoc 环境

<code>wget https://obs-9be7.obs.cn-east-2.myhuaweicloud.com/wanzutao/tiny-llama/protobuf-all-3.13.0.tar.gz --no-check-certificate

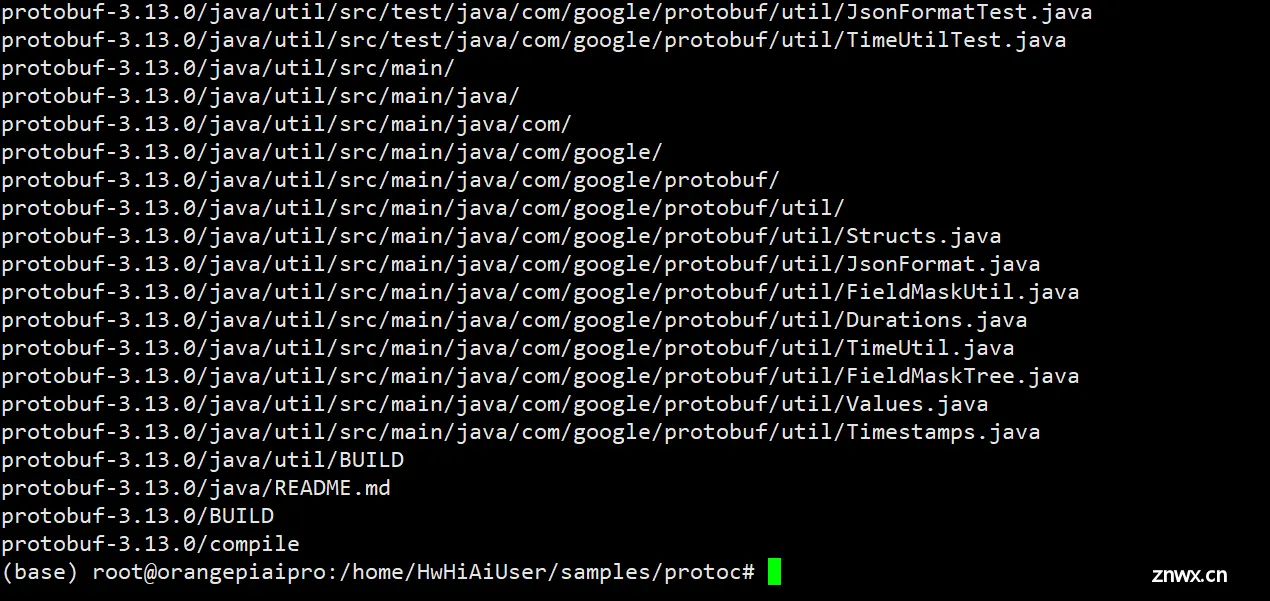

<code>tar -zxvf protobuf-all-3.13.0.tar.gz

这里解压速度非常快,基本一秒就OK了

<code>cd protobuf-3.13.0

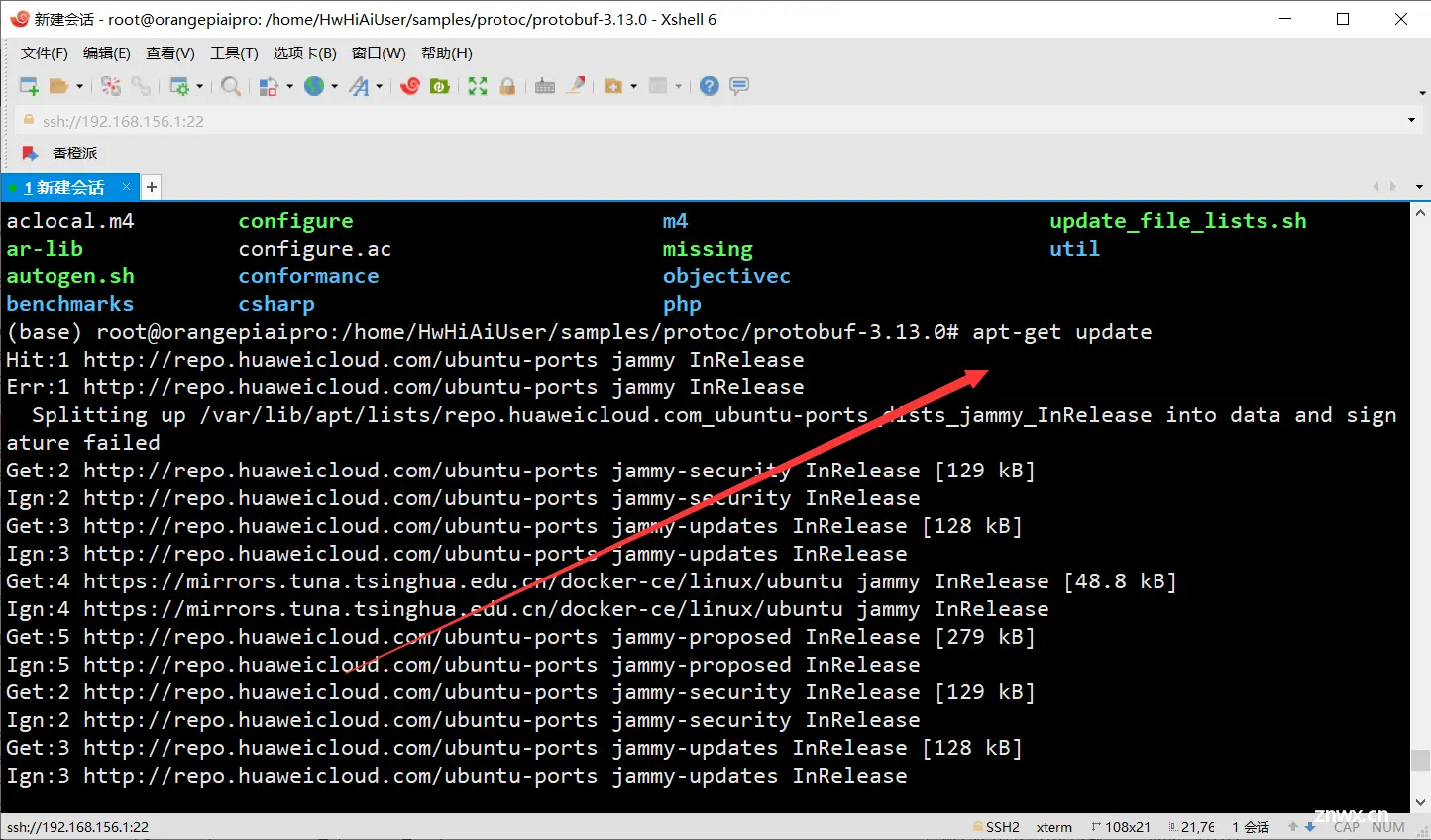

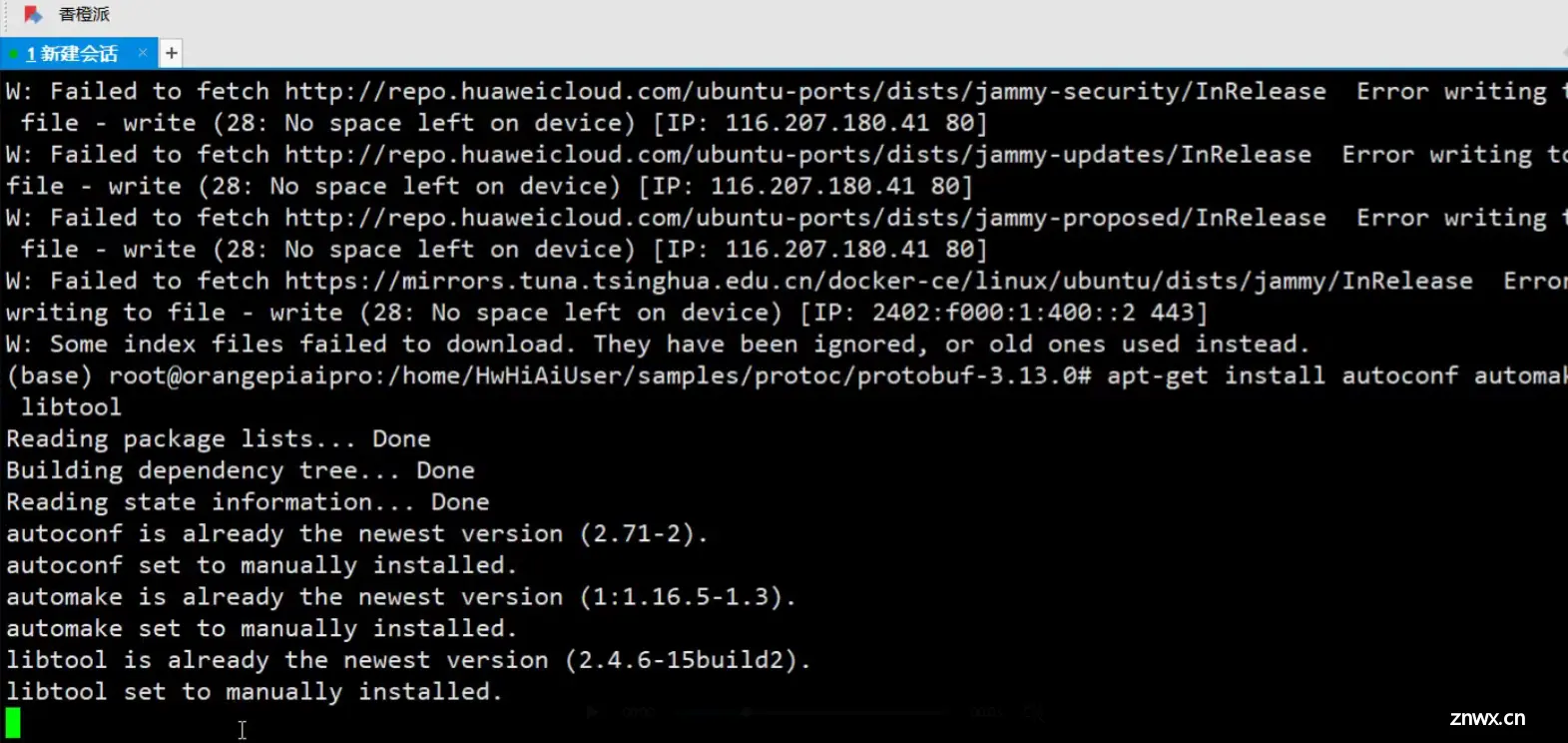

更新apt包管理器的软件包列表

apt-get update

<code>apt-get install autoconf automake libtool

./configure 生成一个Makefile

./autogen.sh

./configure

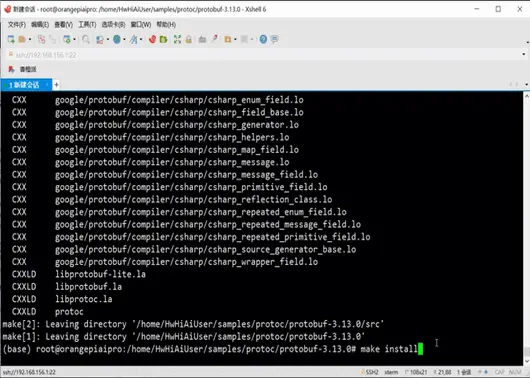

make -j4

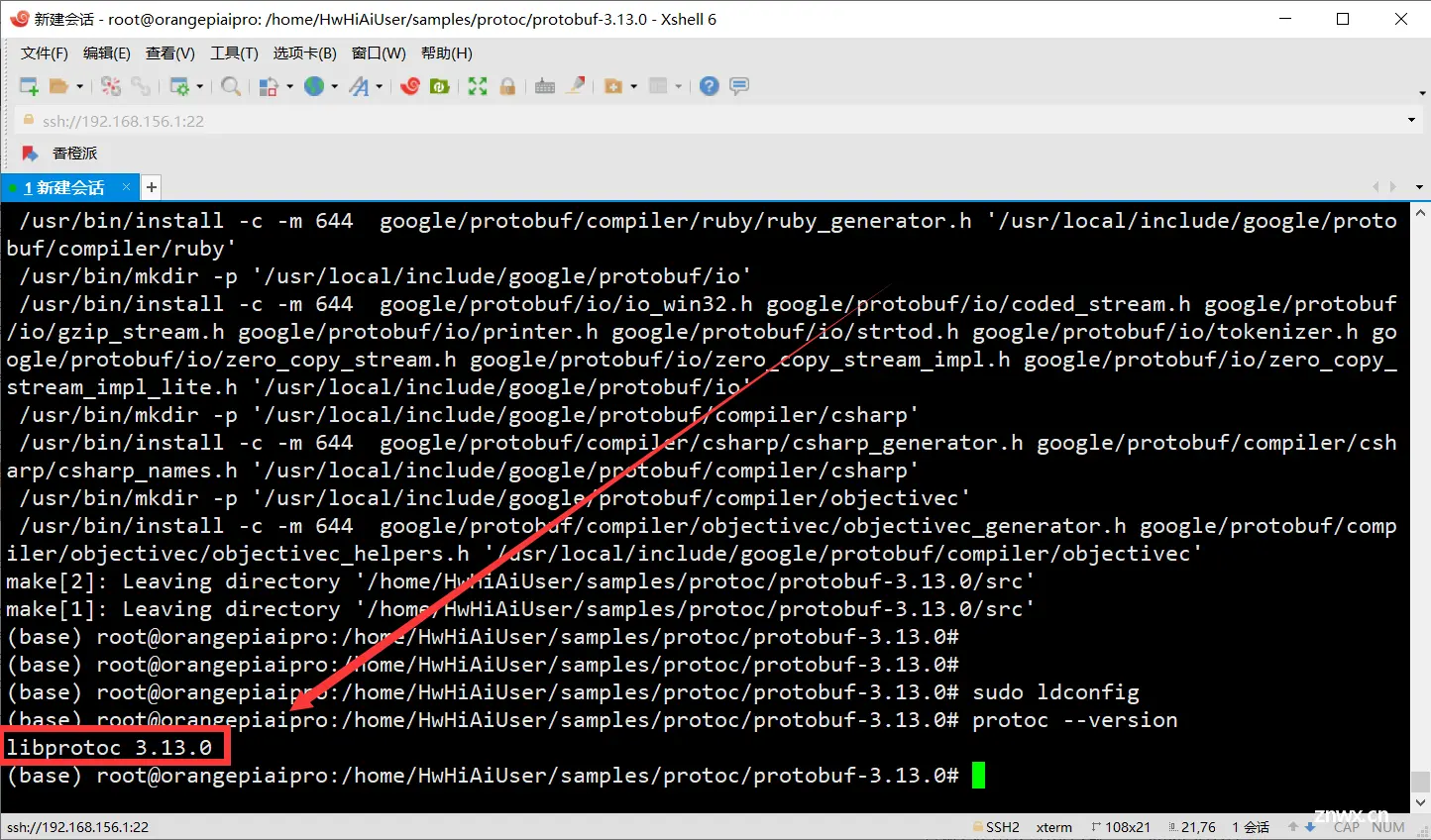

<code>make install

<code>sudo ldconfig

protoc --version

算子编译部署

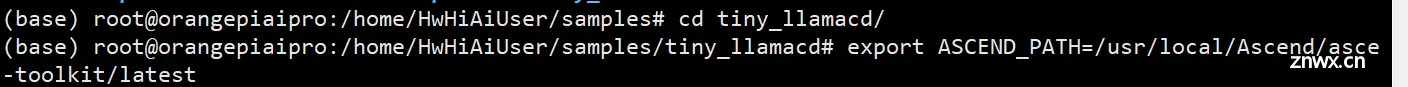

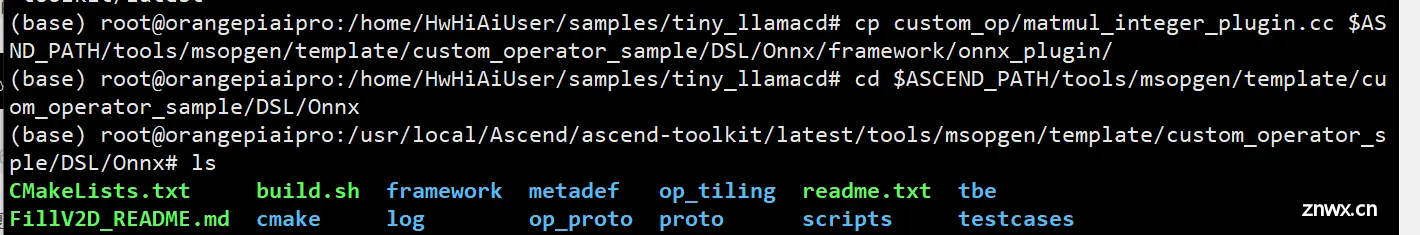

cp custom_op/matmul_integer_plugin.cc $ASCEND_PATH/tools/msopgen/template/custom_operator_sample/DSL/Onnx/framework/onnx_plugin/

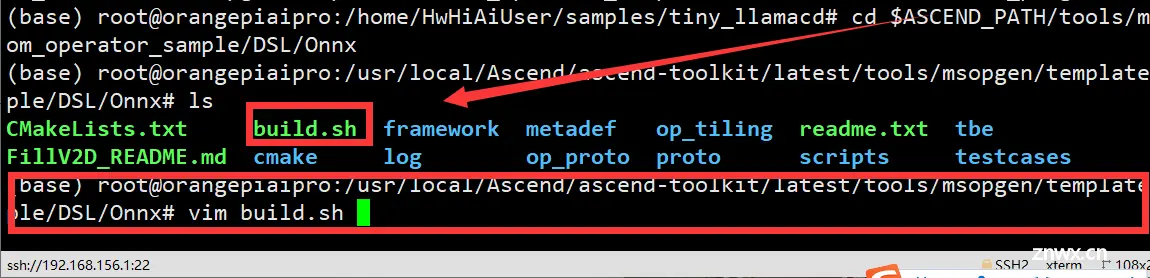

<code>cd $ASCEND_PATH/tools/msopgen/template/custom_operator_sample/DSL/Onnx

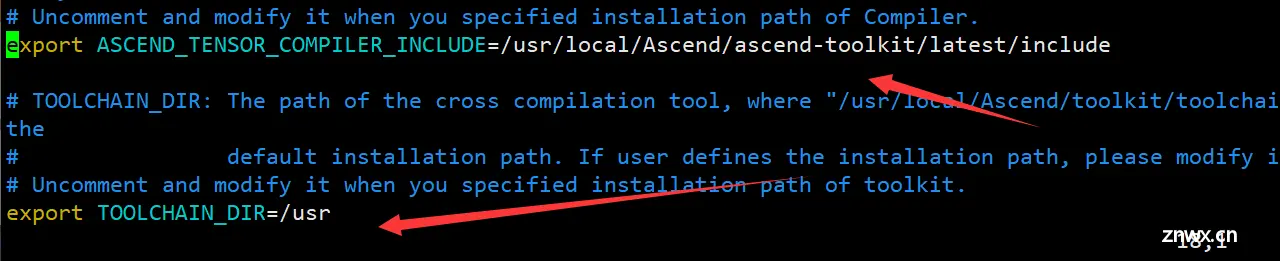

修改环境变量

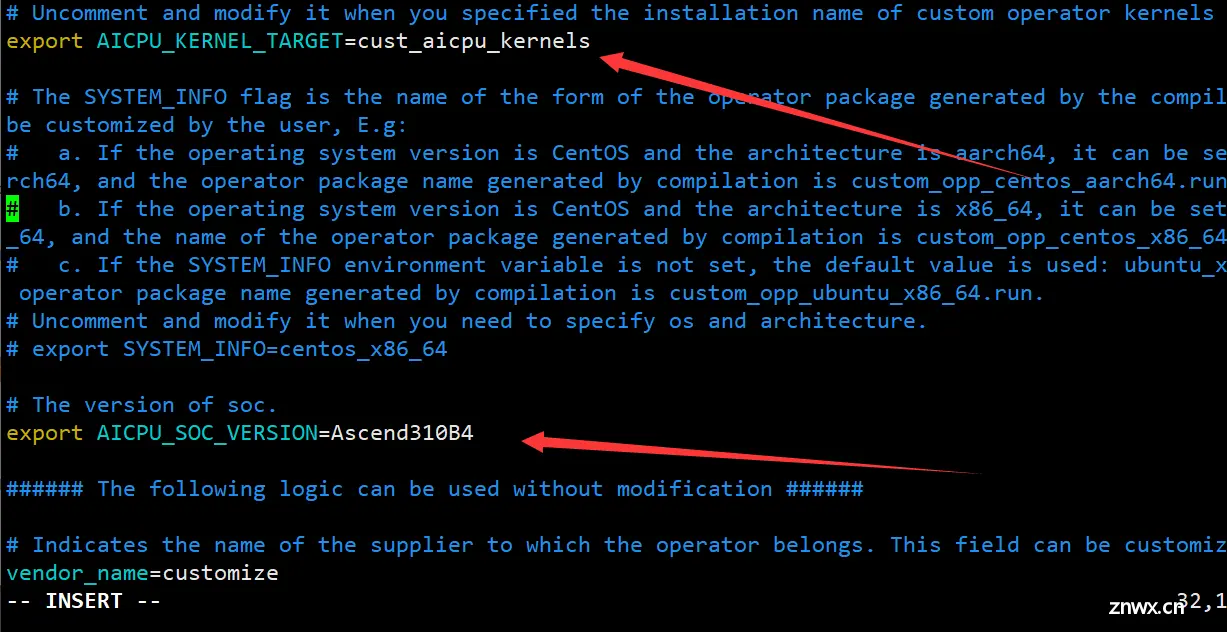

<code>#命令为 vim build.sh

<code># 修改内容为

export ASCEND_TENSOR_COMPILER_INCLUDE=/usr/local/Ascend/ascend-toolkit/latest/include

export TOOLCHAIN_DIR=/usr

export AICPU_KERNEL_TARGET=cust_aicpu_kernels

export AICPU_SOC_VERSION=Ascend310B4

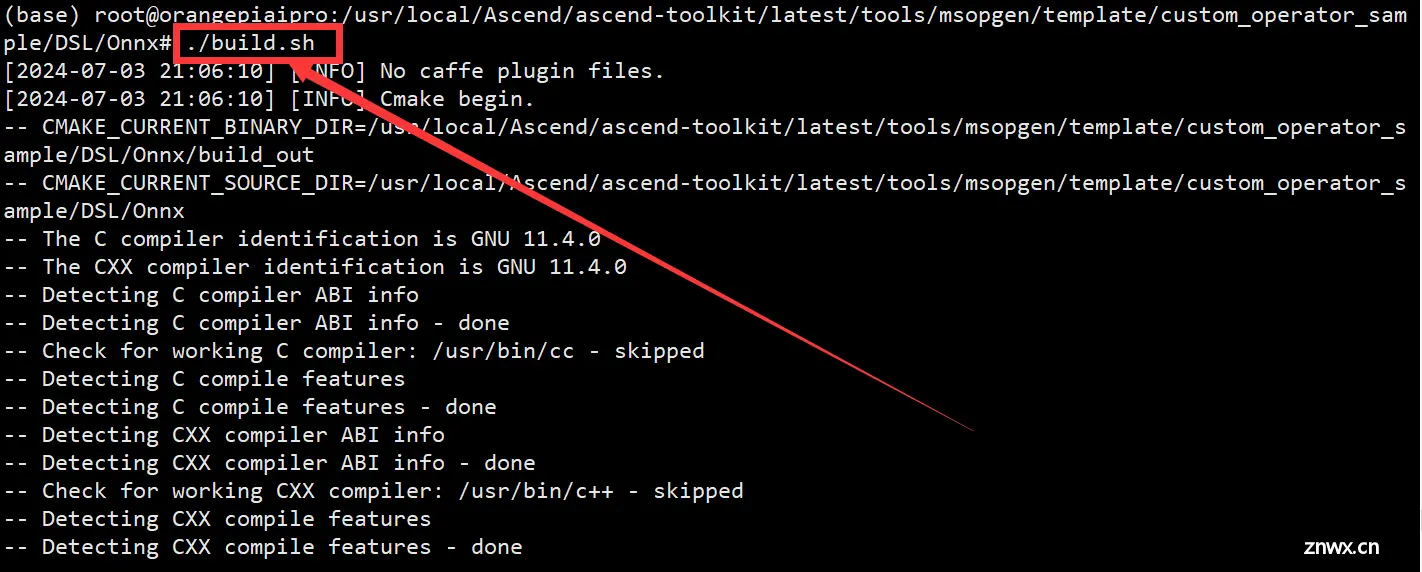

编译运行& 依赖安装

<code>./build.sh

cd build_out/

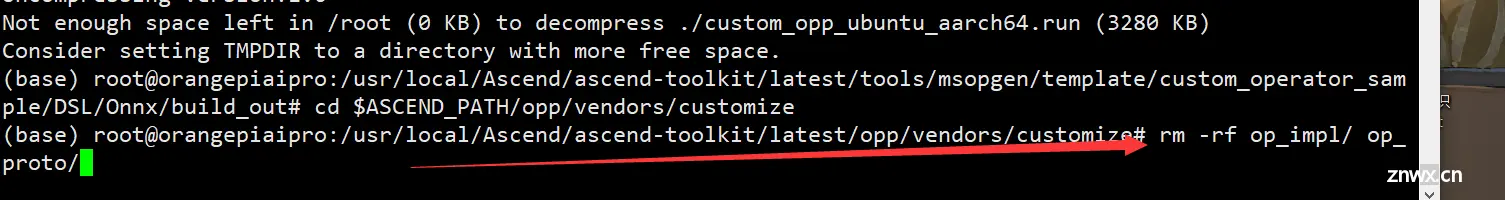

$ASCEND_PATH/opp/vendors/

./custom_opp_ubuntu_aarch64.run

<code>cd $ASCEND_PATH/opp/vendors/customize

rm -rf op_impl/ op_proto/

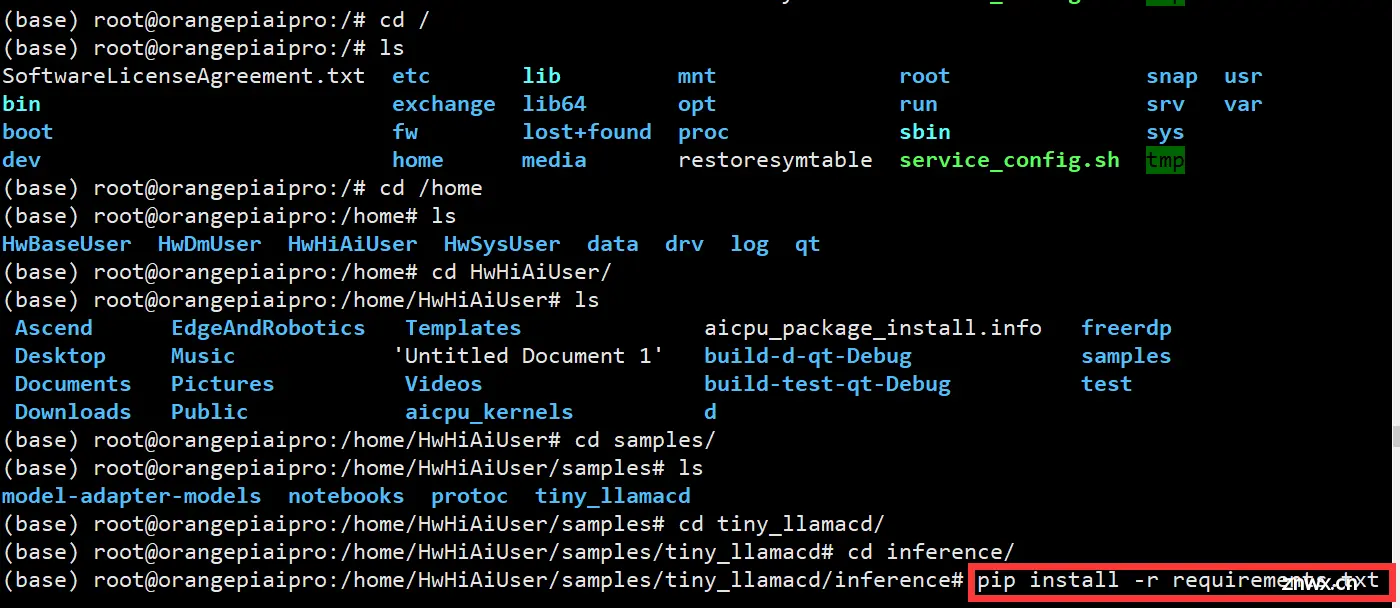

安装依赖:从指定的华为云 PyPI 镜像源安装所需的 Python 包

<code>cd tiny_llama/inference

pip install -r requirements.txt -i https://mirrors.huaweicloud.com/repository/pypi/simple

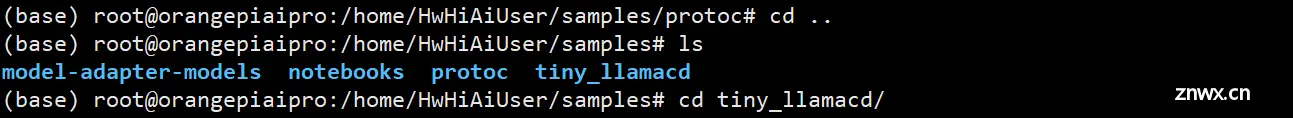

先cd 回到根目录,在进入家目录,找到咱们的 tiny_llama/inference

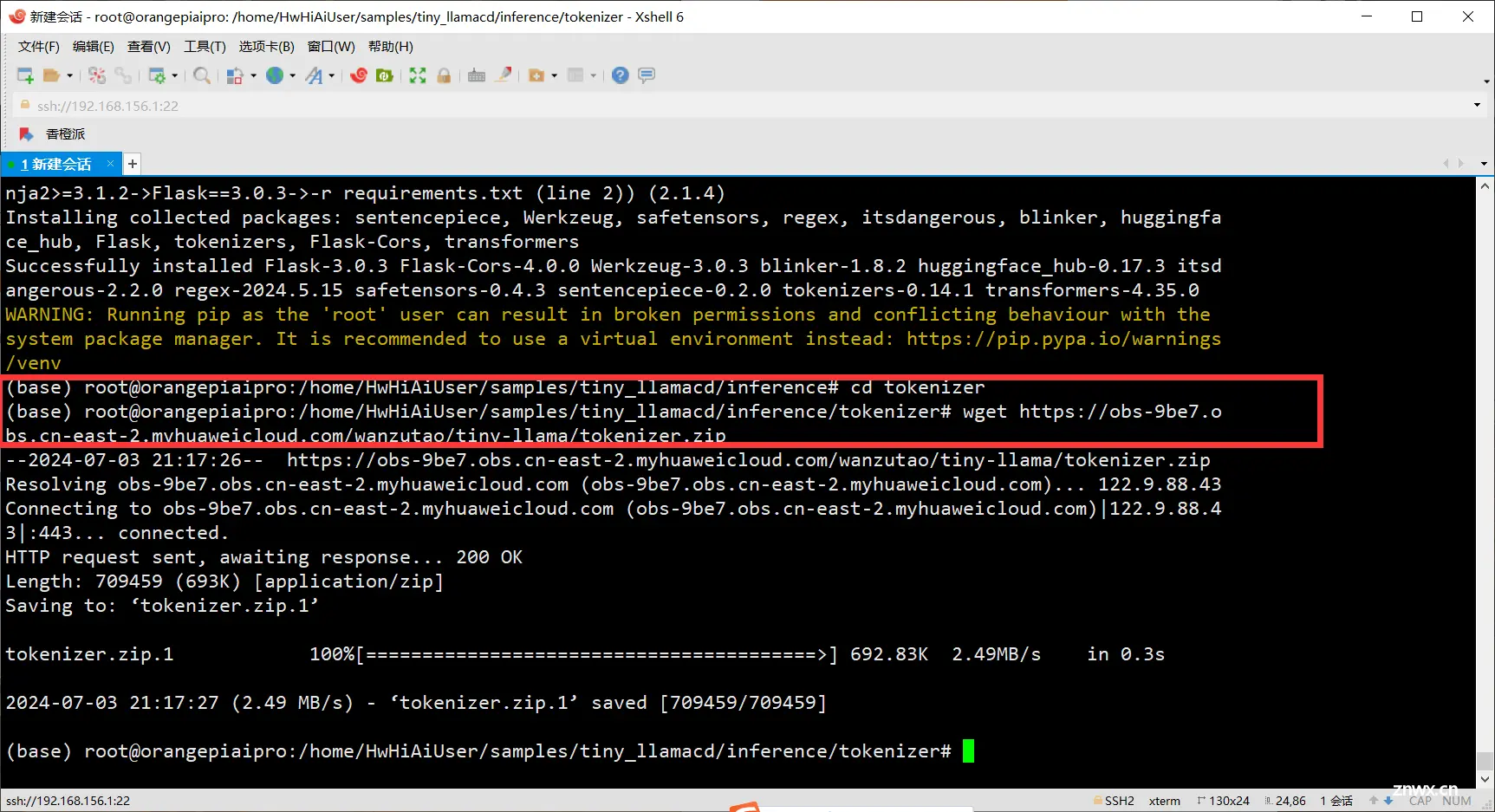

2.3 推理启动

<code>cd tokenizer

wget https://obs-9be7.obs.cn-east-2.myhuaweicloud.com/wanzutao/tiny-llama/tokenizer.zip

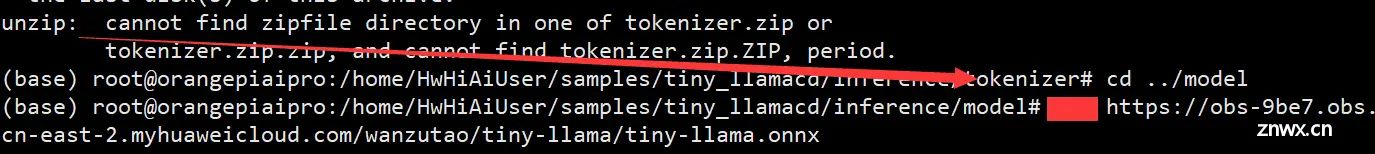

unzip tokenizer.zip

<code>cd ../model

wget https://obs-9be7.obs.cn-east-2.myhuaweicloud.com/wanzutao/tiny-llama/tiny-llama.onnx

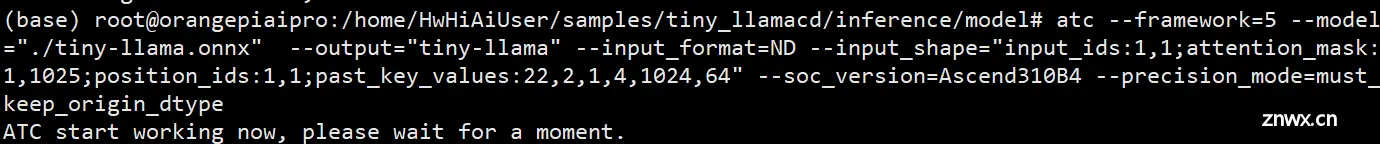

<code>atc --framework=5 --model="./tiny-llama.onnx" --output="tiny-llama" --input_format=ND --input_shape="input_ids:1,1;attention_mask:1,1025;position_ids:1,1;past_key_values:22,2,1,4,1024,64" --soc_version=Ascend310B4 --precision_mode=must_keep_origin_dtypecode>

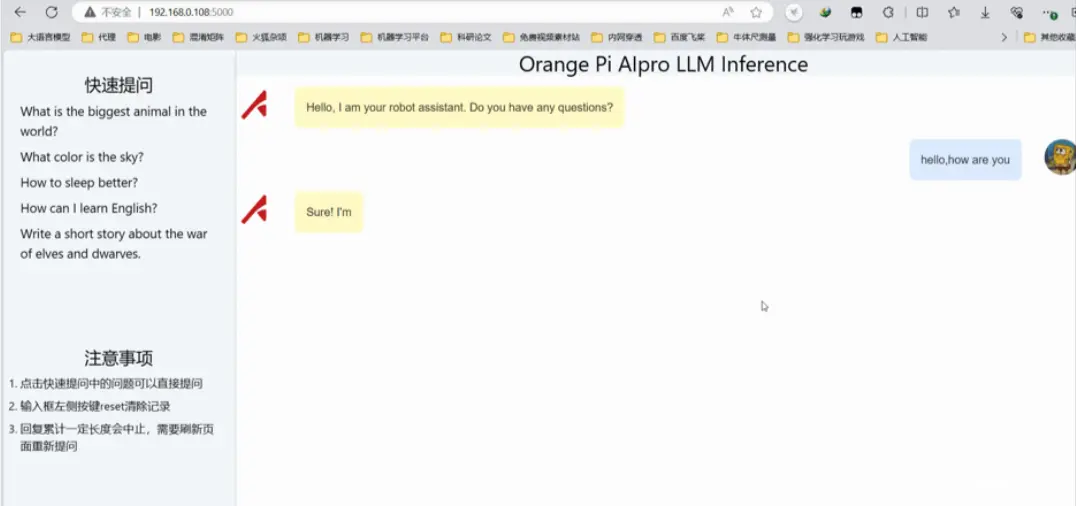

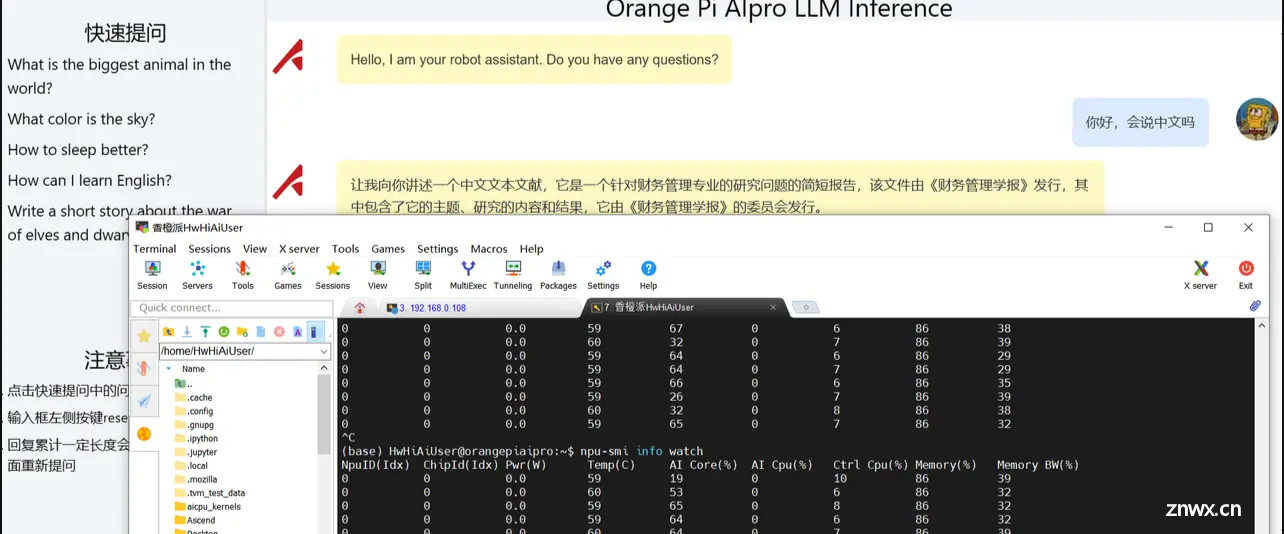

三、 项目体验

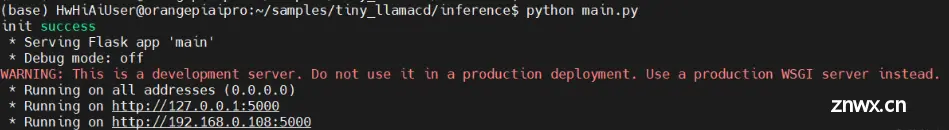

好了到这里我们就算是大功告成了,只需要启动一下mian文件就OK了

在 <code>cd tiny_llama/inference 目录下运行命令

python3 main.py

打开网址进行访问

Tiny-Llama这个模型由于尺寸非常小,参数也只有1.1B。所以在我们部署Tiny-Llama这个大语言模型推理过程中,Ai Core的占用率只到60%左右,基本是一秒俩个词左右,速度上是肯定没问题的。后期可以去试试升级一下内存去跑一下当下主流的 千问7B模型 或者 清华第二代大模型拥有 60 亿参数 ChatGLM2 感觉用 <code>OrangePi AIpro 这块板子也是没问题。

上一篇: UBUNTU22.04无法安装nvidia-driver-550 依赖于 nvidia-dkms-550 (<= 550.54.15-1)

下一篇: linux 之rz文件被直接输出到屏幕

本文标签

声明

本文内容仅代表作者观点,或转载于其他网站,本站不以此文作为商业用途

如有涉及侵权,请联系本站进行删除

转载本站原创文章,请注明来源及作者。