Linux:ollama+Dify大模型本地化部署打造个人知识库 (2)

DevOps菜鸟(Xu JieHao) 2024-08-12 12:37:01 阅读 96

ollama大模型部署-CSDN博客文章浏览阅读26次。Ollama 是一个能在本地机器上轻松构建和运行大型语言模型的轻量级、可扩展框架,适用于多种场景,具有易于使用、资源占用少、可扩展性强等特点。

https://blog.csdn.net/weixin_72819498/article/details/140094597

上一章我们部署了ollama大模型,Dify和ollama可以结合使用,以快速开发和部署AI应用。开发人员可以使用ollama在本地部署LLM,然后使用Dify进行应用开发和模型管理。

Dify介绍:

Dify 是一款开源的大语言模型(LLM)应用开发平台。它融合了后端即服务(Backend as Service)和 LLMOps 的理念,使开发者可以快速搭建生产级的生成式 AI 应用。即使是非技术人员,也能参与到 AI 应用的定义和数据运营过程中。

Dify 内置了构建 LLM 应用所需的关键技术栈,包括对数百个模型的支持、直观的 Prompt 编排界面、高质量的 RAG 引擎以及灵活的 Agent 框架,并同时提供了一套易用的界面和 API。这为开发者节省了许多重复造轮子的时间,使其可以专注于创新和业务需求。

通俗的讲dify就像一个壳是为了更方便的去使用大模型并可以将大模型本地化部署,打造个人知识库

功能比较

如果你想了解更多关于 Dify 的信息,可以访问其官方网站:https://dify.ai/

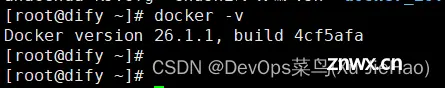

1.检查是否拥有Docker环境

Windows和Linux系统部署Docker容器(2)_docker windows linux-CSDN博客文章浏览阅读1.1k次,点赞44次,收藏23次。Docker并非是一个通用的容器工具,它依赖于已存在并运行的Linux内核环境。Docker实质上是在一个已运行的Linux下制造了一个隔离的文件环境,因此它执行的效率几乎等同于所部署的Linux主机。_docker windows linux

https://blog.csdn.net/weixin_72819498/article/details/139295581

docker -v

2.从gitlab上克隆代码到服务器

#由于网站在国外很有可能拉取不下来,可能要多尝试几次,实在不行就配置镜像加速器

Docker配置国内镜像加速-2_配置docker加速-CSDN博客

git clone https://github.com/langgenius/dify.git

3.进入 dify 源代码的 docker 目录,执行一键启动命令:

[root@dify ~]# cd dify/docker

[root@dify docker]# docker compose up -d

部署结果:

#如果全是对钩代表镜像拉取成功

4.浏览器访问:

服务器IP地址

http://192.168.100.102

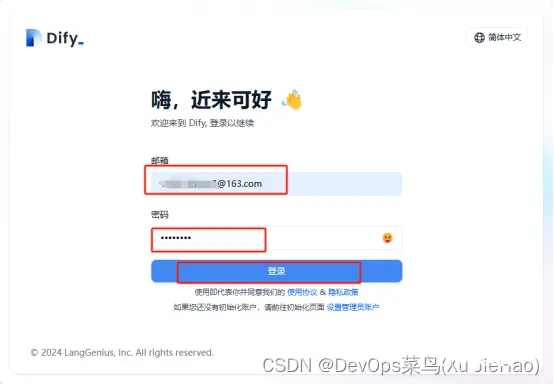

(1)注册管理员账号

密码:123.com!

#注意:密码必须满足复杂度(数字字母+特殊符号不少于8为)

(2)登录账号

这样就进入了它的管理界面

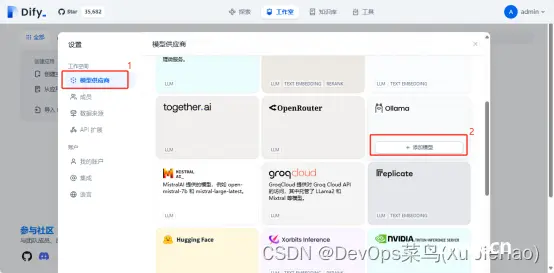

5.添加ollama大模型

所测选择‘模型供应商’------ ‘ollama添加模型’

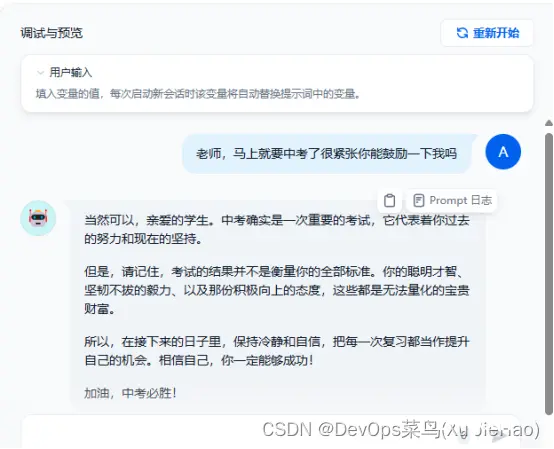

6.创建智能助手

(1)设置提示词

(2)尝试对话

(3)添加扩展工具

(4)添加开场白

声明

本文内容仅代表作者观点,或转载于其他网站,本站不以此文作为商业用途

如有涉及侵权,请联系本站进行删除

转载本站原创文章,请注明来源及作者。