通过ollama与gguf文件可以在电脑上运行一个属于自己的离线AI模型,比闭源模型更可以保护隐私信息不被泄露。另外,在自己的电脑上集成AI模型可以随时随地使用,不被网络环境限制_ollama使用本地uggf...

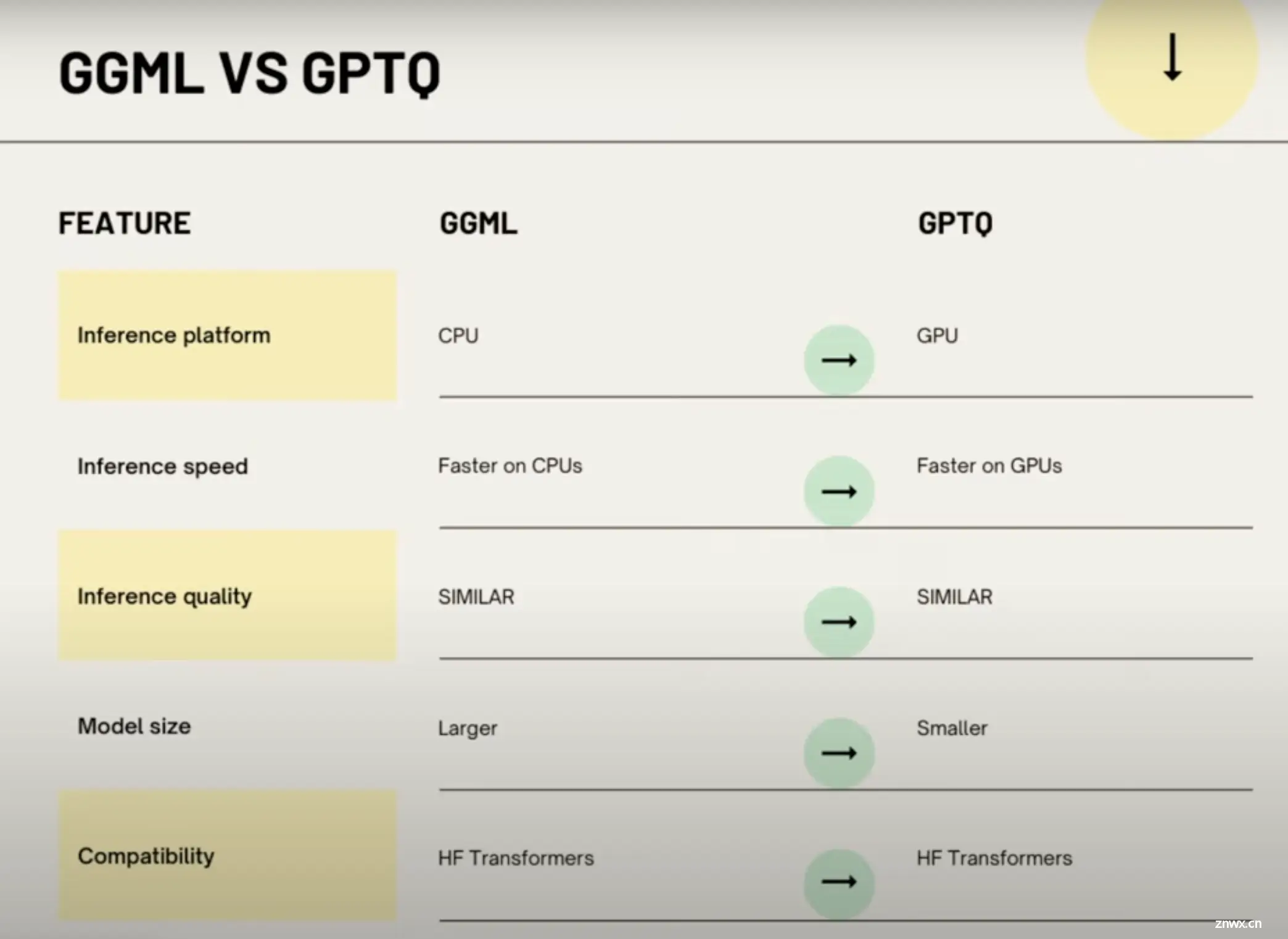

GGUF格式的全名为(GPT-GeneratedUnifiedFormat),提到GGUF就不得不提到它的前身GGML(GPT-GeneratedModelLanguage)。GGML是专门为了...

源2.0是浪潮信息发布的新一代基础语言大模型。我们开源了全部的3个模型源2.0-102B,源2.0-51B和源2.0-2B。并且我们提供了预训练,微调,推理服务的相关脚本,以供研发人员做进一步的开发。源2.0是...

本文总结了HuggingFace上模型的常见量化格式,量化技术是AI模型部署的重要技术,它可以大大减小模型的大小和推理所需的显存。想要让大语言模型真正地走进普通人的生活,在每个人的手机上能运行起来,做到真...