Datawhale X 魔搭 AI夏令营第四期 | AIGC文生图——可图Kolors-LoRA风格故事 Task1笔记

半亩花海 2024-08-19 14:31:03 阅读 59

Hi,大家好,我是半亩花海。最近在尝试学习AIGC的内容,并报名参加了Datawhale举办的2024年AI第四期夏令营,主要学习内容是从零入门AI生图原理和实践。本次活动基于魔搭社区“可图Kolors-LoRA风格故事挑战赛”进而开展的项目实践学习,很适合像我这样的想入门并实践AIGC文生图的初学者参与。

一、项目解读

1. 官方教程:Task 1 从零入门AI生图原理&实践

2. 项目任务:

在可图Kolors模型的基础上训练LoRA模型,生成无限风格,如水墨画风格、水彩风格、赛博朋克风格、日漫风格......基于 LoRA 模型生成8张图片组成连贯故事,故事内容可自定义;基于8图故事,评估LoRA风格的美感度及连贯性

样例:偶像少女养成日记(如下图所示)

二、文生图

2.1 文生图的历史

文生图(Text-to-Image Generation)是一种通过文本生成图像的技术,其发展历程可以追溯到早期的计算机视觉和自然语言处理研究。这一技术的历史可以分为几个关键阶段:

早期探索(20世纪60年代-20世纪90年代)基于统计模型的方法(2000年代)深度学习的崛起(2010年代)大规模预训练模型(2020年代)

2.2 文生图的基础知识介绍

文生图主要以 SD 系列基础模型为主,以及在其基础上微调的 LoRA 模型和人物基础模型等。

提示词:一般写法为主体描述,细节描述,修饰词,艺术风格,艺术家LoRA:Low-Rank Adaptation,低秩适应,轻量级的微调方法,被用来对预训练好的大模型进行针对性优化,以实现对特定主题、风格或任务的精细化控制。ComfyUI:是一个工作流工具,主要通过直观的界面和集成实现AI模型配置和训练过程的简化和优化。参考图控制:ControlNet 是一种用于精确控制图像生成过程的技术组件,通过引入额外的控制信号,用户能更具体地指导图像生成的各方面(如姿势关键点、分割图、深度图、颜色等)。

三、跑通baseline

3.1 搭建代码平台

链接:阿里云免费试用 - 阿里云 (aliyun.com)。

1. 开通阿里云PAI-DSW免费试用

新用户需要先注册,再绑定阿里云账号新用户还需要完成阿里云账号的实名认证

按照下面的步骤开通PAI-DSW试用,即可获得5000算力时且有效期3个月,如下所示即可。

2. 授权魔搭社区

链接:我的Notebook · 魔搭社区。

按操作正常进行至如下图即可(如果这一步授权失败,可跳过此步骤,继续往下进行)。

3. 报名赛事

赛事链接:可图Kolors-LoRA风格故事挑战赛_创新应用大赛_天池大赛-阿里云天池的赛制。

点击报名参赛,则报名成功,再自己组个队即可。

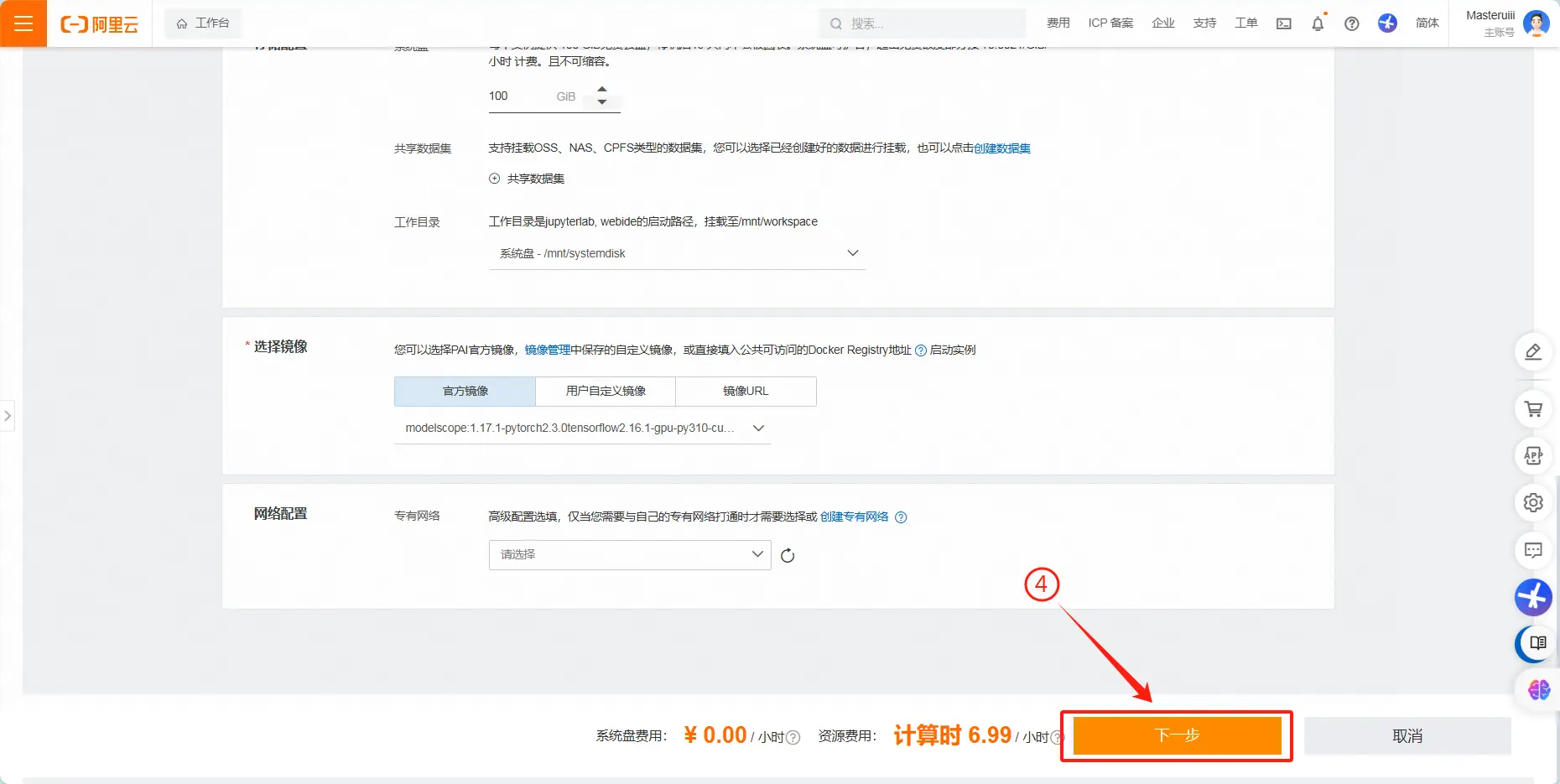

4. 在魔搭社区创建PAI实例

链接:我的Notebook · 魔搭社区。

接下来我们便可以在ModelScope里面创建实例。如果在上一步授权失败,可到阿里云控制台创建 并打开实例,具体步骤详见下方步骤。

打开实例之后 ,出现下面右侧的界面即为打开实例成功:

点击 Terminal,可以进入终端/命令行,如下所示。

3.2 半小时体验一站式baseline

1. 下载baseline文件

<code>git lfs install

git clone https://www.modelscope.cn/datasets/maochase/kolors.git

2. 打开baseline文件

3. 安装环境并重启kernel

<code>!pip install simple-aesthetics-predictor

!pip install -v -e data-juicer

!pip uninstall pytorch-lightning -y

!pip install peft lightning pandas torchvision

!pip install -e DiffSynth-Studio

安装 Data-Juicer 和 DiffSynth-Studio。

Data-Juicer:数据处理和转换工具,旨在简化数据的提取、转换和加载过程DiffSynth-Studio:高效微调训练大模型工具

环境安装完成后,点击下面这个按钮(restart the kernel)进行重启。

4. 调整prompt并设置图片风格及描述(可选)

正向描述词:你想要生成的图片应该包含的内容反向提示词:你不希望生成的图片的内容

5. 运行代码+获得图片

下面的代码块按照功能主要分成这几类(完整代码见最后):

使用Data-Juicer处理数据,整理训练数据文件使用DiffSynth-Studio在基础模型上,使用前面整理好的数据文件进行训练微调加载训练微调后的模型使用微调后的模型,生成用户指定的prompt提示词的图片

3.3 将微调结果上传魔搭

链接:模型创建 · 魔搭社区。

1. 移动结果文件

新建 Terminal(File→New→Terminal),粘贴如下命令,回车执行。

<code>mkdir /mnt/workspace/kolors/output & cd

cp /mnt/workspace/kolors/models/lightning_logs/version_0/checkpoints/epoch\=0-step\=500.ckpt /mnt/workspace/kolors/output/

cp /mnt/workspace/kolors/1.jpg /mnt/workspace/kolors/output/

2. 下载结果文件

双击进入output文件夹,分别下载两个文件到本地。

3. 创建并上传模型

点击魔搭链接,创建模型,英文名称建议格式:xxx-LoRA;中文名称建议格式:队伍名称-可图Kolors训练-xxx。

这样就算创建完成并发布在创空间讨论区了。此外,我们也可以来到创空间,查看自己的模型是否发布:进入专区→模型→(输入账号名)。

3.4 关闭PAI实例

链接:我的Notebook · 魔搭社区。

运行完成后,别忘了回到魔搭,【关闭】实例,否则会一直消耗你的试用额度。每小时消耗大概7个试用额度(总共5000个,有效期三个月)。

四、完整代码(汇总版)

代码其实baseline文件里就有,这里再放一下保持文章的完整性。

4.1 安装Data-Juicer 和 DiffSynth-Studio

<code>!pip install simple-aesthetics-predictor

!pip install -v -e data-juicer

!pip uninstall pytorch-lightning -y

!pip install peft lightning pandas torchvision

!pip install -e DiffSynth-Studio

再重启 Notebook kernel:找到 “restart the kernel” 这个按钮即可。

4.2 下载数据集

1. 加载并缓存数据集(lowres_anime)的训练部分

from modelscope.msdatasets import MsDataset

ds = MsDataset.load(

'AI-ModelScope/lowres_anime',

subset_name='default',code>

split='train',code>

cache_dir="/mnt/workspace/kolors/data"code>

)

2. 保存数据集中的图片及元数据

import json, os

from data_juicer.utils.mm_utils import SpecialTokens

from tqdm import tqdm

os.makedirs("./data/lora_dataset/train", exist_ok=True)

os.makedirs("./data/data-juicer/input", exist_ok=True)

with open("./data/data-juicer/input/metadata.jsonl", "w") as f:

for data_id, data in enumerate(tqdm(ds)):

image = data["image"].convert("RGB")

image.save(f"/mnt/workspace/kolors/data/lora_dataset/train/{data_id}.jpg")

metadata = {"text": "二次元", "image": [f"/mnt/workspace/kolors/data/lora_dataset/train/{data_id}.jpg"]}

f.write(json.dumps(metadata))

f.write("\n")

4.3 数据处理

1. 使用 data-juicer 处理数据

data_juicer_config = """

# global parameters

project_name: 'data-process'

dataset_path: './data/data-juicer/input/metadata.jsonl' # path to your dataset directory or file

np: 4 # number of subprocess to process your dataset

text_keys: 'text'

image_key: 'image'

image_special_token: '<__dj__image>'

export_path: './data/data-juicer/output/result.jsonl'

# process schedule

# a list of several process operators with their arguments

process:

- image_shape_filter:

min_width: 1024

min_height: 1024

any_or_all: any

- image_aspect_ratio_filter:

min_ratio: 0.5

max_ratio: 2.0

any_or_all: any

"""

with open("data/data-juicer/data_juicer_config.yaml", "w") as file:

file.write(data_juicer_config.strip())

!dj-process --config data/data-juicer/data_juicer_config.yaml

2. 保存处理好的数据

import pandas as pd

import os, json

from PIL import Image

from tqdm import tqdm

texts, file_names = [], []

os.makedirs("./data/lora_dataset_processed/train", exist_ok=True)

with open("./data/data-juicer/output/result.jsonl", "r") as file:

for data_id, data in enumerate(tqdm(file.readlines())):

data = json.loads(data)

text = data["text"]

texts.append(text)

image = Image.open(data["image"][0])

image_path = f"./data/lora_dataset_processed/train/{data_id}.jpg"

image.save(image_path)

file_names.append(f"{data_id}.jpg")

data_frame = pd.DataFrame()

data_frame["file_name"] = file_names

data_frame["text"] = texts

data_frame.to_csv("./data/lora_dataset_processed/train/metadata.csv", index=False, encoding="utf-8-sig")code>

data_frame

4.4 训练模型

1. 下载模型

from diffsynth import download_models

download_models(["Kolors", "SDXL-vae-fp16-fix"])

2. 查看训练脚本的输入参数

!python DiffSynth-Studio/examples/train/kolors/train_kolors_lora.py -h

3. 开始训练

提示:

在训练命令中填入 --modelscope_model_id xxxxx 以及 --modelscope_access_token xxxxx 后,训练程序会在结束时自动上传模型到 ModelScope部分参数可根据实际需求调整,例如 lora_rank 可以控制 LoRA 模型的参数量

import os

cmd = """

python DiffSynth-Studio/examples/train/kolors/train_kolors_lora.py \

--pretrained_unet_path models/kolors/Kolors/unet/diffusion_pytorch_model.safetensors \

--pretrained_text_encoder_path models/kolors/Kolors/text_encoder \

--pretrained_fp16_vae_path models/sdxl-vae-fp16-fix/diffusion_pytorch_model.safetensors \

--lora_rank 16 \

--lora_alpha 4.0 \

--dataset_path data/lora_dataset_processed \

--output_path ./models \

--max_epochs 1 \

--center_crop \

--use_gradient_checkpointing \

--precision "16-mixed"

""".strip()

os.system(cmd)

4. 加载模型

from diffsynth import ModelManager, SDXLImagePipeline

from peft import LoraConfig, inject_adapter_in_model

import torch

def load_lora(model, lora_rank, lora_alpha, lora_path):

lora_config = LoraConfig(

r=lora_rank,

lora_alpha=lora_alpha,

init_lora_weights="gaussian",code>

target_modules=["to_q", "to_k", "to_v", "to_out"],

)

model = inject_adapter_in_model(lora_config, model)

state_dict = torch.load(lora_path, map_location="cpu")code>

model.load_state_dict(state_dict, strict=False)

return model

# Load models

model_manager = ModelManager(torch_dtype=torch.float16, device="cuda",code>

file_path_list=[

"models/kolors/Kolors/text_encoder",

"models/kolors/Kolors/unet/diffusion_pytorch_model.safetensors",

"models/kolors/Kolors/vae/diffusion_pytorch_model.safetensors"

])

pipe = SDXLImagePipeline.from_model_manager(model_manager)

# Load LoRA

pipe.unet = load_lora(

pipe.unet,

lora_rank=16, # This parameter should be consistent with that in your training script.

lora_alpha=2.0, # lora_alpha can control the weight of LoRA.

lora_path="models/lightning_logs/version_0/checkpoints/epoch=0-step=500.ckpt"code>

)

5. 生成图像

torch.manual_seed(0)

image = pipe(

prompt="二次元,一个紫色短发小女孩,在家中沙发上坐着,双手托着腮,很无聊,全身,粉色连衣裙",code>

negative_prompt="丑陋、变形、嘈杂、模糊、低对比度",code>

cfg_scale=4,

num_inference_steps=50, height=1024, width=1024,

)

image.save("1.jpg")

torch.manual_seed(1)

image = pipe(

prompt="二次元,日系动漫,演唱会的观众席,人山人海,一个紫色短发小女孩穿着粉色吊带漏肩连衣裙坐在演唱会的观众席,舞台上衣着华丽的歌星们在唱歌",code>

negative_prompt="丑陋、变形、嘈杂、模糊、低对比度",code>

cfg_scale=4,

num_inference_steps=50, height=1024, width=1024,

)

image.save("2.jpg")

torch.manual_seed(2)

image = pipe(

prompt="二次元,一个紫色短发小女孩穿着粉色吊带漏肩连衣裙坐在演唱会的观众席,露出憧憬的神情",code>

negative_prompt="丑陋、变形、嘈杂、模糊、低对比度,色情擦边",code>

cfg_scale=4,

num_inference_steps=50, height=1024, width=1024,

)

image.save("3.jpg")

torch.manual_seed(5)

image = pipe(

prompt="二次元,一个紫色短发小女孩穿着粉色吊带漏肩连衣裙,对着流星许愿,闭着眼睛,十指交叉,侧面",code>

negative_prompt="丑陋、变形、嘈杂、模糊、低对比度,扭曲的手指,多余的手指",code>

cfg_scale=4,

num_inference_steps=50, height=1024, width=1024,

)

image.save("4.jpg")

torch.manual_seed(0)

image = pipe(

prompt="二次元,一个紫色中等长度头发小女孩穿着粉色吊带漏肩连衣裙,在练习室练习唱歌",code>

negative_prompt="丑陋、变形、嘈杂、模糊、低对比度",code>

cfg_scale=4,

num_inference_steps=50, height=1024, width=1024,

)

image.save("5.jpg")

torch.manual_seed(1)

image = pipe(

prompt="二次元,一个紫色长发小女孩穿着粉色吊带漏肩连衣裙,在练习室练习唱歌,手持话筒",code>

negative_prompt="丑陋、变形、嘈杂、模糊、低对比度",code>

cfg_scale=4,

num_inference_steps=50, height=1024, width=1024,

)

image.save("6.jpg")

torch.manual_seed(7)

image = pipe(

prompt="二次元,紫色长发少女,穿着黑色连衣裙,试衣间,心情忐忑",code>

negative_prompt="丑陋、变形、嘈杂、模糊、低对比度",code>

cfg_scale=4,

num_inference_steps=50, height=1024, width=1024,

)

image.save("7.jpg")

torch.manual_seed(0)

image = pipe(

prompt="二次元,紫色长发少女,穿着黑色礼服,连衣裙,在台上唱歌",code>

negative_prompt="丑陋、变形、嘈杂、模糊、低对比度",code>

cfg_scale=4,

num_inference_steps=50, height=1024, width=1024,

)

image.save("8.jpg")

import numpy as np

from PIL import Image

images = [np.array(Image.open(f"{i}.jpg")) for i in range(1, 9)]

image = np.concatenate([

np.concatenate(images[0:2], axis=1),

np.concatenate(images[2:4], axis=1),

np.concatenate(images[4:6], axis=1),

np.concatenate(images[6:8], axis=1),

], axis=0)

image = Image.fromarray(image).resize((1024, 2048))

image

4.5 将微调结果上传魔搭

链接:模型创建 · 魔搭社区。

移动结果文件:新建 Terminal(File→New→Terminal),粘贴如下命令,回车执行。

mkdir /mnt/workspace/kolors/output & cd

cp /mnt/workspace/kolors/models/lightning_logs/version_0/checkpoints/epoch\=0-step\=500.ckpt /mnt/workspace/kolors/output/

cp /mnt/workspace/kolors/1.jpg /mnt/workspace/kolors/output/

上一篇: Spring AI教程(三):如何使用Spring AI进行实际项目开发

下一篇: 人工神经网络:竞争型学习

本文标签

Datawhale X 魔搭 AI夏令营第四期 | AIGC文生图——可图Kolors-LoRA风格故事 Task1笔记

声明

本文内容仅代表作者观点,或转载于其他网站,本站不以此文作为商业用途

如有涉及侵权,请联系本站进行删除

转载本站原创文章,请注明来源及作者。