在人工智能的宏伟蓝图中,大语言模型(LLM)的预训练是构筑智慧之塔的基石。预训练过程通过调整庞大参数空间以吸纳数据中蕴含的知识,为模型赋予从语言理解到文本生成等多样化能力。本文将深入探讨预训练过程中的技术细节、...

大规模语言模型(LargeLanguageModels,LLM),也称大语言模型或大型语言模型,是一种由包含数百亿以上参数的深度神经网络构建的语言模型,通常使用自监督学习方法通过大量无标注文本进行训练。_统...

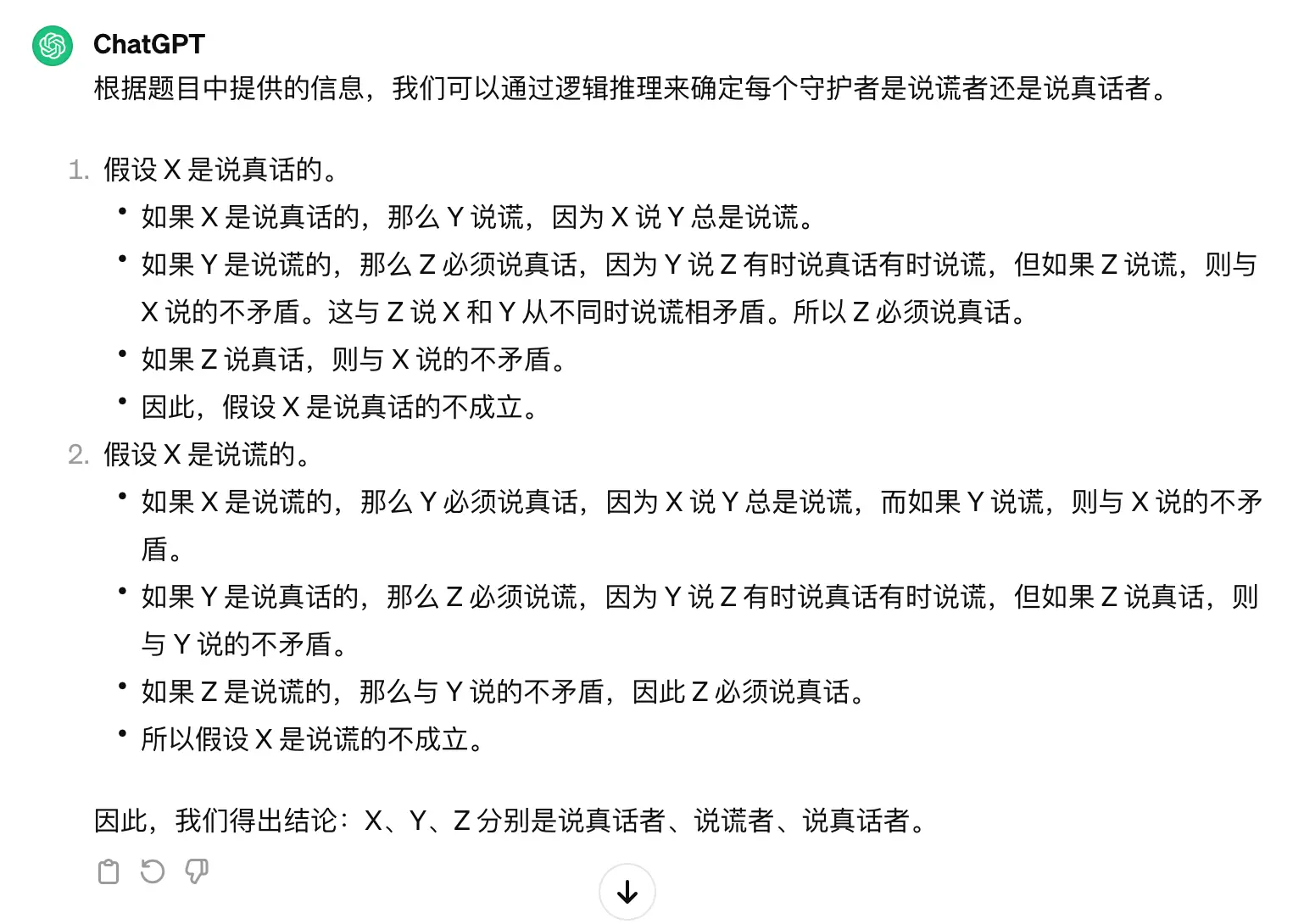

一道题告诉你为什么GPT4被封神!横向测评大模型的推理能力:ChatGPT、Claude、Gemini、文心一言、讯飞星火、通义千问、天工、智谱清言、KimiChat!_智谱清言对比通义千问...

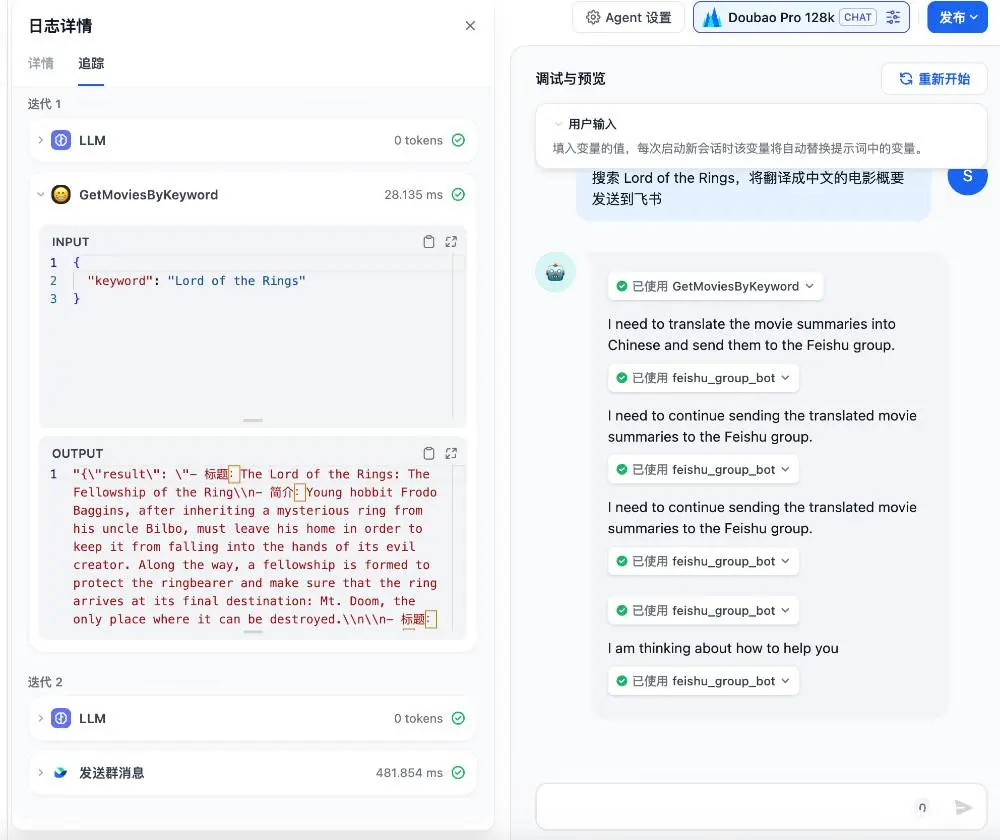

这篇文章,我们继续聊聊,如何折腾AI应用,把不AI的东西,“AI起来”。在不折腾复杂的系统和环境的前提下,快速完成轻量的Agent应用。_dify编排java...

智能体借助工具排查问题得出结论的整个过程与人类行为已经基本没有大的差别。智能体基本没用exec_command这种通用工具,而是选择合适的垂直工具(get_namenodes、namenode_log等),这点与...

在最近几年,深度学习在自然语言处理领域取得的突破性进展,已经彻底改变了我们理解和挖掘文本数据的方式。特别是在情感分析这一具有挑战性的任务上,大模型证明了其无与伦比的能力。深度学习的核心理念在于通过模仿生物神经网络...

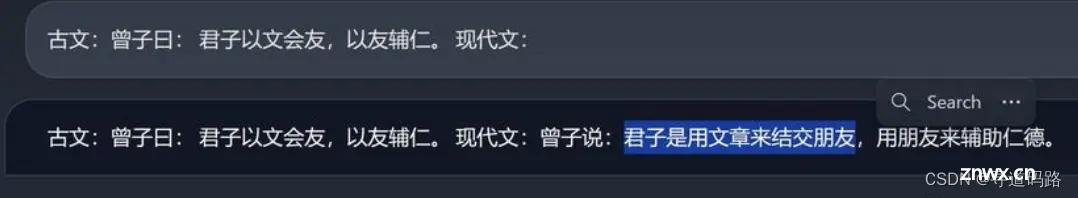

tiktoken是OpenAI开发的一种BPE分词器。给定一段文本字符串(例如,)和一种编码方式(例如,),分词器可以将文本字符串切分成一系列的token(例如,将文本字符串切分成token非常有用,因为GPT模型看到...

Ollama是一个用于在本地计算机上运行大模型的软件软件运行后端口,自己写的程序要调大模型就用这个端口ollamalist:显示模型列表ollamashow:显示模型的信息ollamapull:拉取模型ollam...

作为一名经验充足的AI全栈工程师,2024年我计划把我的经验总结出一套知识库免费分享给大家,感兴趣的小伙伴可以关注我一起学习。_ai开发技术栈...

AI大模型的战场正在分化,通用与垂直的较量才刚刚开始。无论是通用大模型的广泛适用性,还是垂直大模型的专业优势,它们都在推动着人工智能技术的发展和应用。作为观察者和参与者,我们更应关注这场竞争背后的技术创新和市场动态,...