LLM的知识仅限于它所训练的数据。如果你想让LLM了解特定领域的知识或专有数据,你可以使用RAG。什么是RAG?简而言之,RAG(检索增强生成)是从数据中查找和注入相关信息的方法再将其发送到LLM之前...

langchain-chatchat0.3x从零开始本地部署搭建,rag本地知识库学习_langchain-chatchat0.3...

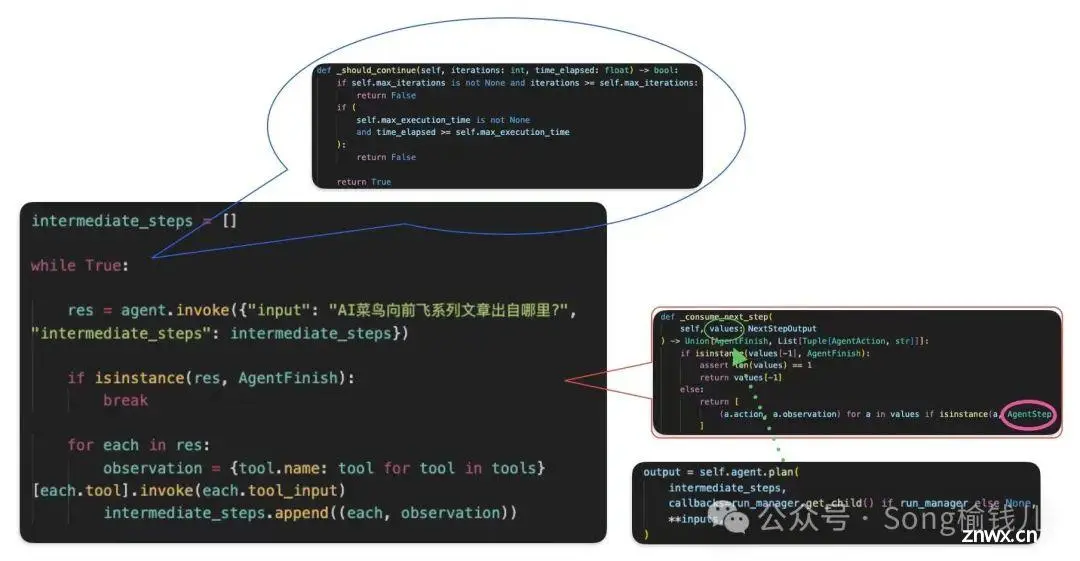

本篇从源代码角度深入浅出剖析AgentExecutor实现的机制,介绍了AgentStep、AgentPlan等内容,并做对比分析,结尾处补充介绍tool的另一个属性值return_direct的含义和作用。_la...

Langchain-Chatchat是一个基于ChatGLM、Qwen等大语言模型与Langchain等应用框架实现,开源、可离线部署的RAG与Agent应用项目。目前支持Agent、LLM对话、知识...

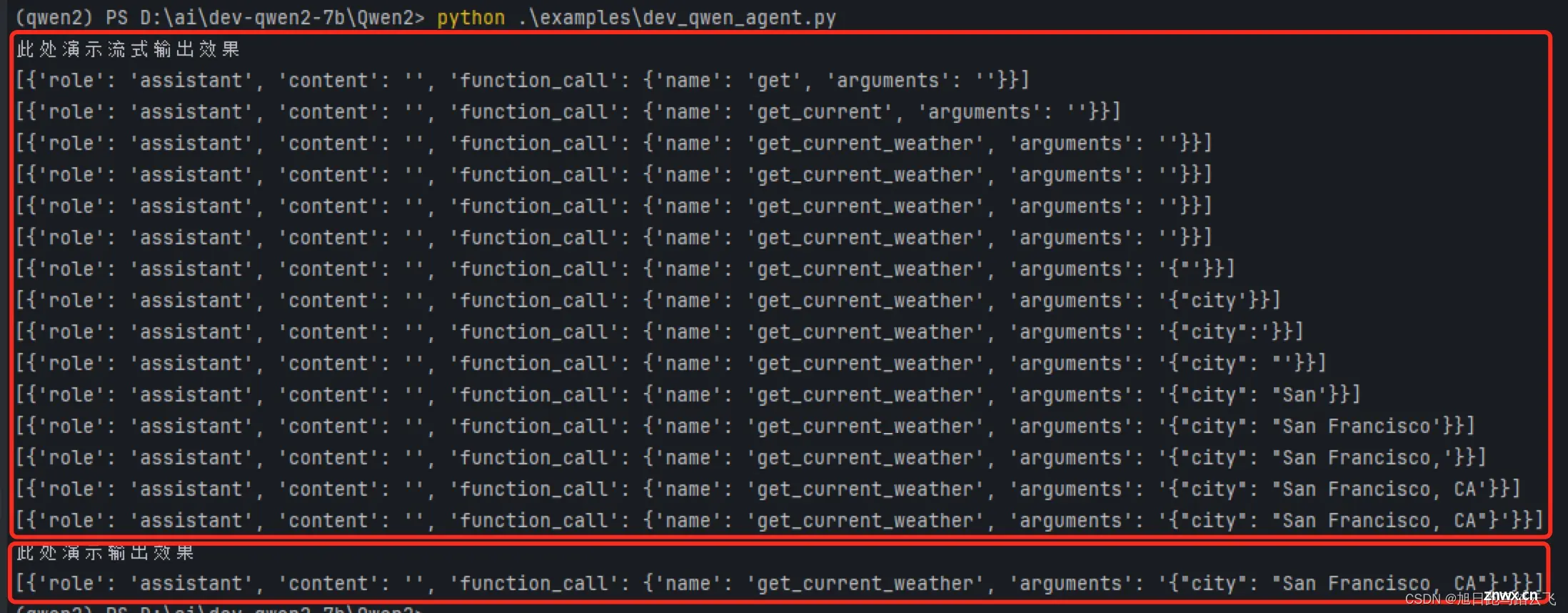

在目前AI的世界里,各大模型都还是跟着OpenAI在跑,API也尽量跟OpenAI保持一致。所以这里大致会有三个场景:OpenAI,其余模型自身的封装-这里选择qwen-agent,以及通用封装框架-这里选择La...

我们除了可以使用Langchain进行模型对话、提示词创作、嵌入模型,还可以使用其他的组件对大模型封装使用,打造我们自己的大模型。_langchain文心一言agent...

SemanticKernel:一个集成大型语言模型(LLM)的SDK,如OpenAI、AzureOpenAI、以及使用C#、Python和Java等传统编程语言的HuggingFace。...

本文将聚焦于LangChain框架中的两大璀璨明珠——示例选择器和输出解析器,深入探讨它们如何与Prompt精妙结合,共同编织出提升NLP任务效率与准确性的精密网络。示例选择器通过提供精心挑选的示例来增强Prompt...

上次在MacbookPro上安装了StableDiffusion,体验了本地所心所欲地生成各种心仪的图片,完全没有任何限制的惬意。今天想使用MacbookPro安装一个本地大语言模型体验一下,刚好在2024...

在探索人工智能与自然语言处理领域时,“Prompt”是一个核心概念,尤其在Langchain中,它是连接人类与机器思维的桥梁,能解锁模型潜能。本篇博客将深入这一领域,首先揭开Prompt的神秘面纱,随后剖析La...