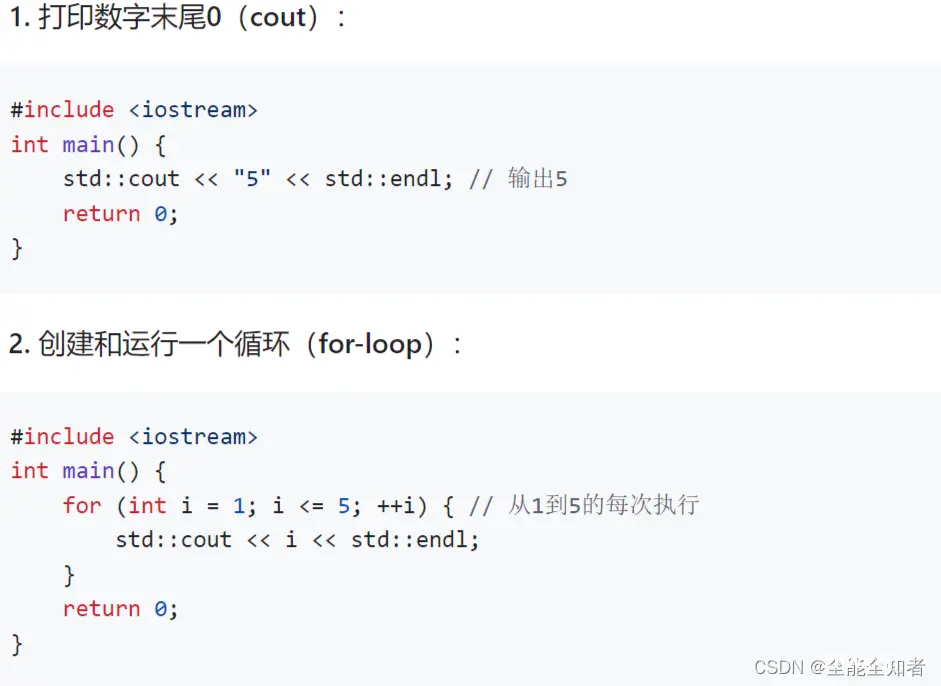

在实现本地ai模型对话网页中,流数据和markdown样式和实时显示问题折腾了挺久了,现在弄好之后赶紧,写了几篇文章分享思路给大家。数据都是实时显示出来的,不是全部接收完才显示的。_ollama前端...

在docker中部署ollama体验AI模型。_ollamadocker...

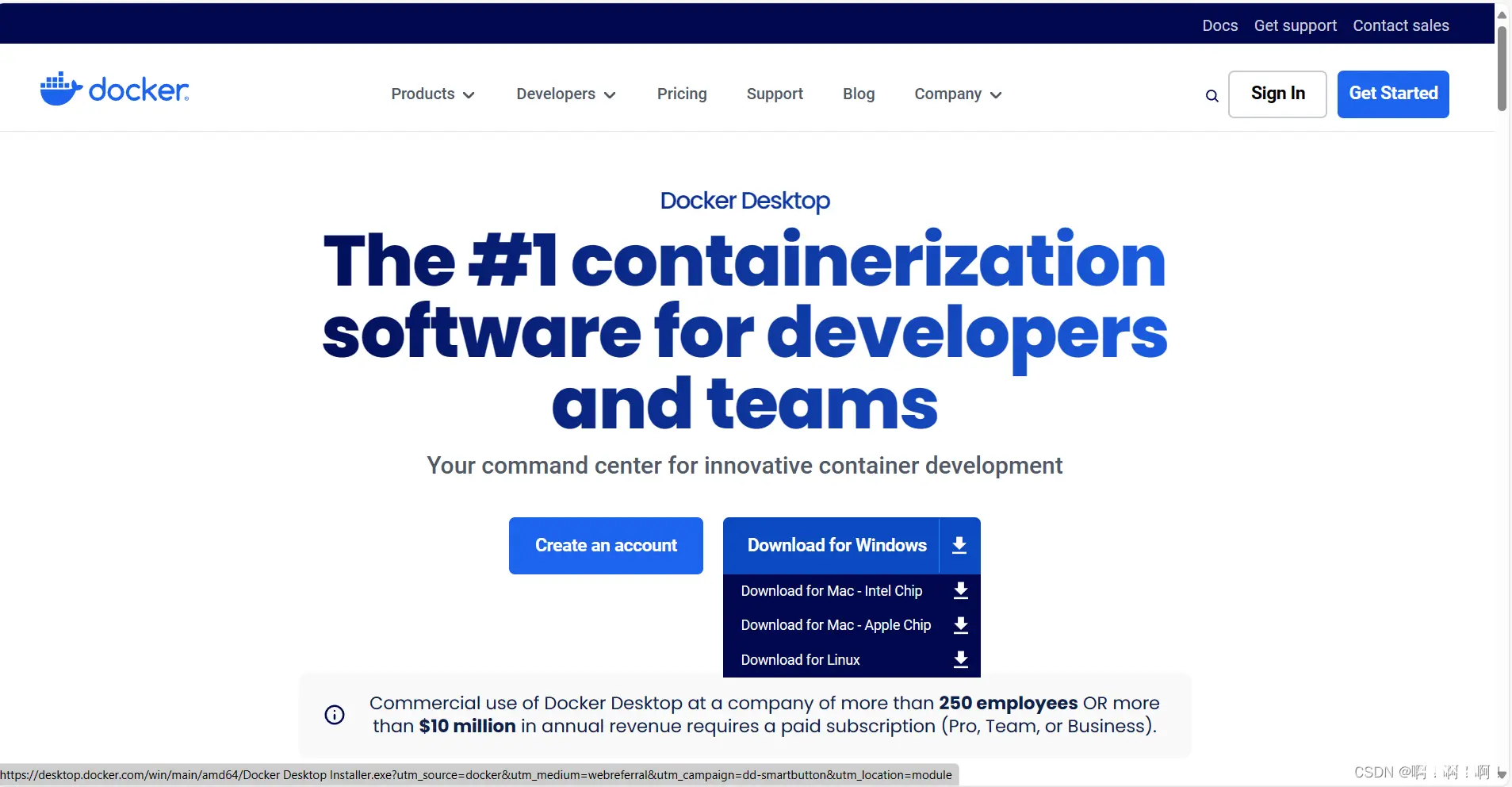

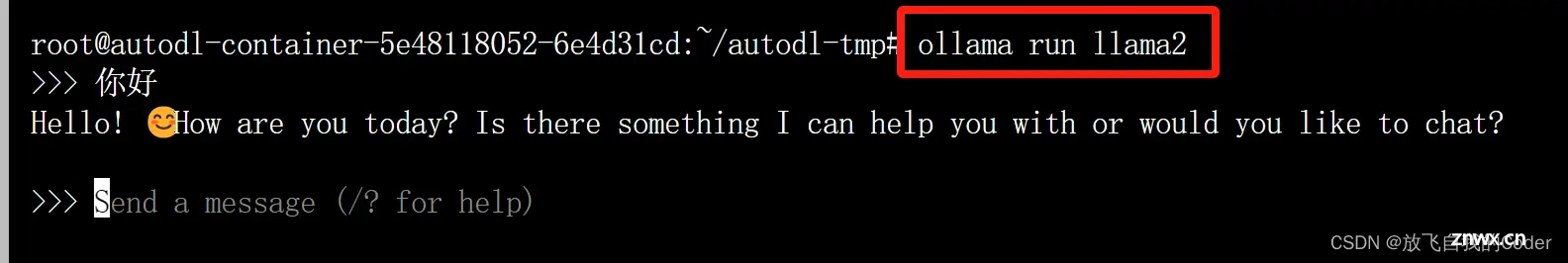

要先安装docker,再用docker安装ollama和open-webui,如果直接去ollama官网下载安装的话,我去打开ollama总是会闪退,虽然ollama的图标还在,但是去访问http://127.0...

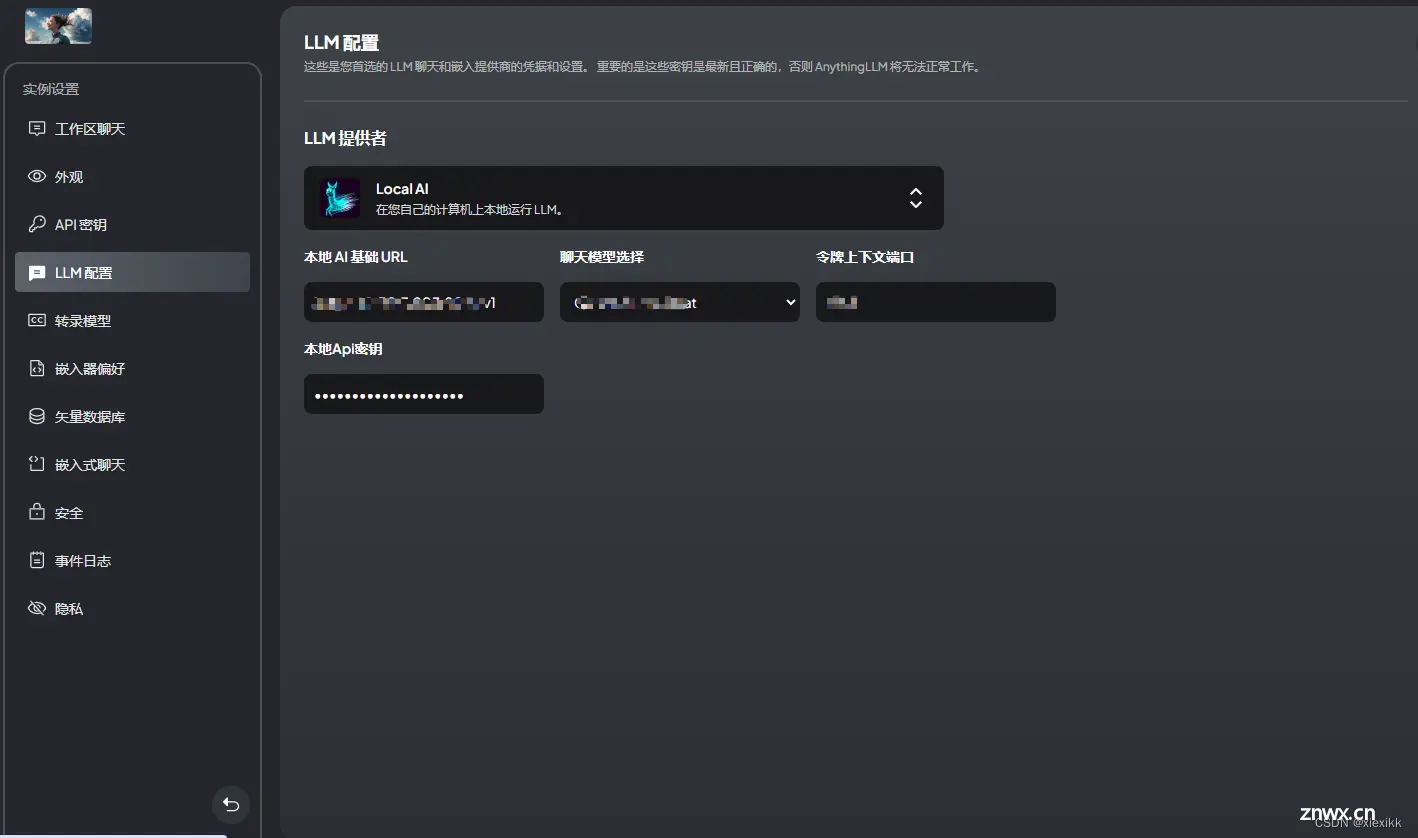

AnythingLLM是一个全栈应用程序,您可以使用商业现成的LLM或流行的开源LLM和vectorDB解决方案来构建私有ChatGPT,无需任何妥协,您可以在本地运行,也可以远程托管并能够智能聊天以...

如果修改了OLLAMA_MODELS环境变量,把之前下载的OLLAMA_MODELS目录变量下的两个目录。浏览器下载https://ollama.com/download/ollama-linux-amd6...

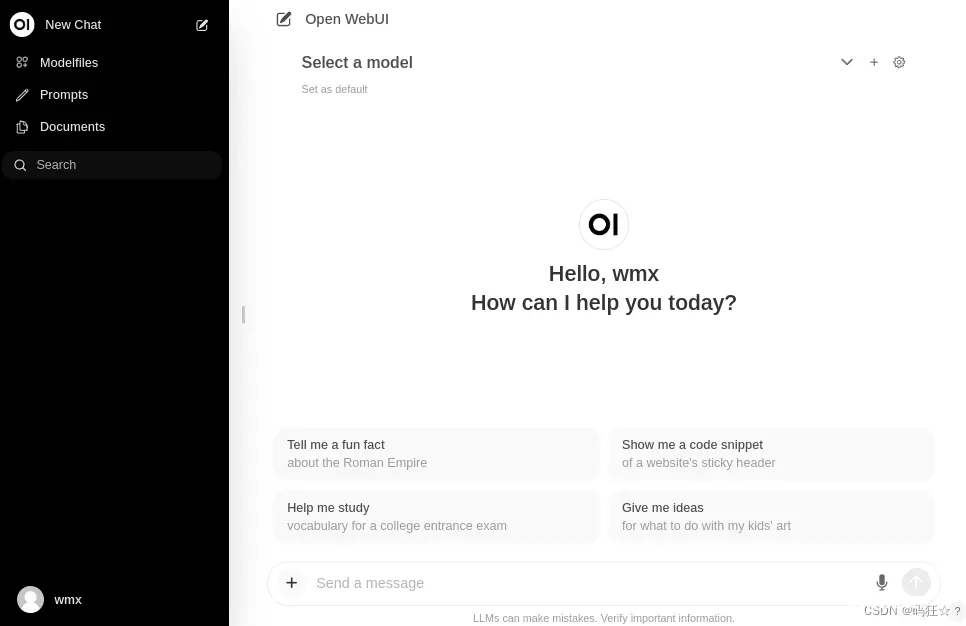

【linux使用ollama部署运行本地大模型完整的教程,openai接口,llama2例子】_ollamalinux...

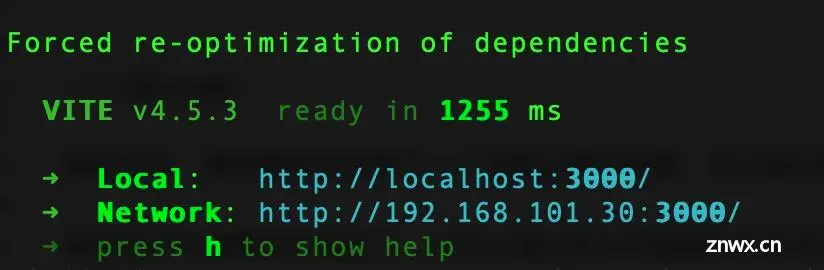

在上一篇博文中,我们在本地部署了**Llama38B**参数大模型,并用Python写了一个控制台对话客户端,基本能愉快的与Llama大模型对话聊天了。但控制台总归太技术化,体验不是很友好,我们希望能有...

本文对FacebookMetaAI最新提出的大语言模型LLaMA进行简单的介绍,以及对其开源出的代码和细节进行了详细的说明。_llama模型结构...

重命名镜像(如果是通过代理下载的)dockertagghcr.dockerproxy.com/open-webui/open-webui:mainghcr.io/open-webui/open-webui:...

ASR:funasr支持语音实时语音打断:这是通过子进程的控制创建与杀掉,这里是通过有人再次说话就打断tts参考:1)ASR(实时语音转录,支持自动vad识别)Pipe2)ollamaapi接口decode3)t...