我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到...

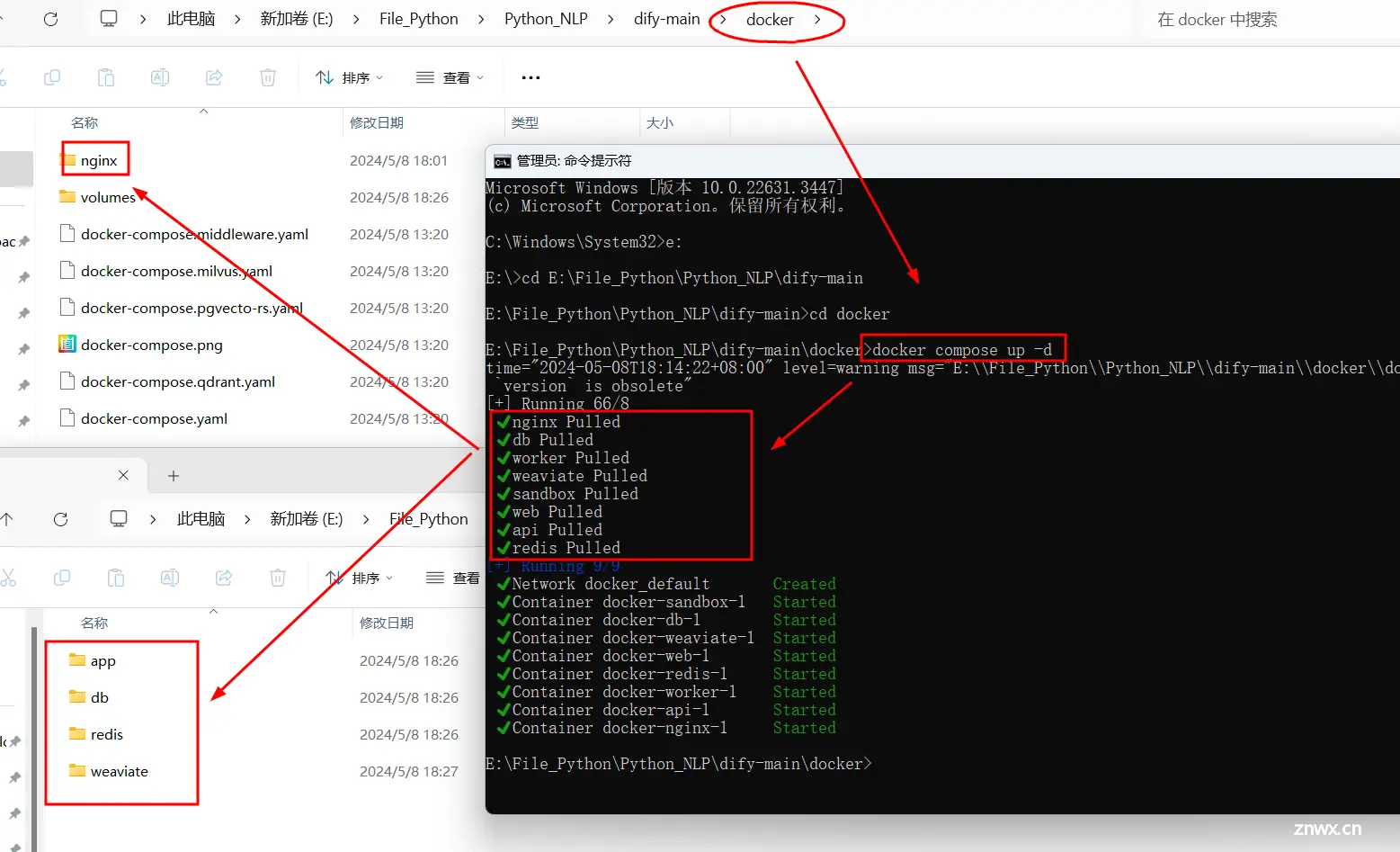

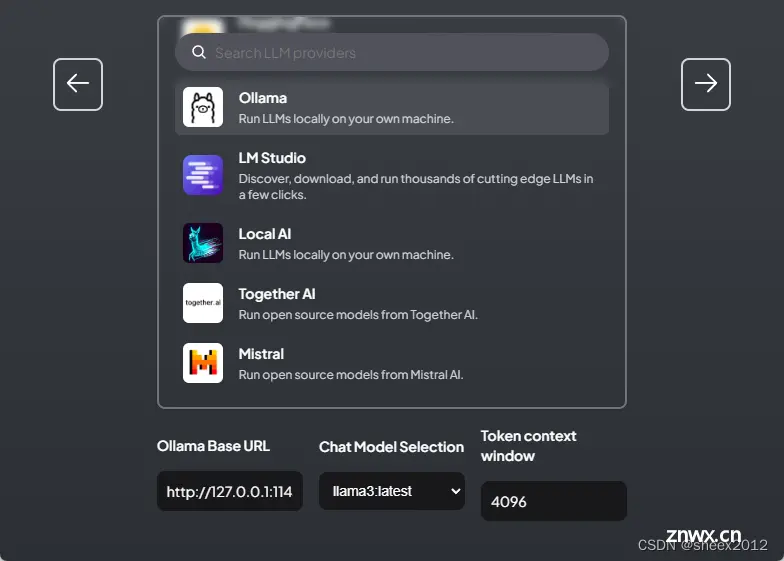

LLMs之Dify:Dify的简介、安装和使用方法、案例应用之详细攻略目录Dify的简介Dify的安装和使用方法Dify的案例应用Dify的简介2023年5月,Dify正式发布,这是一个开源的LLM应用程序开发平台...

大型模型在计算机科学领域具有重要意义,它们可以看作是一种超大量函数复合的函数式编程方法。通过实现函数式编程的关键概念和技术,可以充分发挥其性能优势并缓解潜在挑战。尽管如此,我们仍需要关注其计算资源需求、过拟合风险、理解与解释性差以及隐私和安...

本地运行大模型耗资源,需要选择较小的模型作为基础模型。在终端中运行时可能会出现CUDA错误,表示显存不足,导致提供的端口失效。若使用HuggingFace,需要申请APIKey并且需要本地有Pyth...

大型语言模型(LargeLanguageModels,LLM)是指基于神经网络模型的自然语言处理技术,它可以通过大规模的训练数据和计算资源来预测自然语言文本的下一个词或句子。近年来,由于技术的不断进步和计算资源的...

本文主要介绍主流代码生成模型,总结了基于代码生成的开源大语言模型,按照时间顺序排列。_llmextractum...

作为一名经验充足的AI全栈工程师,2024年我计划把我的经验总结出一套知识库免费分享给大家,感兴趣的小伙伴可以关注我一起学习。_ai开发技术栈...

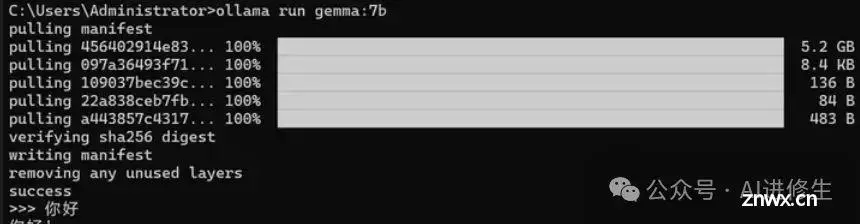

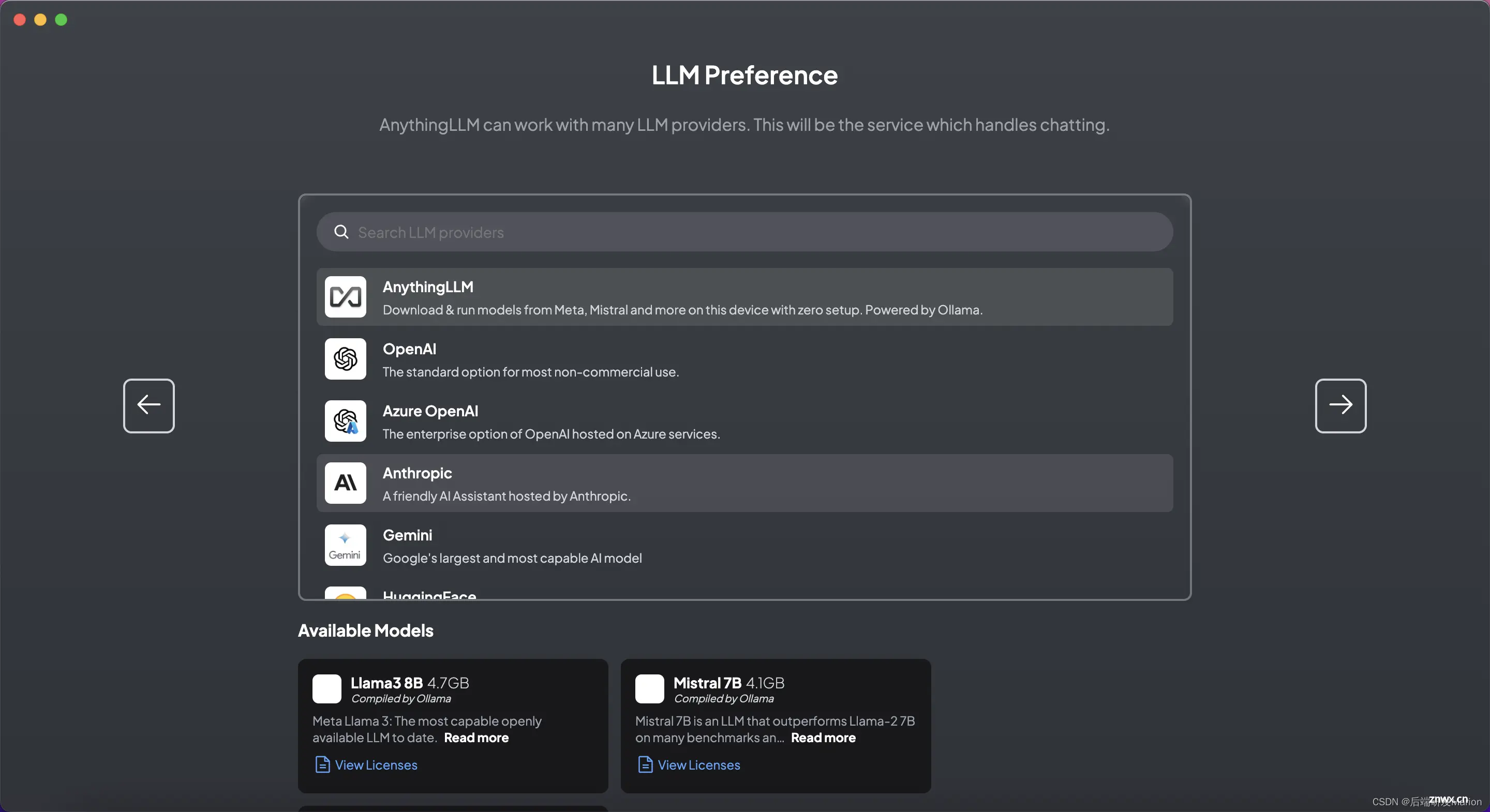

本文介绍了LLM在落地应用中的不足,并引入了RAG框架和原理,以及RAG在私有知识库建设中的重要作用。并以Ollama和AnythingLLM为实现手段,构建了并测试了本地知识库,测试结果表明,有了RAG的加持,...

在实战开发大语言模型的过程中,经常会遇到各种API-KEY的配置问题,例如GPTOpenAIKEY的配置,而且目前大部分都要求将其配置在环境变量中,下面将会讲解如何在Linux、macOS、Windows中配置...

如果需要,可以使用AnythingLLM的开发者API进行自定义集成,以满足特定的业务需求。_open-webui自定义知识库...