在目前AI的世界里,各大模型都还是跟着OpenAI在跑,API也尽量跟OpenAI保持一致。所以这里大致会有三个场景:OpenAI,其余模型自身的封装-这里选择qwen-agent,以及通用封装框架-这里选择La...

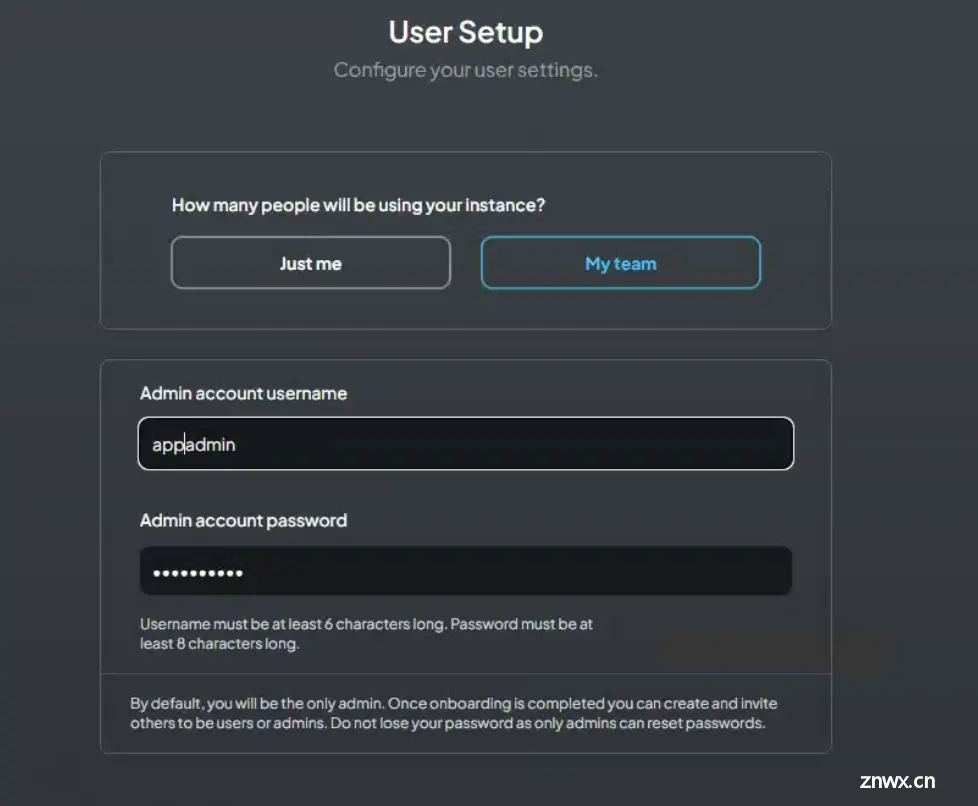

整个过程需要准备三个工具:Ollama:用于运行本地大模型的管理:llama3,qwen2等Docker:用于运行AnythingLLM。AnythingLLM:知识库运行平台,提供知识库构建及运行的功能。_ol...

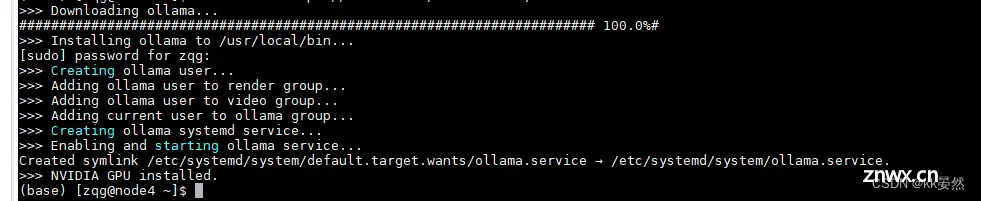

Ollama是一个专注于简化大规模机器学习模型开发的框架。它提供了一系列工具来帮助开发者轻松地定义、训练和部署大型语言模型。优点:•提供了简洁的API,易于上手。•支持多种硬件加速选项,如GPU和...

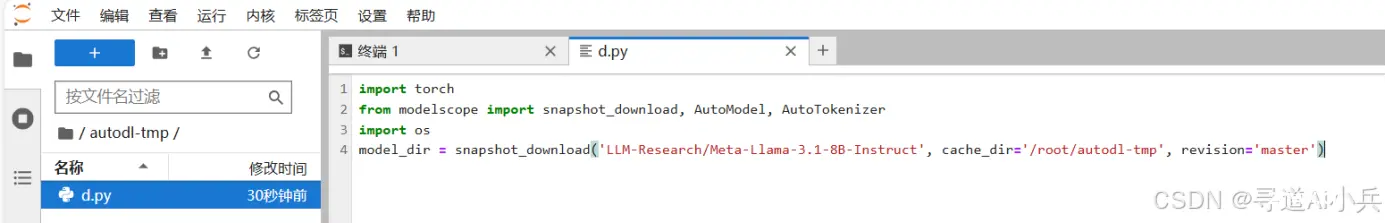

在人工智能的浪潮中,大型语言模型(LLMs)已成为推动技术进步的关键力量。随着Meta公司最新开源的Llama3.1模型的问世,我们见证了开源AI领域的一大飞跃。Llama3.1以其卓越的性能和广泛的应用...

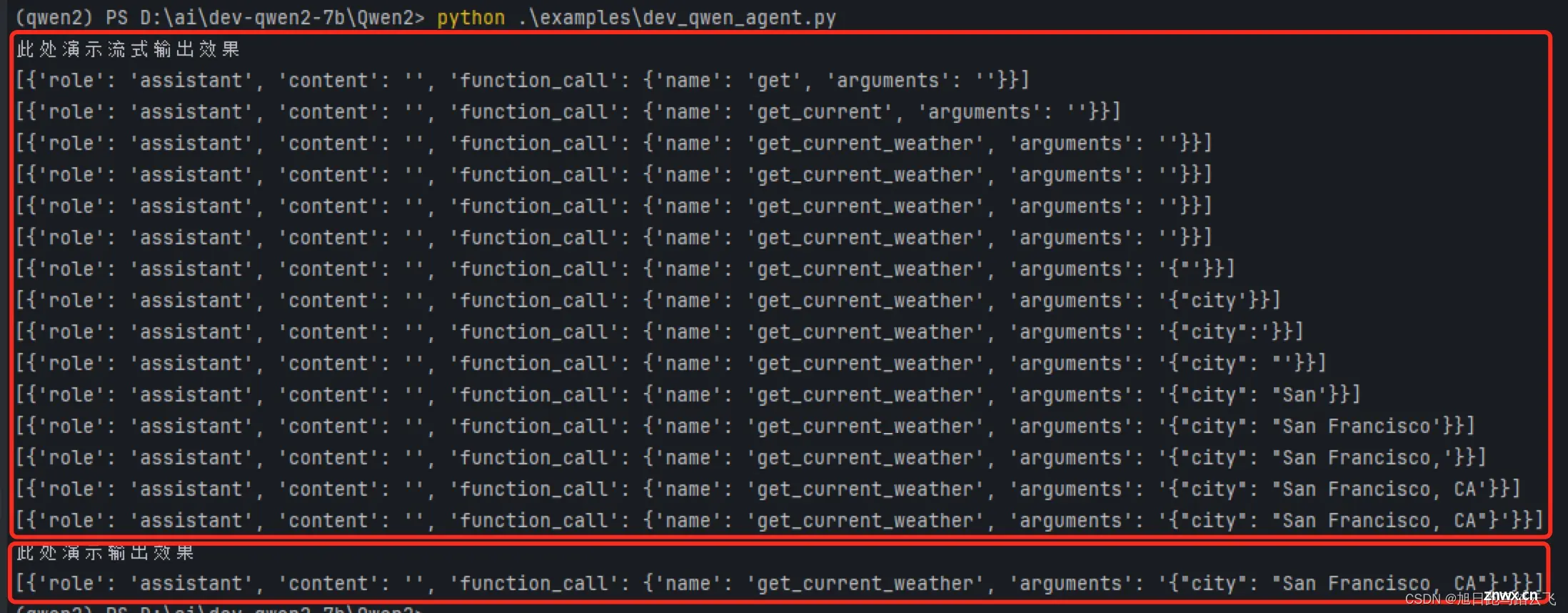

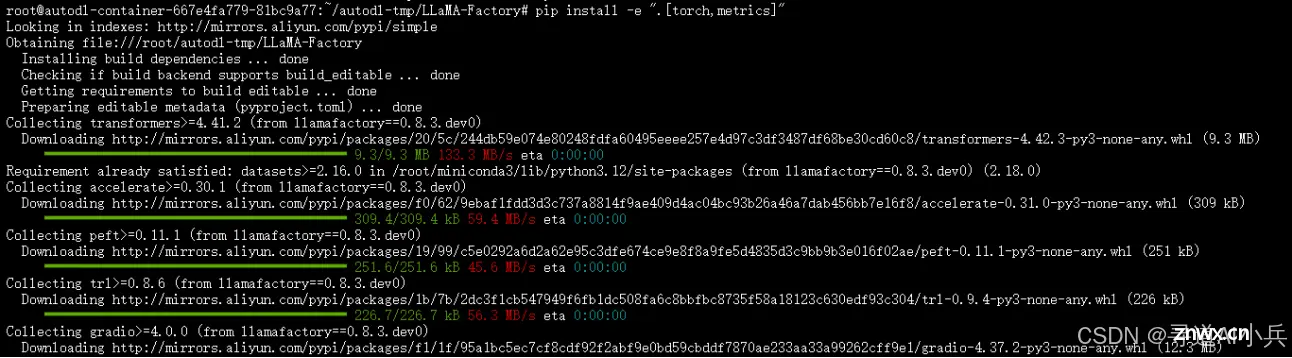

在人工智能的浪潮中,大型语言模型(LLMs)正逐渐成为研究和应用的热点。它们在自然语言处理(NLP)的各个领域,如文本生成、翻译、问答等任务中展现出了卓越的能力。Qwen2-7B模型,作为该领域的佼佼者,不仅...

可以看到,系统正在下载qwen的模型(并保存在C盘,C:\\Users.ollama\\models如果想更改默认路径,可以通过设置OLLAMA_MODELS进行修改,然后重启终端,重启ollama服务。本篇文章...

windows上安装部署Ollama3+openwebui_openwebui安装...

通过Ollama,您可以在本地运行各种大型语言模型(LLM),并从中生成文本。SpringAI通过OllamaChatModel支持Ollama文本生成。_ollamachatmodel...

Llama3.1的发布不仅是Meta在AI领域的一次重大突破,也为整个AI社区带来了新的机遇和挑战。其强大的性能、开放的生态和先进的技术,无疑将推动AI技术的进一步发展和应用。_lama3.1...

本地使用Ollama+OpenWebUI部署大模型_openwebui完全离线部署...