【C语言篇】数据在内存中的存储(超详细)

Trouvaille ~ 2024-08-03 11:35:01 阅读 53

文章目录

数据在内存中的存储二进制和进制转换基本概念进制转换十进制转二进制二进制转八进制和十六进制

整数在内存中的存储反码原码补码大小端字节序和字节序判断什么是大小端?为什么有大小端

浮点数在内存中的存储题目提出浮点数存的过程浮点数取的过程

题目解析

数据在内存中的存储

二进制和进制转换

其实我们经常能听到 2进制、8进制、10进制、16进制 这样的讲法,那是什么意思呢? 其实2进制、8进制、10进制、16进制是数值的不同表⽰形式⽽已。

二进制:Binary,简写为B。八进制:Octal,简写为O。十进制:Decimal,简写为D。十六进制:Hexadecimal,简写为H

⽐如:数值15的各种进制的表⽰形式:

<code>15的2进制:1111

15的8进制:17

15的10进制:15

15的16进制:F

在计算机中:

16进制的数值之前写:0x

8进制的数值之前写:0

我们重点介绍⼀下⼆进制:

⾸先我们还是得从10进制讲起,其实10进制是我们⽣活中经常使⽤的

10进制中满10进1

10进制的数字每⼀位都是0~9的数字组成

其实⼆进制也是⼀样的

2进制中满2进12进制的数字每⼀位都是0~1的数字组成

基本概念

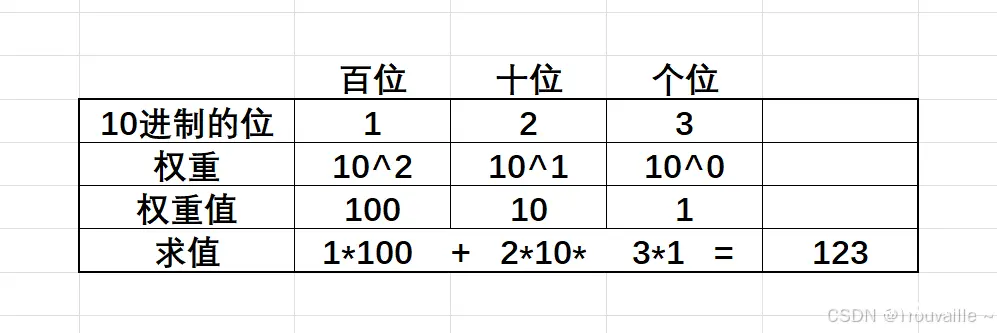

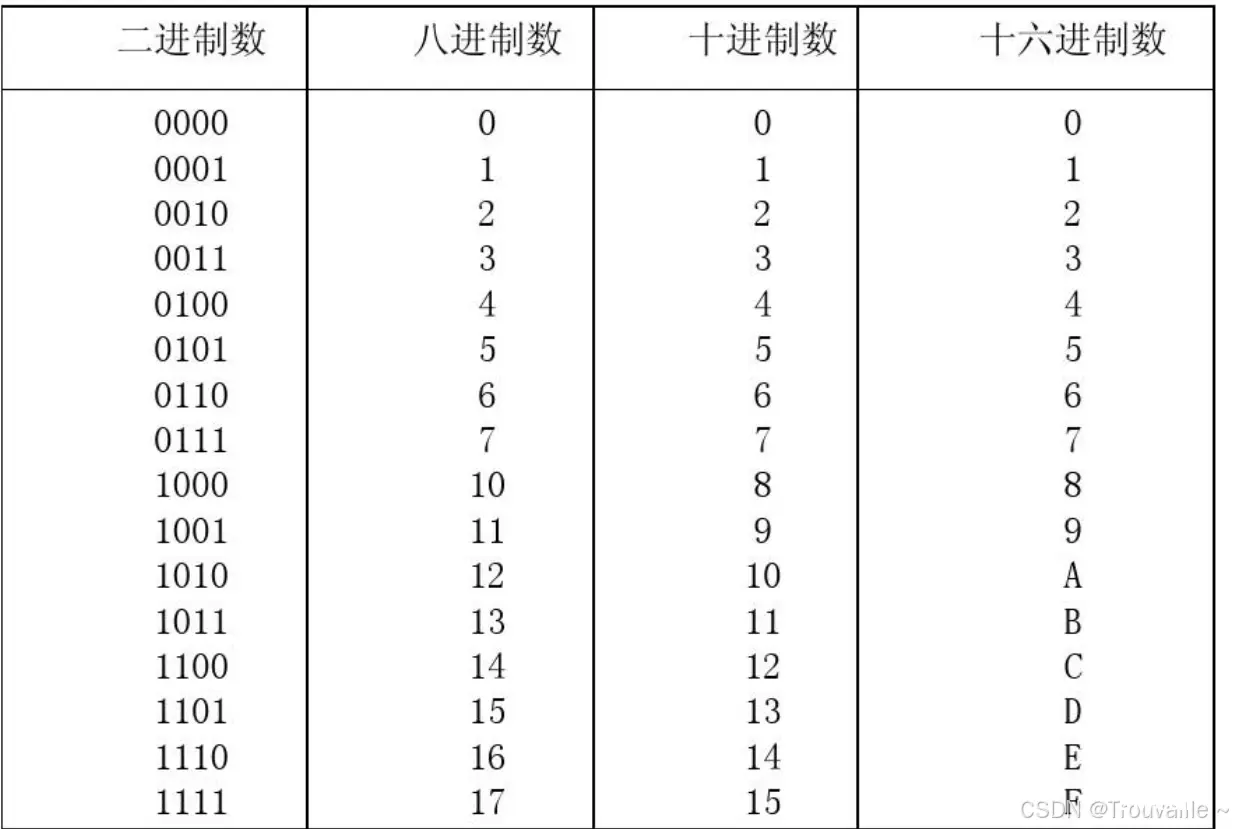

进制包括数位、基数和位权三个要素。

数位:指数字符号在一个数中所处的位置。基数:指在某种进位计数制中数位上所能使用的数字符号的个数。位权(权重):数制中某一位上的1所表示数值的大小(所处位置的价值)。

例子如下:

通过这我们可以发现,要把一个其他进制数转换为10进制只需要对应位置乘以它的权重再相加即可,这是为什么呢?

这是因为所有进制位权重,比如21,162,84,这些都是十进制数,也就是我们在转换过程中使用的都是十进制作为位权来进行的,所以最后转换出来的一定是十进制数

进制转换

十进制转二进制

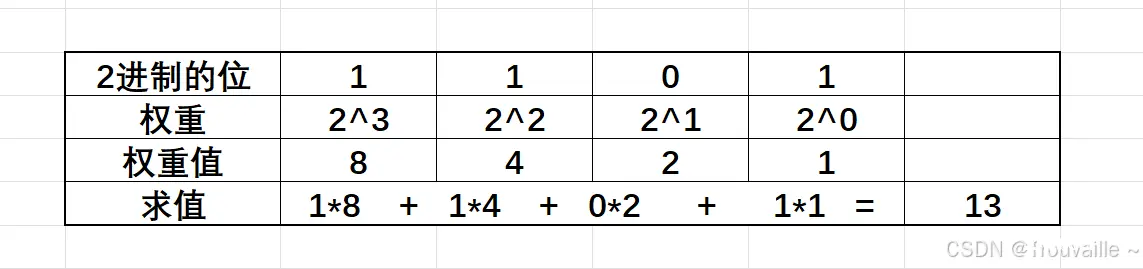

整数部分:除二向上取余法

小数部分:乘二向下取余法

在计算机中我们关注更多的是整数部分的转换

二进制转八进制和十六进制

二进制转八进制

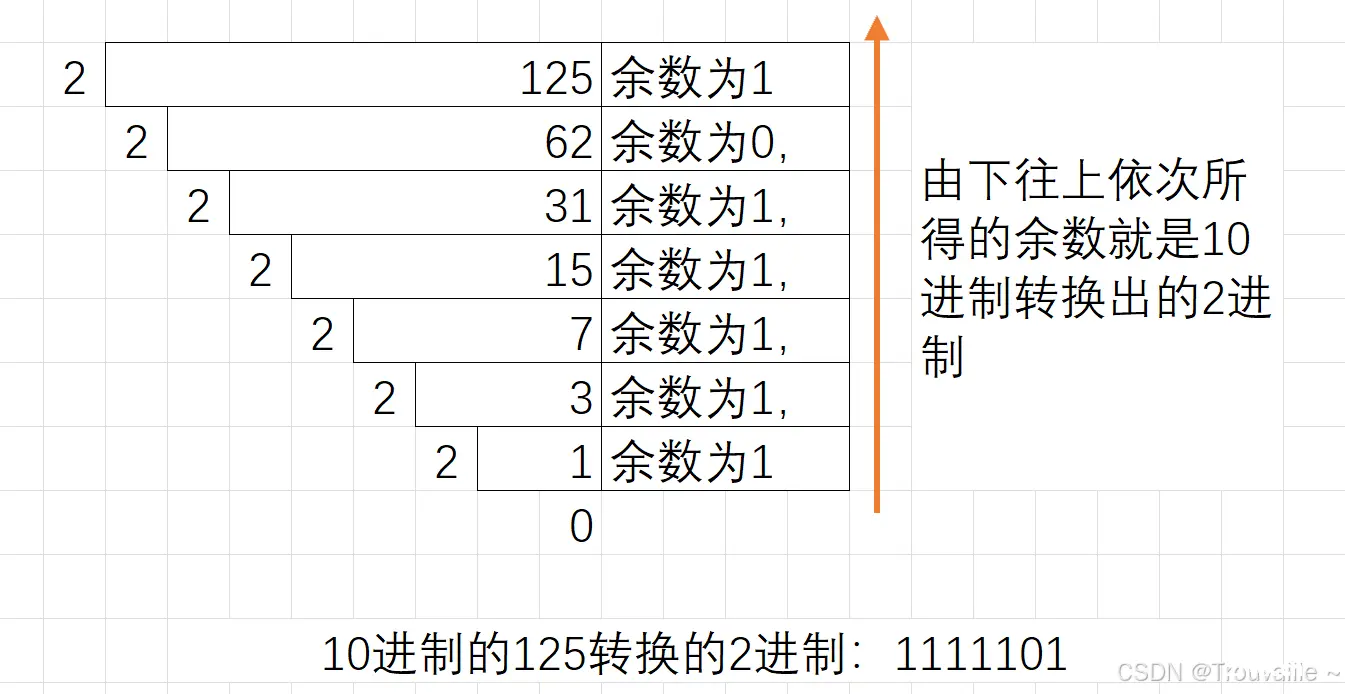

8进制的数字每⼀位是0~7的数字,各⾃写成2进制,最多有3个2进制位就⾜够了,⽐如7的⼆ 进制是111。

所以在2进制转8进制数的时候,从2进制序列中小数点向左向右每3个2进制位会换算⼀ 个8进制位,剩余不够3个2进制位的补0直接换算。

如:

1011010.100101=001 011 010.100 101=132.45(8)

二进制转十六进制

16进制的数字每⼀位是0~ 9,a~f的数字,各⾃写成2进制,最多有4个2进制位就⾜够了, ⽐如f的⼆进制是1111

所以在2进制转16进制数的时候,从2进制序列中小数点向左向右每4个2进制位会换算⼀个16进制位,剩余不够4个⼆进制位的直接补0换算。

如:

1011010.100101=0101 1010.1001 0100=5A.94(16)

记忆表

整数在内存中的存储

讲了这么多进制,在计算机中我们采用的主要都是二进制,这也是计算机内部电子元件所决定的,主要原因是逻辑电路只有两个状态:接通和断开,用1和0表示技术实现简单,其他例如运算规则简单、适合逻辑运算、易于进行转换以及抗干扰能力强等等也是重要原因。

在计算机中,最小的存储单位是"bit",即比特位,就是一个二进制位,并且我们把八位bit位称作"Byte",即字节。

反码原码补码

整数的2进制表⽰⽅法有三种,即原码、反码和补码

有符号整数的三种表⽰⽅法均有符号位和数值位两部分,2进制序列中,最⾼位的1位是被当做符号位,剩余的都是数值位。 符号位都是⽤0表⽰“正”,⽤1表⽰“负”。

正整数的原、反、补码都相同。 负整数的三种表⽰⽅法各不相同。

正数:原码反码补码都相同

例如:3的原反补码都是00000011

负数,规则如下

原码:直接将数值按照正负数的形式翻译成⼆进制得到的就是原码。

反码:将原码的符号位不变,其他位依次按位取反就可以得到反码。

补码:反码+1就得到补码。

例如:-3的原反补码依次为:

10000011 11111100 11111101

0 分为+0和-0

+0 都是00000000

-0 10000000 11111111 00000000

在计算机中,数据存储的都是补码

原理还是来源于生活,比如当我们在生活中计算十进制两位数之内的减法时,13-5和13+95,当我们都取最低两位数时,结果都是8,如果是在三位数的范围内130-50和130+950,当我们取最低三位数时结果也是一样的,我们把这个基数位数(例如前者是102,后者是103)称作模,通过模加上负数得到的一定是正数,通过这样我们就只需要完成加法就可以了

在二进制中也是一样,观察上面的-3,模就是28,而它的补码就是无符号位整数256-3,即253

原理大概了解一下就行了,考试的话还是要会原反补码的公式转换

但是要注意一点,8位的二进制数表示的最大范围是[-128~127],我们会发现-128是没有原码和反码的,这就要用到本质原理来解释,-128的补码就是无符号整数-128+256,即128,在计算机中就是10000000

可以发现当我们写出[-127~+127]的补码时,只有10000000这个序列没有表示任何数字,通过这样的规则我们让其表示-128,让计算机的空间资源利用最大化

总结:

在计算机系统中,数值⼀律⽤补码来表⽰和存储。 原因在于,使⽤补码,可以将符号位和数值域统⼀处理; 同时,加法和减法也可以统⼀处理(CPU只有加法器)此外,补码与原码相互转换,其运算过程是相同的,不需要额外的硬件电路。

大小端字节序和字节序判断

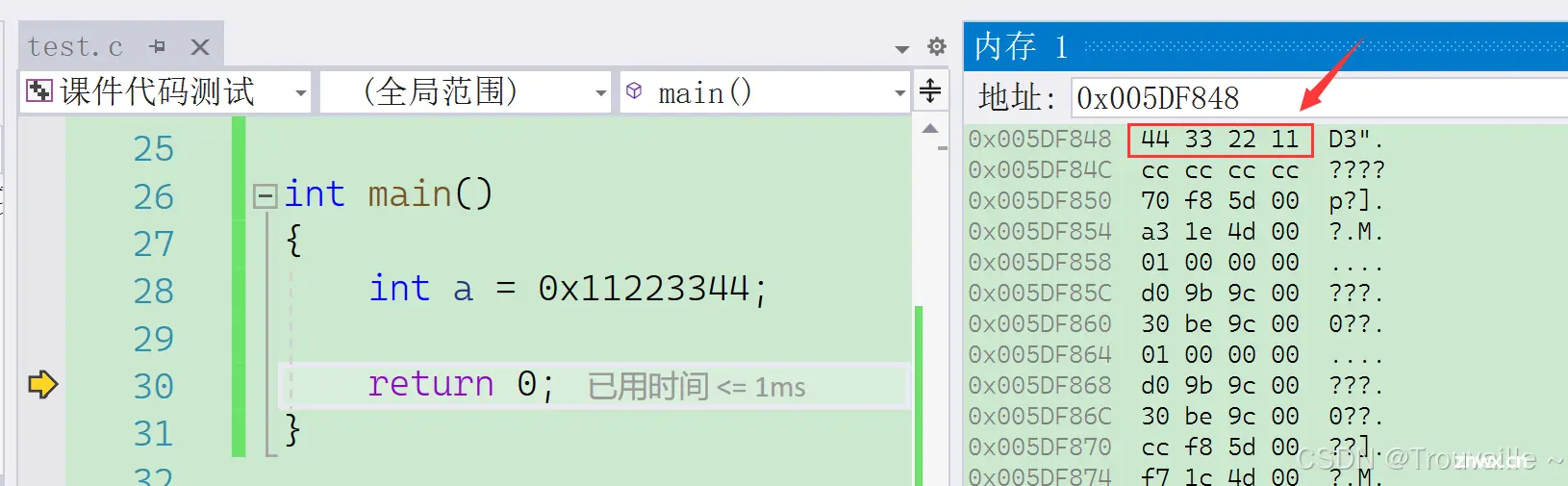

当我们了解了整数在内存中存储后,我们调试看⼀个细节:

<code>#include <stdio.h>

int main()

{

int a = 0x11223344;//16进制数

return 0;

}

调试的时候,我们可以看到在a中的 0x11223344 这个数字是按照字节为单位,倒着存储的。这是为什么呢?

什么是大小端?

其实超过⼀个字节的数据在内存中存储的时候,就有存储顺序的问题,按照不同的存储顺序,我们分为⼤端字节序存储和⼩端字节序存储,下⾯是具体的概念:

⼤端(存储)模式: 是指数据的低位字节内容保存在内存的⾼地址处,⽽数据的⾼位字节内容,保存在内存的低地址处。⼩端(存储)模式: 是指数据的低位字节内容保存在内存的低地址处,⽽数据的⾼位字节内容,保存在内存的⾼地址处。 上述概念需要记住,⽅便分辨⼤⼩端。

为什么有大小端

为什么会有⼤⼩端模式之分呢?

这是因为在计算机系统中,我们是以字节为单位的,每个地址单元都对应着⼀个字节,⼀个字节为8bit位,但是在C语⾔中除了8bit的 char 之外,还有16bit的 short 型,32bit的 long 型(要看具体的编译器),

另外,对于位数⼤于8位的处理器,例如16位或者32位的处理器,由于寄存器宽度⼤于⼀个字节,那么必然存在着⼀个如何将多个字节安排的问题。因此就导致了⼤端存储模式和⼩端存储模式。

例如:⼀个 16bit 的 short 型 x ,在内存中的地址为 0x0010 , x 的值为 0x1122 ,那么 0x11 为⾼字节, 0x22 为低字节。

对于⼤端模式,就将 0x11 放在低地址中,即 0x0010 中, 0x22 放在⾼地址中,即 0x0011 中。而⼩端模式,刚好相反。

我们常⽤的 X86 结构是⼩端模式,⽽ KEIL C51 则为⼤端模式。很多的ARM,DSP都为⼩端模式。有些ARM处理器还可以由硬件来选择是⼤端模式还是⼩端模式。

其实就是当整数表示的范围超过了一个字节所能表示的最大范围后(无符号整数255,有符号整数127),就必然存在如何安排这个整数不同字节的存储顺序的问题

浮点数在内存中的存储

常⻅的浮点数:3.14159、1E10等,浮点数家族包括: float、double、long double 类型。 浮点数表⽰的范围: float.h 中定义

题目提出

<code>#include <stdio.h>

int main()

{

int n = 9;

float *pFloat = (float *)&n;

printf("n的值为:%d\n",n);

printf("*pFloat的值为:%f\n",*pFloat);

*pFloat = 9.0;

printf("num的值为:%d\n",n);

printf("*pFloat的值为:%f\n",*pFloat);

return 0;

}

上⾯的代码中, num 和*pFloat 在内存中明明是同⼀个数,为什么浮点数和整数的解读结果会差别这么大呢?

要理解这个结果,⼀定要搞懂浮点数在计算机内部的表⽰⽅法。 根据国际标准IEEE(电⽓和电⼦⼯程协会)754,任意⼀个⼆进制浮点数V可以表⽰成下⾯的形式:

V = (−1)S * M * 2E

(−1) 表⽰符号位,当S=0,V为正数;当S=1,V为负数 SM表⽰有效数字,M是⼤于等于1,⼩于2的2E 表⽰指数位

举例来说: ⼗进制的5.0,写成⼆进制是 101.0 ,相当于 1.01×22 。

那么,按照上⾯V的格式,可以得出S=0,M=1.01,E=2。

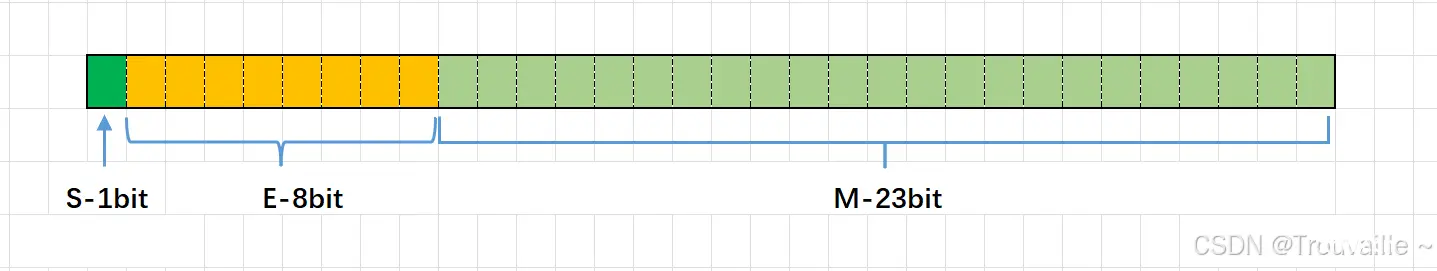

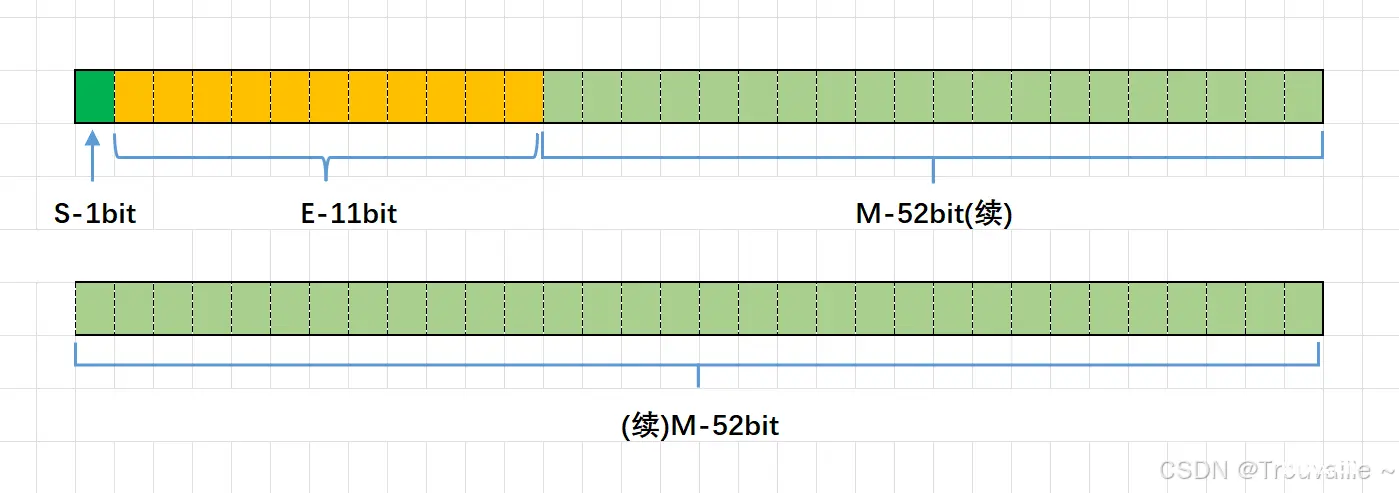

IEEE754规定: 对于32位的浮点数,最⾼的1位存储符号位S,接着的8位存储指数E,剩下的23位存储有效数字M

对于64位的浮点数,最⾼的1位存储符号位S,接着的11位存储指数E,剩下的52位存储有效数字M

浮点数存的过程

IEEE754对有效数字M和指数E,还有⼀些特别规定。

对于有效数字M

前⾯说过, 1≤M<2 ,也就是说,M可以写成 1.xxxxxx 的形式,其中 xxxxxx 表⽰⼩数部分。 IEEE754规定,在计算机内部保存M时,默认这个数的第⼀位总是1,因此可以被舍去,只保存后⾯的 xxxxxx部分。⽐如保存1.01的时候,只保存01,等到读取的时候,再把第⼀位的1加上去。这样做的⽬的,是节省1位有效数字。以32位浮点数为例,留给M只有23位,将第⼀位的1舍去以后,等于可以保存24位有效数字

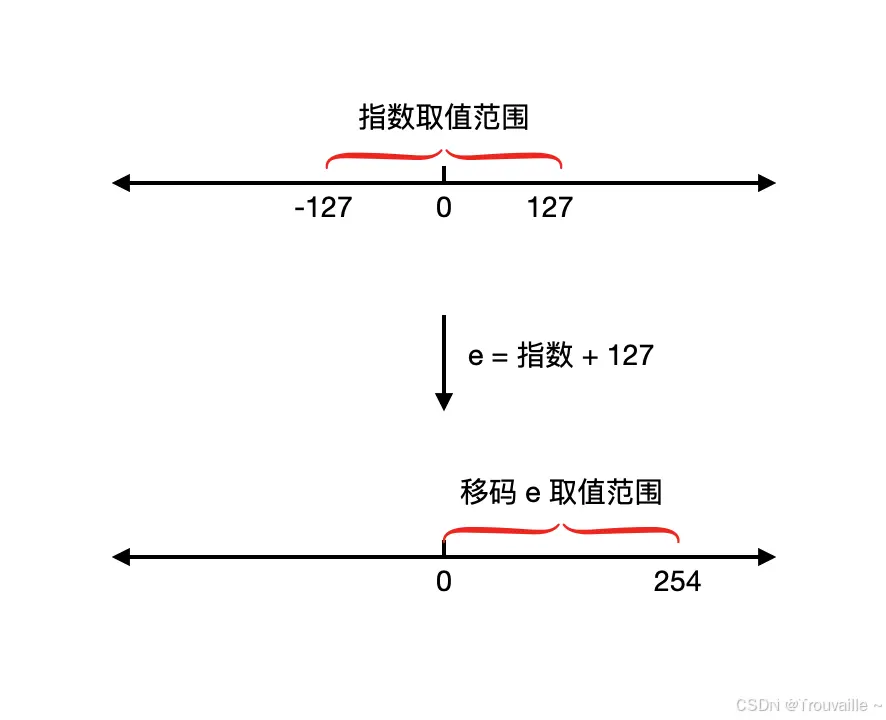

⾄于指数E,情况就⽐较复杂 ⾸先,E为⼀个⽆符号整数(unsignedint)

这意味着,如果E为8位,它的取值范围为0~ 255;如果E为11位,它的取值范围为0~2047。

但是,我们知道,科学计数法中的E是可以出现负数的,而如果出现负数,那首先我们要检查符号位,要看符号是不是一样的,如果不一样的话,正数要比负数大。而符号位同正呢?同负呢?同正的话是不是就是绝对值大的数比较大?同负的话是不是绝对值小的数比较大?那就得实现两套比较逻辑,对应两种不同的情况。

首先要把符号关系搞清楚(<code>++,+-,-+,--),然后,再按符号关系执行多套不同的逻辑,这样实现起来 CPU 电路会很复杂。

所以当时设计 IEEE 754 的专家为了保持简洁,就干脆不要符号位了,直接规定我们把指数加上 127 再存储。加上 127 就把指数的取值范围 “移” 到正数上来了。

IEEE 754规定,存⼊内存时E的真实值必须再加上⼀个中间数,对于8位的E,这个中间数是127;对于11位的E,这个中间数是1023。⽐如,210的E是 10,所以保存成32位浮点数时,必须保存成10+127=137,即10001001。

这个“中间值”叫做移码。

浮点数取的过程

E不全为0或不全为1

这是大多数情况

这时,浮点数就采⽤下⾯的规则表⽰,即指数E的真实值加上127(或1023),再将有效数字M去掉整数部分的1。

⽐如:0.5的⼆进制形式为0.1,由于规定正数部分必须为1,即将⼩数点右移1位,则为1.0*2(-1),其阶码为-1+127(中间值)=126,表⽰为01111110,⽽尾数1.0去掉整数部分为0,补⻬0到23位00000000000000000000000,则其⼆进制表⽰形式为:

<code>0 01111110 00000000000000000000000

E全为0

这时,规定浮点数的指数E等于1-127(或者1-1023)即为真实值,有效数字M不再加上第⼀位的1,⽽是还原为0.xxxxxx的⼩数。这样做是为了表⽰±0,以及接近于0的很⼩的数字。

0 00000000 00100000000000000000000

E全为1

这时,如果有效数字M全为0,表⽰±⽆穷⼤(正负取决于符号位s);

0 11111111 00010000000000000000000

题目解析

下⾯,让我们回到⼀开始的题目

先看第1环节,为什么9还原成浮点数,就成了 0.000000?

9以整型的形式存储在内存中,得到如下⼆进制序列:

0000 0000 0000 0000 0000 0000 0000 1001

⾸先,将 9 的⼆进制序列按照浮点数的形式拆分,得到第⼀位符号位s=0,后⾯8位的指数 E=00000000

最后23位的有效数字M=00000000000000000001001

由于指数E全为0,所以符合E为全0的情况因此,浮点数V就写成:

V=(-1)0 × 0.00000000000000000001001×2(-126)=1.001×2(-126)

显然,V是⼀个很⼩的接近于0的正数,所以⽤⼗进制⼩数表⽰就是0.000000。

再看第2环节,浮点数9.0,为什么整数打印是 1091567616

⾸先,浮点数9.0等于⼆进制的1001.0,即换算成科学计数法是:1.001×23

所以:9.0 = (−1)0 * (1.001) * 23

那么,第⼀位的符号位S=0,

有效数字M等于001后⾯再加20个0,凑满23位,

指数E等于3+127=130, 即10000010 所以,写成⼆进制形式,应该是S+E+M,即:

0 10000010 001 0000 0000 0000 0000 0000

这个32位的⼆进制数,被当做整数来解析的时候,就是整数在内存中的补码,原码正是1091567616 。

以上就是数据在内存中存储的介绍啦,各位大佬有什么问题欢迎在评论区指正,您的支持是我创作的最大动力!❤️

声明

本文内容仅代表作者观点,或转载于其他网站,本站不以此文作为商业用途

如有涉及侵权,请联系本站进行删除

转载本站原创文章,请注明来源及作者。