一文教你在windows上实现ollama+open webui、外网访问本地模型、ollama使用GPU加速

-蜗牛与梦- 2024-06-10 16:33:23 阅读 73

前言:

ollama工具的出现让大语言模型的部署变得格外的轻松,但是在windows系统部署之后发现无法使用GPU进行加速,通过多方面查找资料发现可以在docker中使用命令启用GPU加速。另外通过Docker也可以快速部署open webui,于是本文基于docker实现ollama模型的部署,以及webui部署。

最终部署成功后可以实现公网访问本地大语言模型功能。

目录:

安装docker

在docker中安装ollama

在docker中安装webui

内网穿透实现公网访问本地大语言模型

环境:

系统:windows10

CPU:i5-9400

GPU:GTX1050ti

内容

安装docker

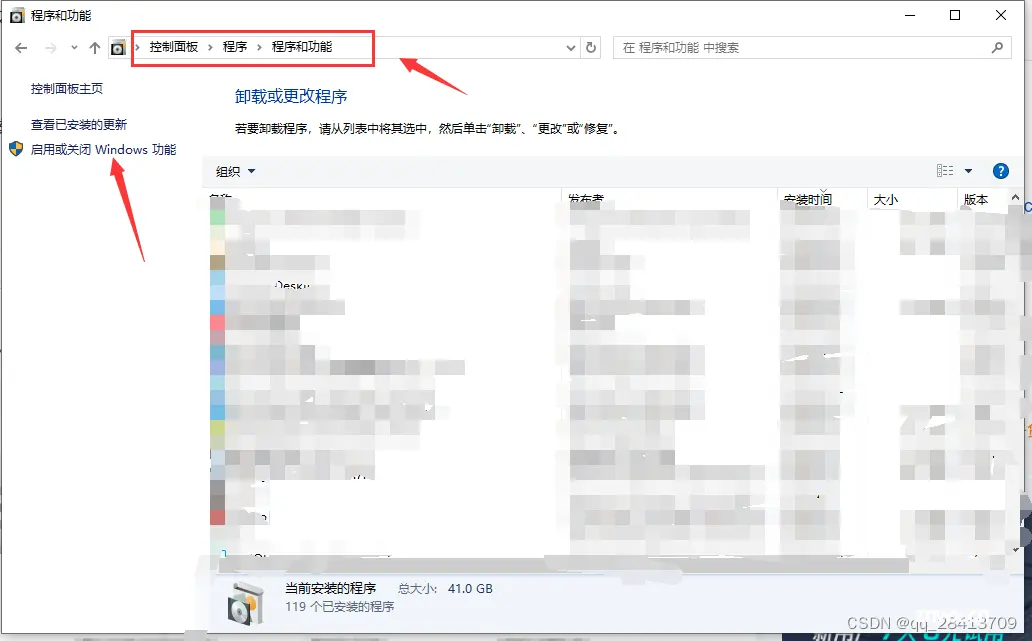

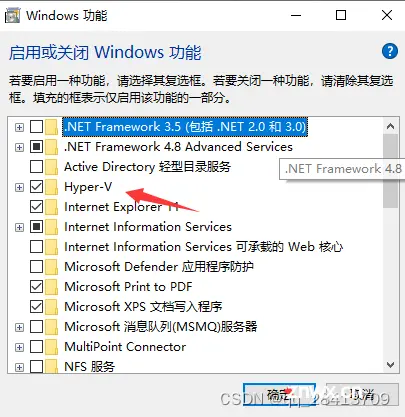

第一步:启动Hyper-v

如果之前没有安装过docker,需要先进行设置一下。

依次打开 控制面板>程序>程序和功能>启用或关闭windows功能

勾选Hyper-V、虚拟机平台、Linux子系统并点击确认

确认后重启计算机

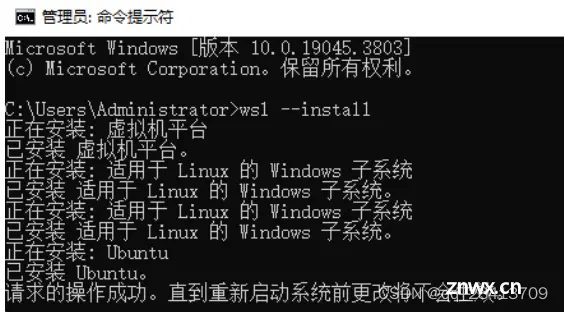

第二步:安装WSL

打开 powershell,以管理员的身份启动命令窗口

输入

wsl --update

wsl --install

安装成功后重启电脑

第三步:访问Docker官网进行下载

点击下载链接:https://docs.docker.com/desktop/install/windows-install/

下载完成后,双击安装程序进行安装,如果是第一次安装,安装后会提示重启电脑,重启后点击桌面的Docker Desktop图标:选择先不注册直接登录即可。

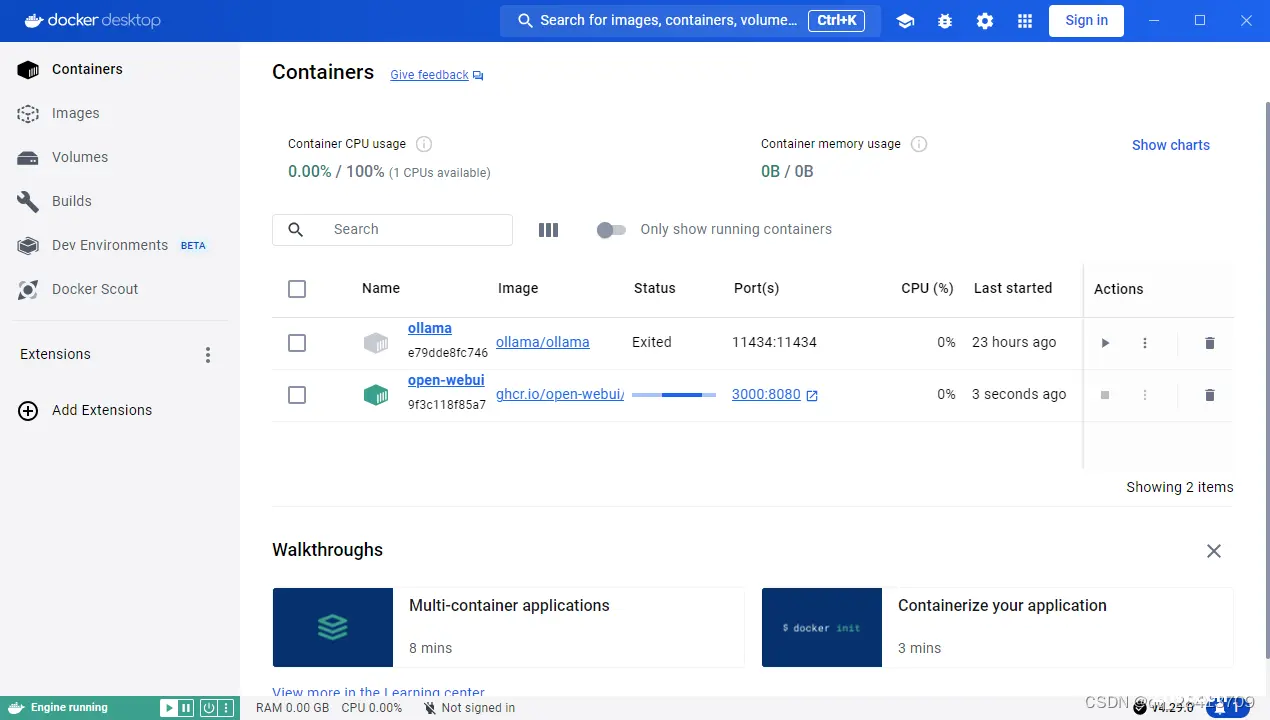

打开Docker Desktop后,左下角显示是绿色的running就代表我们成功了:

在docker中使用GPU运行ollama

第一步:安装英伟达容器安装包

打开之前安装的ubuntu

依次将一下命令输入ubuntu

配置apt源

curl -fsSL https://nvidia.github.io/libnvidia-container/gpgkey | sudo gpg --dearmor -o /usr/share/keyrings/nvidia-container-toolkit-keyring.gpg \ && curl -s -L https://nvidia.github.io/libnvidia-container/stable/deb/nvidia-container-toolkit.list | \ sed 's#deb https://#deb [signed-by=/usr/share/keyrings/nvidia-container-toolkit-keyring.gpg] https://#g' | \ sudo tee /etc/apt/sources.list.d/nvidia-container-toolkit.list

更新源

sudo apt-get update

安装工具包

sudo apt-get install -y nvidia-container-toolkit

第二步:使用GPU运行ollama

docker run --gpus all -d -v /opt/ai/ollama:/root/.ollama -p 11434:11434 --name ollama ollama/ollama

第三步:使用ollama下载模型

docker exec -it ollama ollama run qwen:7b

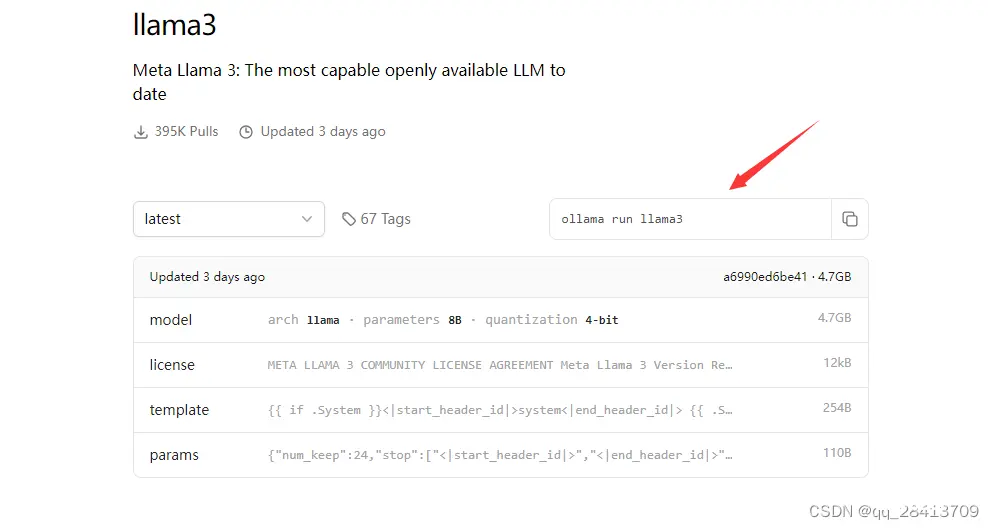

如果想要下载其他的模型,点击连接:library,选择并于同的模型

选择不同的模型复制下载命令

docker exec -it ollama ollama run llama3

在docker中安装webui

github开源地址:

https://github.com/open-webui/open-webui

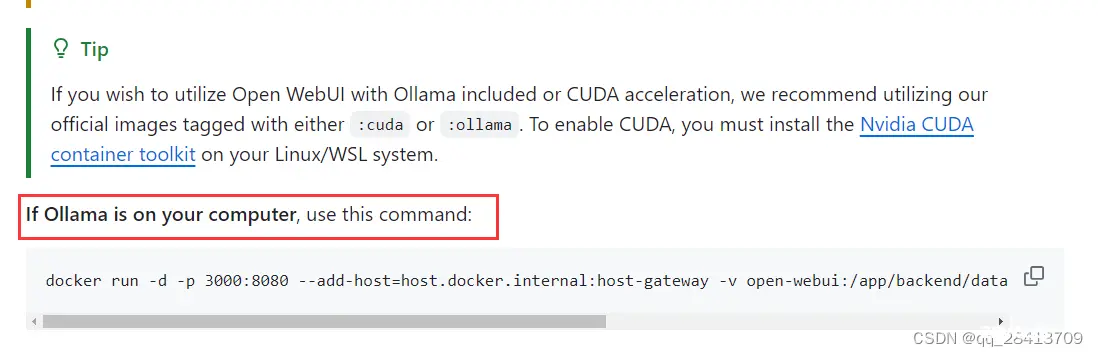

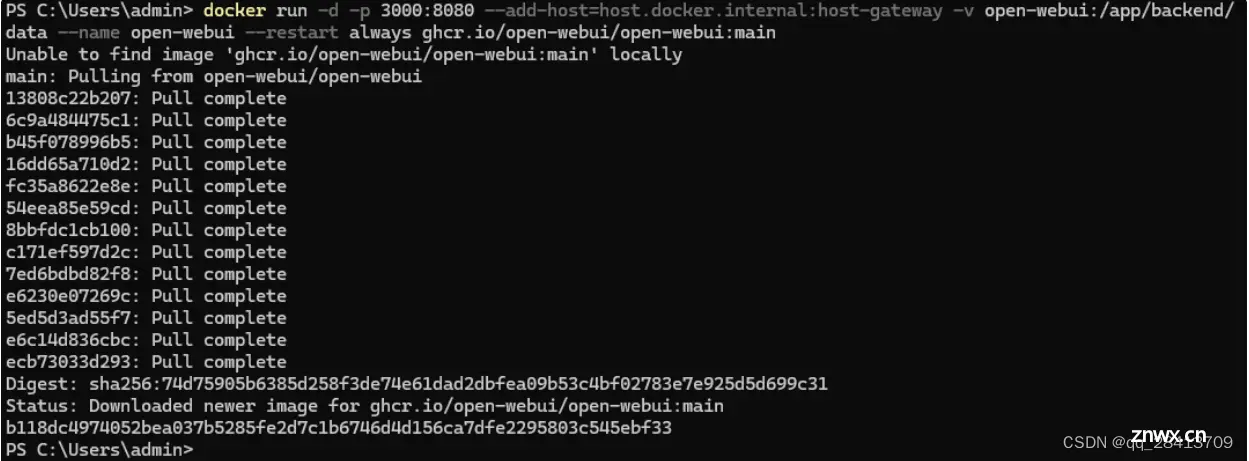

直接复制命令在windows powershell中运行

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main

等待安装完毕

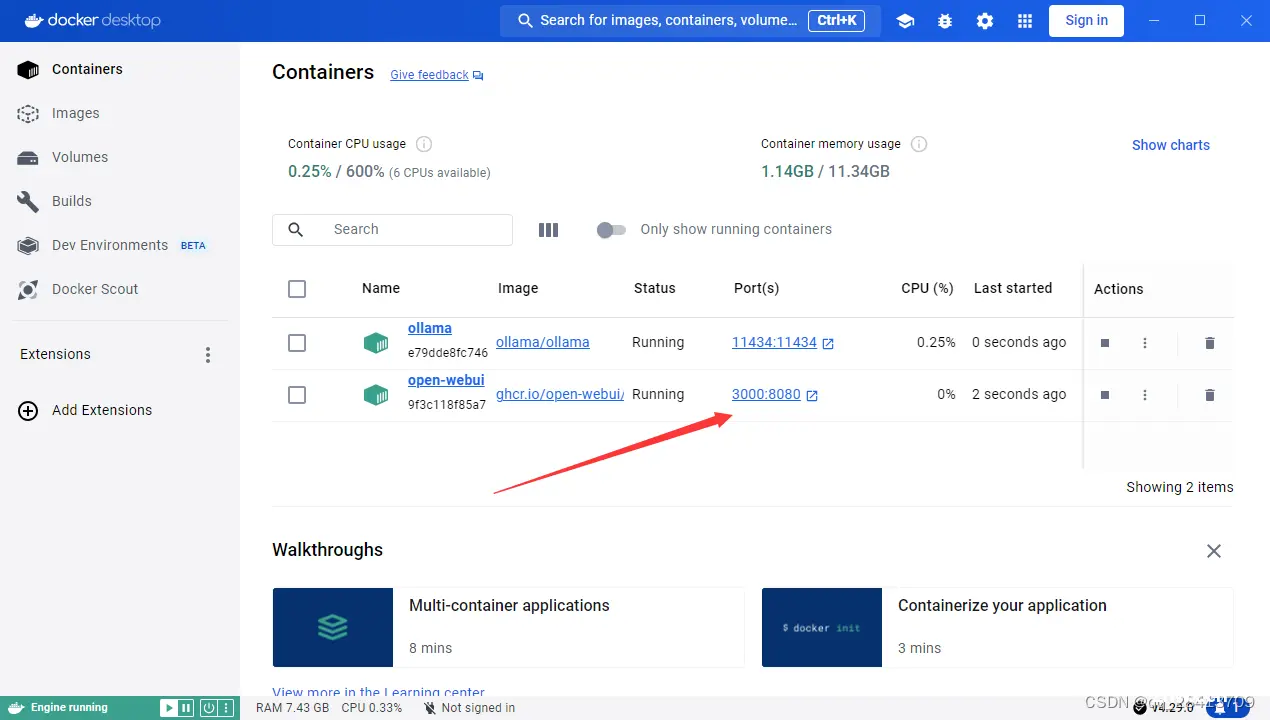

安装完毕后打开docker,点击地址

点击注册管理员账号

创建账户后登录

内网穿透实现公网访问本地大语言模型

第一步:下载cpolar

cpolar官网地址: https://www.cpolar.com

点击免费注册,注册一个账号

注册登录后下载cpolar

安装成功后在浏览器访问http://localhost:9200 ,使用已经注册好的账号登录

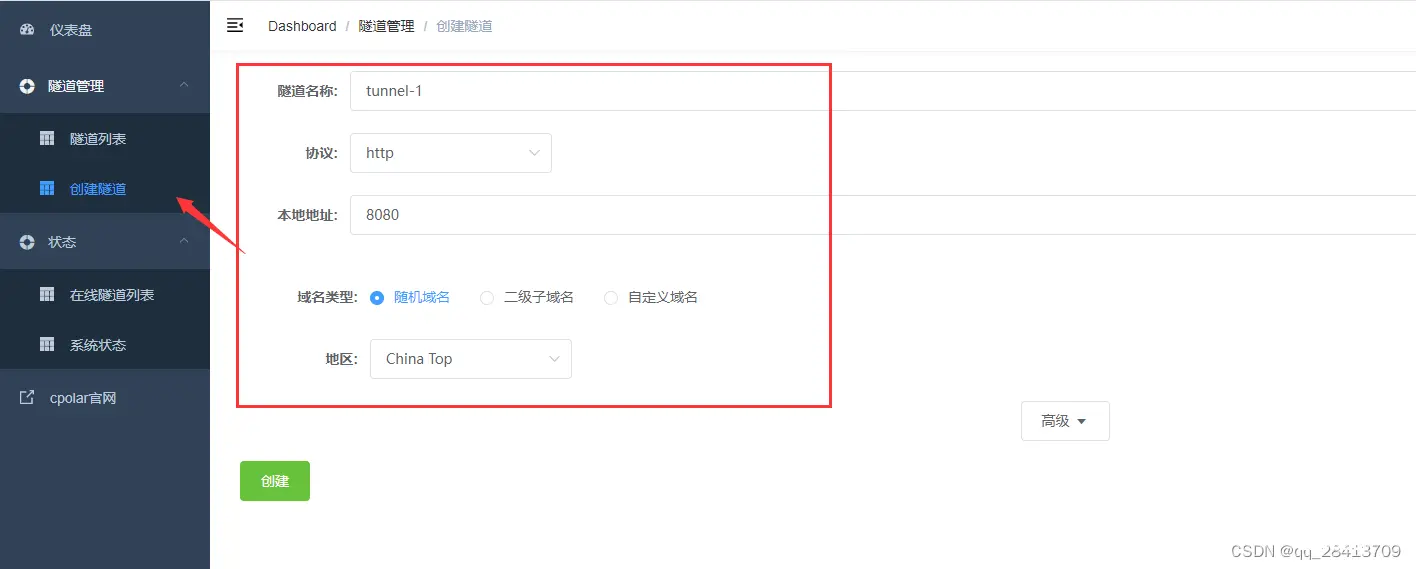

点击创建隧道,并配置

创建一个 ollama1 的公网http地址隧道:

隧道名称:ollama(可自定义命名,注意不要与已有的隧道名称重复)协议:选择http本地地址:3000 (本地访问的地址)域名类型:免费选择随机域名地区:选择China Top

创建好后可以选择在线隧道列表,复制公网网址即可实现公网访问本地模型

本文参考

Windows本地部署Ollama+qwen本地大语言模型Web交互界面并实现公网访问-腾讯云开发者社区-腾讯云https://github.com/1Panel-dev/MaxKB/wiki/%E5%A6%82%E4%BD%95%E8%AE%A9Ollama%E4%BD%BF%E7%94%A8GPU%E8%BF%90%E8%A1%8CLLM%E6%A8%A1%E5%9E%8B

Windows安装使用Docker,方便你的开发和部署(DockerDesktop篇)_windows安装docker-CSDN博客

下一篇: 前端遇到302处理方式以及设置第三方Cookie研究

本文标签

声明

本文内容仅代表作者观点,或转载于其他网站,本站不以此文作为商业用途

如有涉及侵权,请联系本站进行删除

转载本站原创文章,请注明来源及作者。