在个人 Linux 机器 (GPU/CPU) 上本地运行 LLaMA-3(Docker+Ollama+Open WebUI+LLama3教程含详细步骤)

CSDN 2024-07-14 16:37:01 阅读 86

在当今快速发展的人工智能环境中,部署开源大型语言模型 (LLM) 通常需要复杂的计算基础设施。然而,Ollama 的创新平台正在改变这一规范,支持在标准个人计算机上使用这些强大的模型,支持CPU和GPU配置。本指南介绍了如何使用 Ollama 在您自己的设备上设置和管理 LLM,重点介绍了允许广泛的参数模型在仅具有 CPU 的系统上高效运行的技术进步。

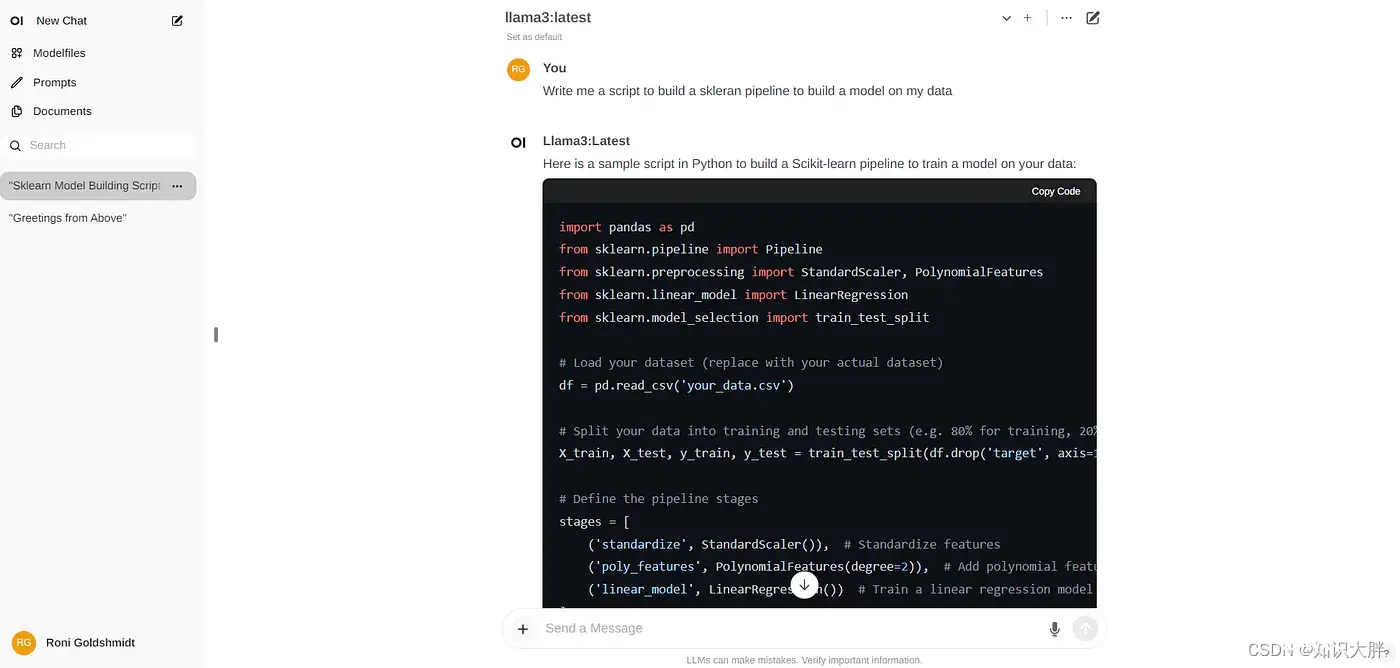

本指南提供了使用 Ollama 平台安装 LLM LLaMA-3 的分步说明。如果您希望使用 Ollama 库中的不同模型,只需相应地替换模型名称即可。您可以在此处访问完整的 Ollama 库。

此外,本指南详细介绍了Ollama的完整设置过程,包括在基础设施中部署 LLaMA- 3模型,以及如何使用 API 或Open WebUI UI与模型交互,并提供了安装步骤。此外,它还包括使用 GPU 和 CPU 设置之间的性能比较。

介绍

Ollama是一个强大的框架,专为大型语言模型的本地执行而设计。它提供了一种用户友好的方法来部署和管理人工智能模型,使用户能够直接从他们的机器运行各种预训练或自定义模型。 Ollama 的多功能性突出在于其全面的模型库,范围从较小的 80 亿参数模型到大量的 700 亿参数版本,可满足不同的计算和应用需求。

OLLAMA 优化的技术见解

Ollama 采用了一系列优化来确保跨不同硬件设置的高效模型性能:

硬件优化:利用 GPU 加速显着提高性能,在纯 CPU 配置上实现高达两倍的处理速度。

模型压缩:实施量化和稀疏微调等先进技术,以减少模型

声明

本文内容仅代表作者观点,或转载于其他网站,本站不以此文作为商业用途

如有涉及侵权,请联系本站进行删除

转载本站原创文章,请注明来源及作者。