Maxkb——无需代码,快速构建自己的AI助手

热爱编程的申同学 2024-08-18 12:01:04 阅读 90

目录

1、maxkb的介绍

2、maxkb的安装步骤

2.1、硬件需求

2.2、搭建Docker环境

2.3、安装maxkb(使用命令形式)

2.4、使用1Panel安装

2.5、访问MaxKB

3、创建AI应用

4、内嵌项目

随着ChatGPT在国内的爆火,越来越多的厂商开始投入AI大模型中去,几乎所有的网站都内嵌了一个AI对话窗口,电商、娱乐、社区。。。等等,可以看出,AI大模型已经是互联网发展的大趋势,那么,如何为自己的网站或者企业构建一个AI大模型呢?Maxkb就是一个开源免费的训练大模型工具,非常nice。

1、maxkb的介绍

它是飞致云开源免费的一款基于 LLM 大语言模型的开源知识库问答系统,旨在成为企业的最强大脑。

开箱即用

支持直接上传文档、自动爬取在线文档,支持文本自动拆分、向量化、RAG(检索增强生成),智能问答交互体验好;

无缝嵌入

支持零编码快速嵌入到第三方业务系统,让已有系统快速拥有智能问答能力,提高用户满意度;

灵活编排

内置强大的工作流引擎,支持编排 AI 工作流程,满足复杂业务场景下的需求;

模型中立

支持对接各种大语言模型,包括本地私有大模型(Llama 3 / Qwen 2 等)、国内公共大模型(通义千问 / 智谱 AI / 百度千帆 / Kimi / DeepSeek 等)和国外公共大模型(OpenAI / Azure OpenAI / Gemini 等)。

2、maxkb的安装步骤

介绍完maxkb后,废话不多说,直接开搞!

温情提示:本次为了方便我只演示在线安装的方式,如果有小伙伴的环境是内网,无法连接外网的话,可以到maxkb官网社区进行下载tar.gz包,进行离线安装。 详见 MaxKB 文档。

2.1、硬件需求

这里需要跟大家交代一下,maxkb是非常占用内存的,对硬件要求还是有点高的

操作系统:Ubuntu 22.04 / CentOS 7 64 位系统;

CPU/内存: 推荐 2C/4GB 以上;(亲测启动maxkb后,内存直接占用了1G多,所以内存推荐4G)

磁盘空间:100GB;

浏览器要求:请使用 Chrome、FireFox、Edge等现代浏览器;

可访问互联网。

2.2、搭建Docker环境

首先maxkb是要有docker环境的,如果没有docker的话,需要提前进行下载docker,如果你已经有docker环境了,直接跳过这部分。

直接复制下面命令,进行安装docker

<code>yum install -y yum-utils device-mapper-persistent-data lvm2

yum-config-manager --add-repo http://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

yum install docker-ce docker-ce-cli containerd.io -y

systemctl start docker

systemctl enable docker

安装完后,执行docker version命令

如果出现以上情况,证明docker已经安装成功了。

2.3、安装maxkb(使用命令形式)

ok!现在来进行安装maxkb,一行命令搞定!

<code>docker run -d --name=maxkb -p 8080:8080 -v ~/.maxkb:/var/lib/postgresql/data cr2.fit2cloud.com/1panel/maxkb

输入以上命令,等待安装完成。

2.4、使用1Panel安装(若采用2.3方式安装,则跳过这节)

如果有小伙伴看过我1Panel的那篇文章后,可以通过1Panel面板进行安装,不用再手动去执行安装命令了。

首先先去配置docker的镜像源,可以加速

镜像加速:国内访问 Docker Hub 有时会遇到困难,此时可以配置镜像加速器。

配置加速地址:

<code>https://docker.1panel.live

Bash

另外还推荐使用自己的镜像加速地址:

DaoCloud 加速器:https://<你的ID>.m.daocloud.io

阿里云加速器:https://<你的ID>.mirror.aliyuncs.com

配置完毕后一定要重启docker,默认1Panel会自动帮你重启。

2.5、访问MaxKB

输入你的服务器ip加你设置的端口号访问。

<code>http://目标服务器 IP 地址:目标端口

默认登录信息

用户名:admin

默认密码:MaxKB@123..

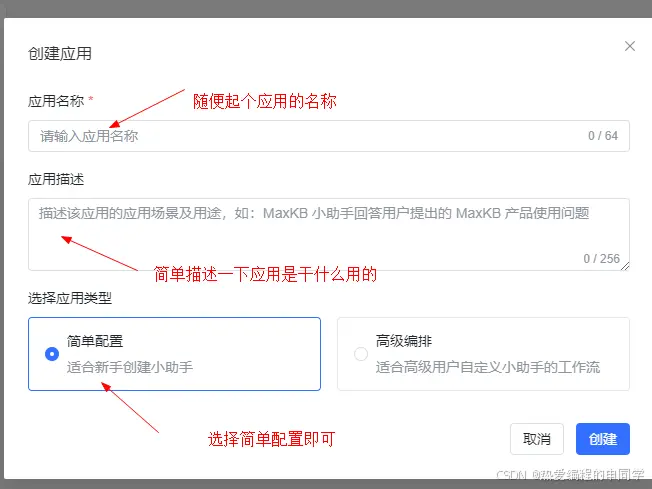

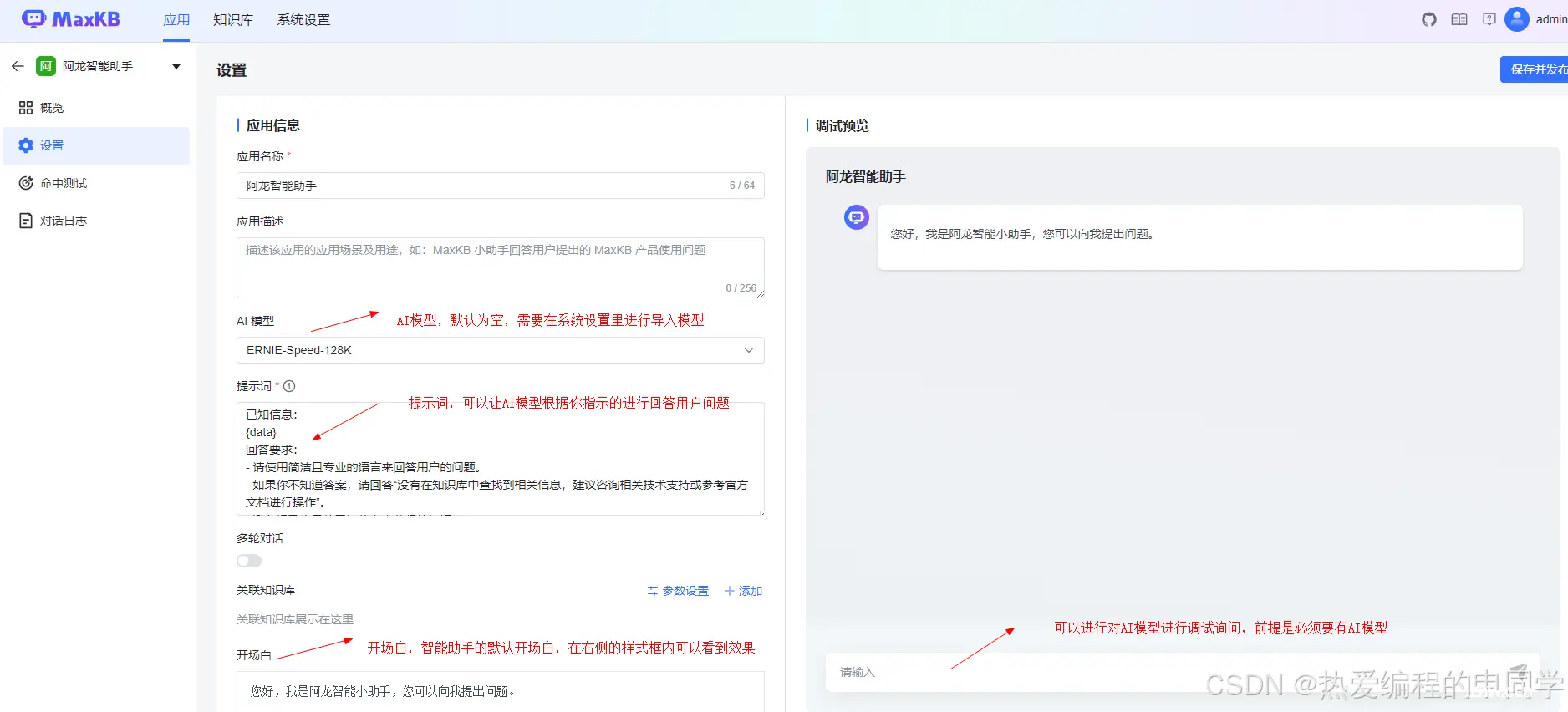

3、创建AI应用

这里阿龙插一嘴,如果你想自己下载AI模型进行训练的话,前提是要有一个GPU服务器,因为我在2C4G的服务器上用Ollama下载过qwen2:7B的模型,结果回答速度是非常的慢,几乎一秒吐一个字,所以说普通的云服务器跑AI模型是带不动的,必须要有GPU的独显服务器,然而我为何不选择GPU服务器呢,这里给大家科普一下,2C4G普通云服务器一年的价格在150-200不等,而一个2C4G带GPU的服务器1一个月就需要300+的费用,可想而知,GPU服务器只有企业才能用得起,个人的话完全没必要。

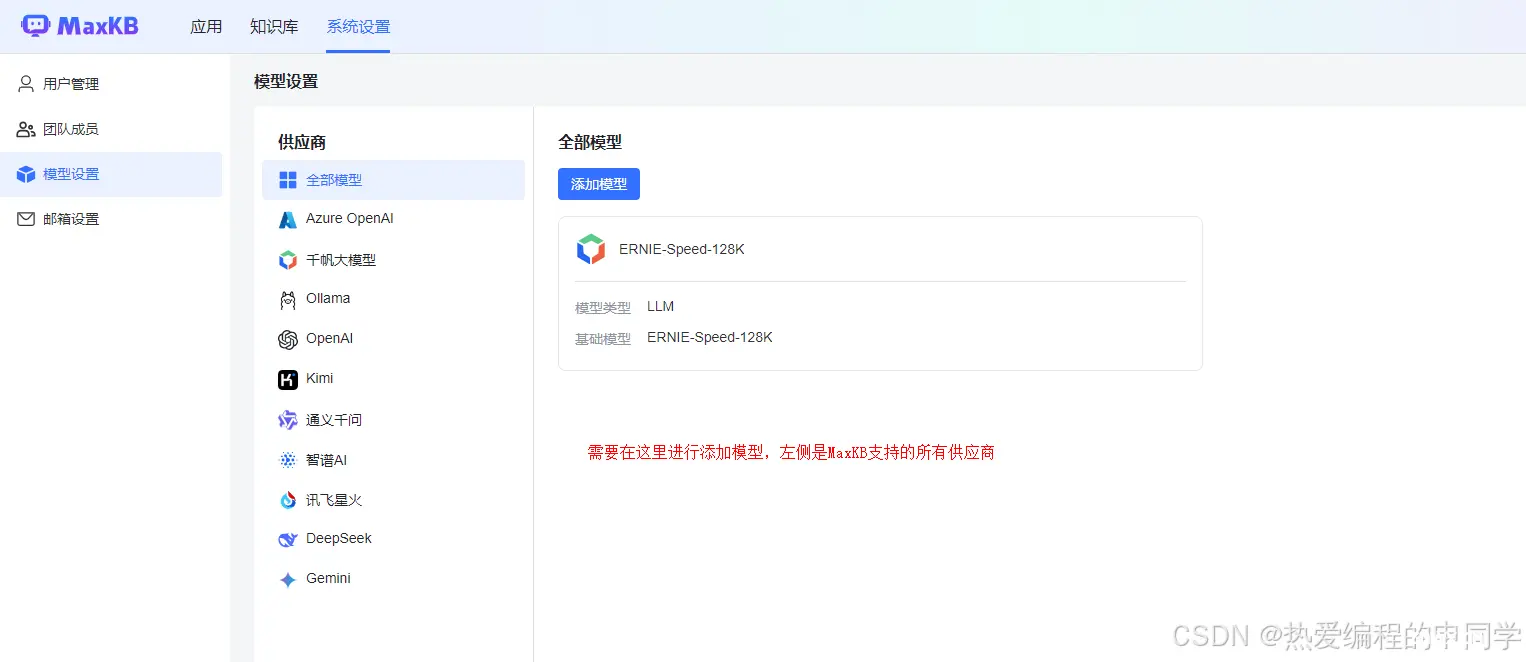

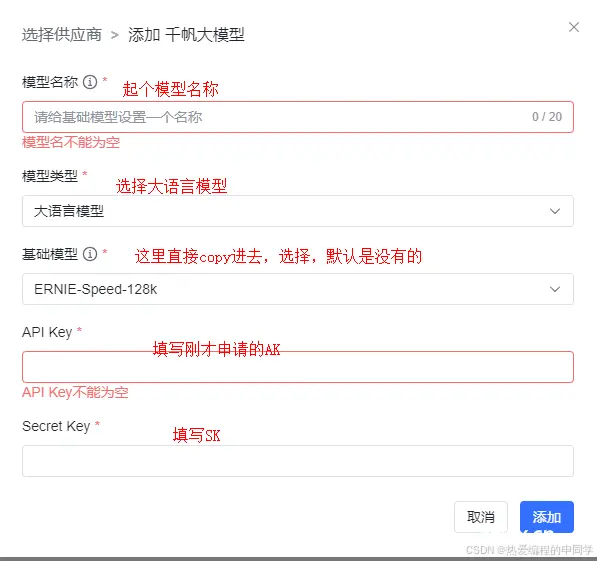

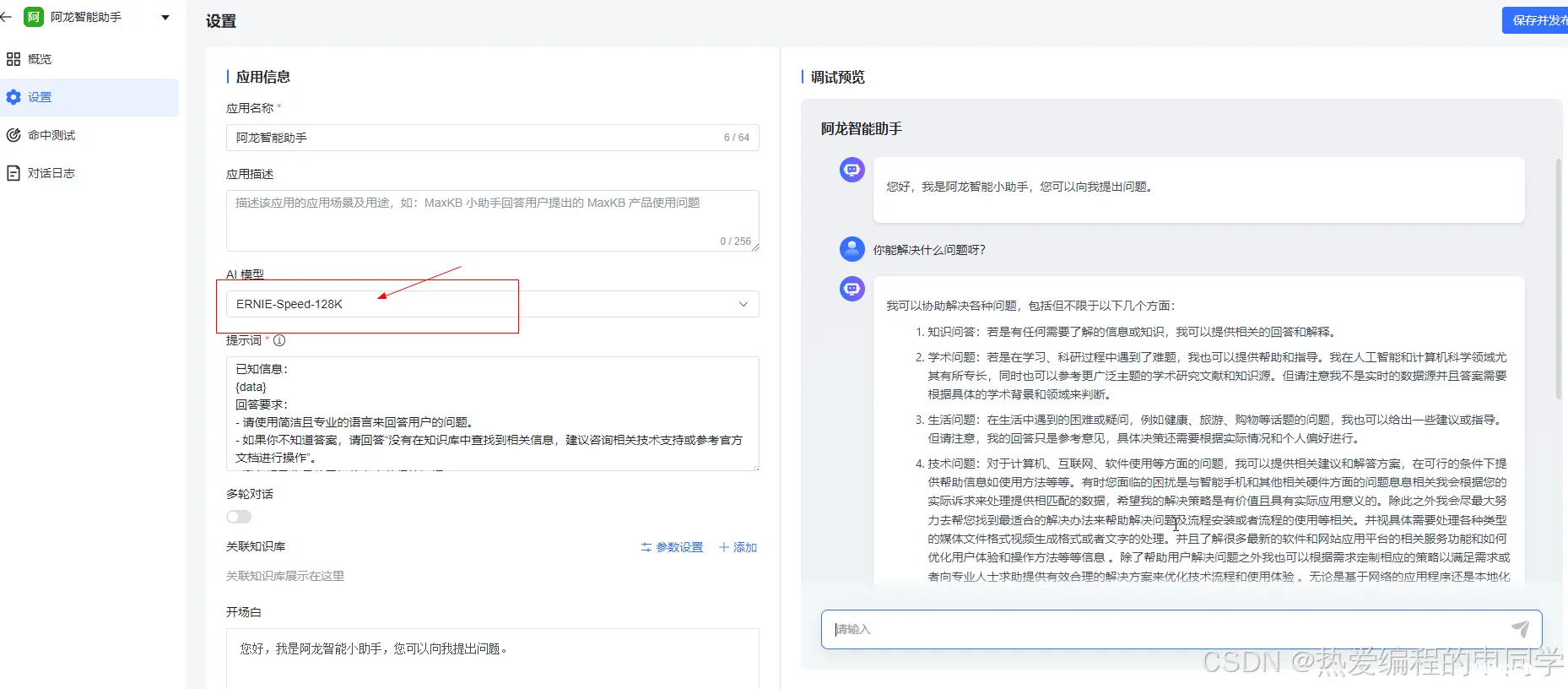

因为我用的是百度的千帆大模型,直接调的API,而且目前这个ERNIE-Speed-128k的模型是免费调用的,现在我来教大家怎么去申请API接口的AK/SK。

进入百度智能云官网 百度智能云产品_云计算_数据库_智能大数据_人工智能-百度智能云

进入千帆大模型平台

申请完后,回到MaxKB,创建AI模型,选择百度千帆大模型

创建完毕后,回到应用中,勾选你刚才创建的AI模型,就可以跟AI模型进行谈话聊天啦

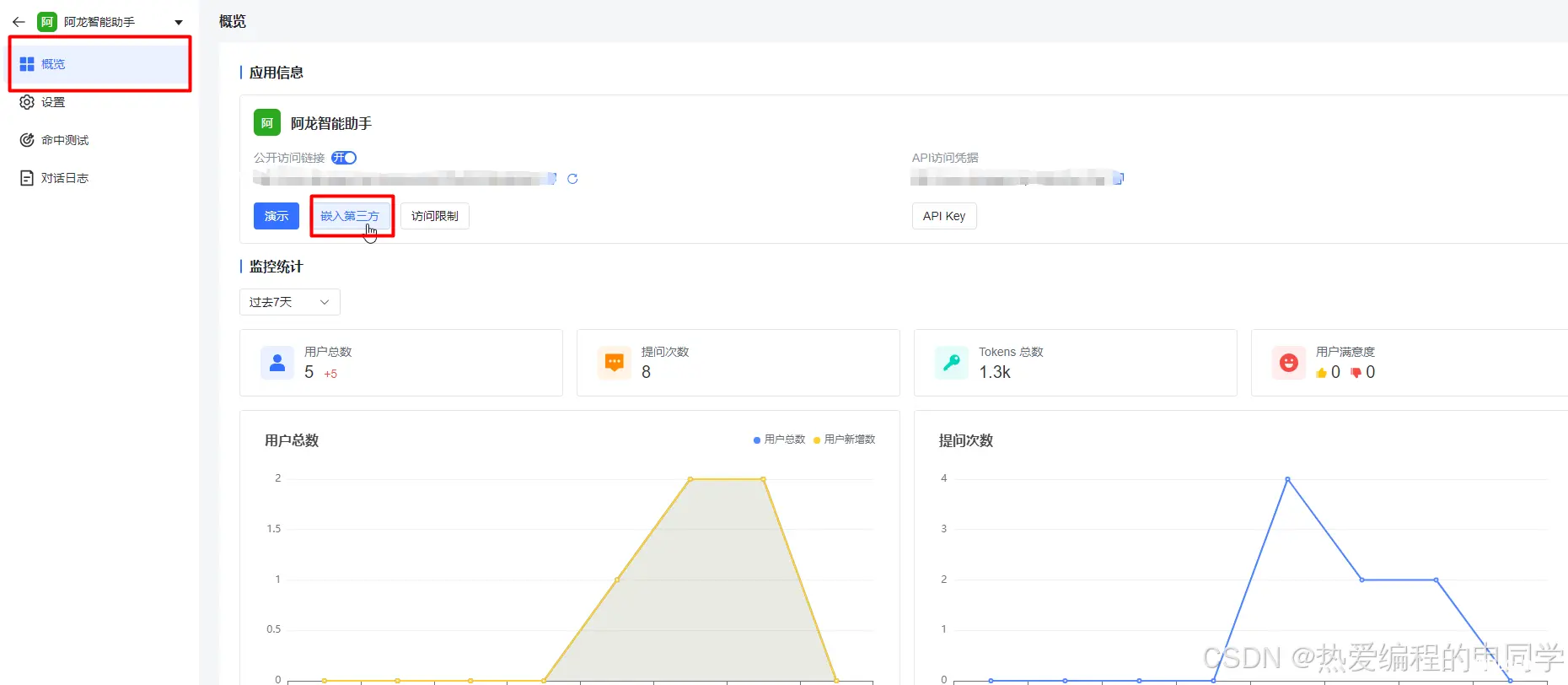

4、内嵌项目

这么好用的AI对话,当然要内嵌到项目中装个B啦,那么MaxKB目前支持两种内嵌方式

根据自己需求,copy下面的代码到项目前端页面中

好啦,今天的文章就到这里结束啦,如果有小伙伴中途遇到什么问题,可以评论区沟通哦!制作不易,点个赞吧。

声明

本文内容仅代表作者观点,或转载于其他网站,本站不以此文作为商业用途

如有涉及侵权,请联系本站进行删除

转载本站原创文章,请注明来源及作者。