【AI之路】使用RWKV-Runner启动大模型,彻底实现大模型自由

IT里的交易员 2024-06-22 13:01:15 阅读 78

文章目录

前言一、RWKV-Runner是什么?RWKV-Runner是一个大语言模型的启动平台RWKV-Runner官方功能介绍 二、使用步骤1. 下载文件 总结

前言

提示:这里可以添加本文要记录的大概内容:

ChatGPT的横空出世,打开了AI的大门,但是国内访问ChatGPT障碍颇多,那么有没有适合我们国人的大模型呢?答案是肯定的。

在国人的聪明和勤劳下,这些都不是事儿。

今天我们就介绍一款国人开发的AI平台,关键是可以部署在本地,还可以远程访问。最关键的是免费!!!

对于文章、小说的宝宝们简直是福音!

一、RWKV-Runner是什么?

RWKV-Runner是一个大语言模型的启动平台

它会全自动为你处理一切,你只需要一个仅仅几MB的可执行程序。作者充分考虑了使用者的想法,以傻瓜式的方式即可启动该平台。

Gitee 地址:https://gitee.com/josc146/RWKV-Runner

GitHub地址:https://github.com/josStorer/RWKV-Runner

RWKV-Runner官方功能介绍

RWKV模型管理,一键启动

前后端分离,如果你不想使用客户端,也允许单独部署前端服务,或后端推理服务,或具有WebUI的后端推理服务。 简明服务部署示例 | 服务器部署示例

与OpenAI API兼容,一切ChatGPT客户端,都是RWKV客户端。启动模型后,打开 http://127.0.0.1:8000/docs 查看API文档

全自动依赖安装,你只需要一个轻巧的可执行程序

预设多级显存配置,几乎在各种电脑上工作良好。通过配置页面切换Strategy到WebGPU,还可以在AMD,Intel等显卡上运行

自带用户友好的聊天,续写,作曲交互页面。支持聊天预设,附件上传,MIDI硬件输入及音轨编辑。 预览 | MIDI硬件输入

内置WebUI选项,一键启动Web服务,共享硬件资源

易于理解和操作的参数配置,及各类操作引导提示

内置模型转换工具

内置下载管理和远程模型检视

内置一键LoRA微调 (仅限Windows)

也可用作 OpenAI ChatGPT 和 GPT Playground 客户端 (在设置内填写API URL和API Key)

多语言本地化

主题切换

自动更新

二、使用步骤

1. 下载文件

下载懒人包:

https://pan.baidu.com/s/1zdzZ_a0uM3gDqi6pXIZVAA?pwd=1111

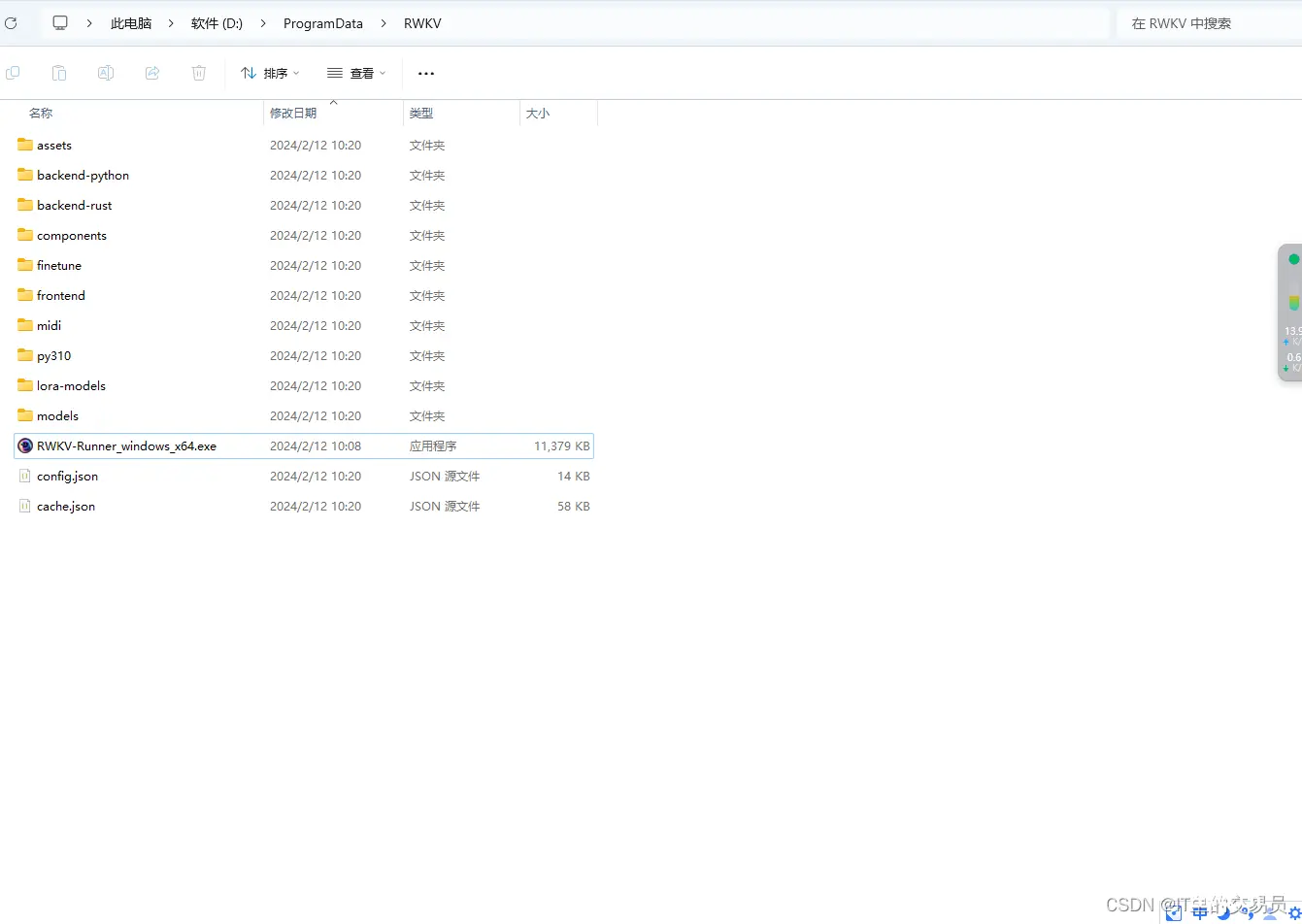

将下载后的文件放到:D:\ProgramData\RWKV。这里放到D盘目录是因为运行文件后会自动生成很多文件,而且模型一般比较大,放在C盘容易造成空间问题。

运行后RWKV-Runner_windows_x64.exe后,目录内容生成如下:

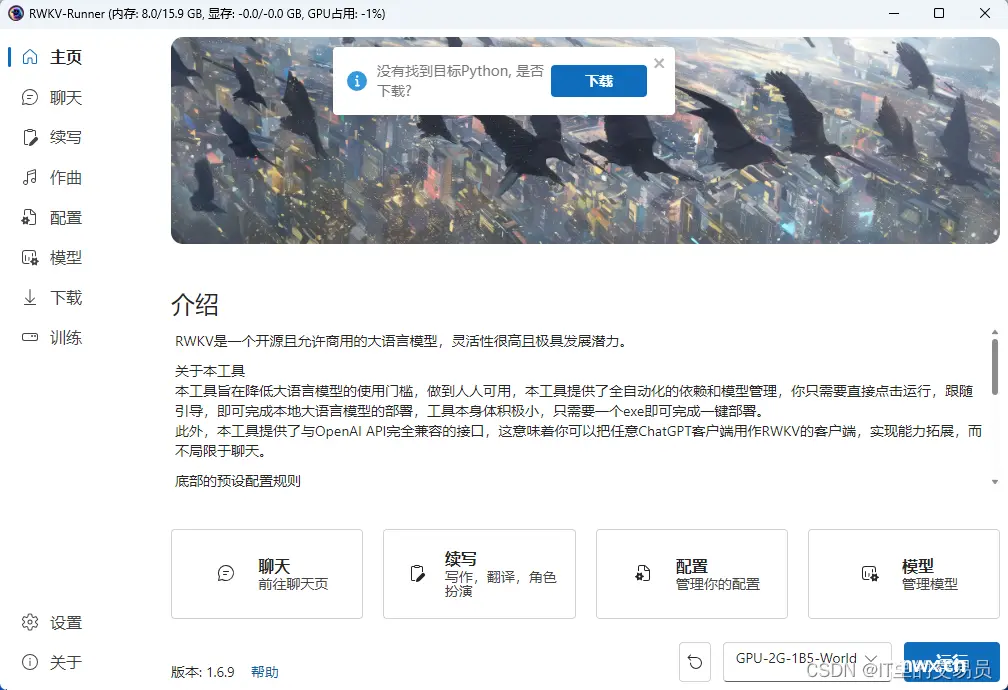

运行后界面如下:

看到这个界面,是不是很兴奋,别着急。不信你点击“运行”试试。

哦,原来是没有Python运行环境(虽然本地允许有运行环境,但没有配置前,那都不算数。为方便,也为与其它环境隔离,我们单独建立Python运行环境,这里的版本是3.10),点下载安装Python。

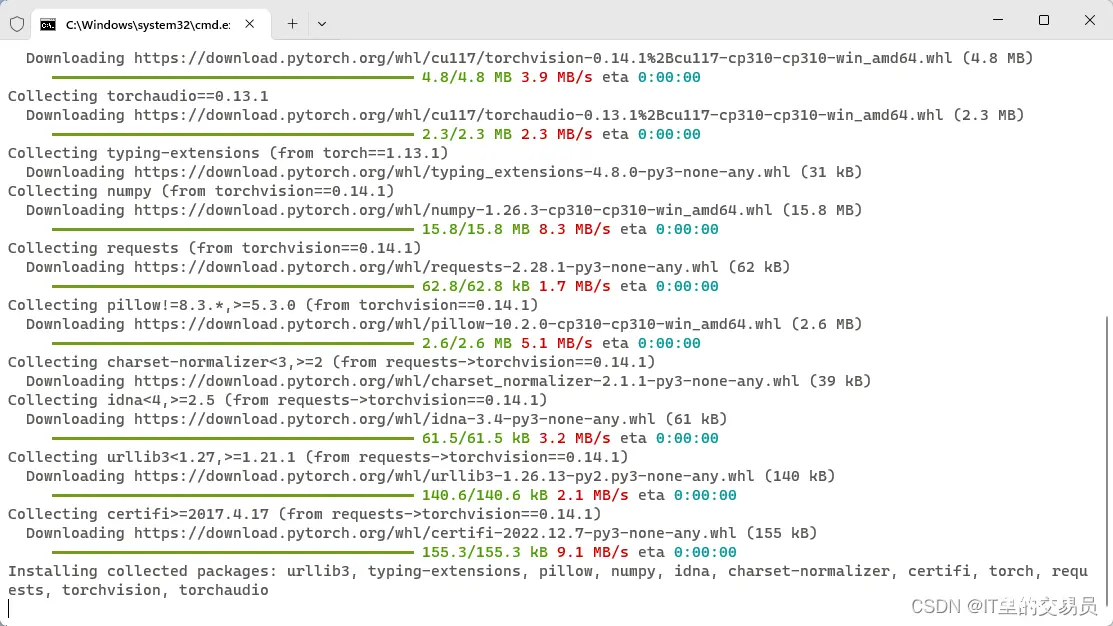

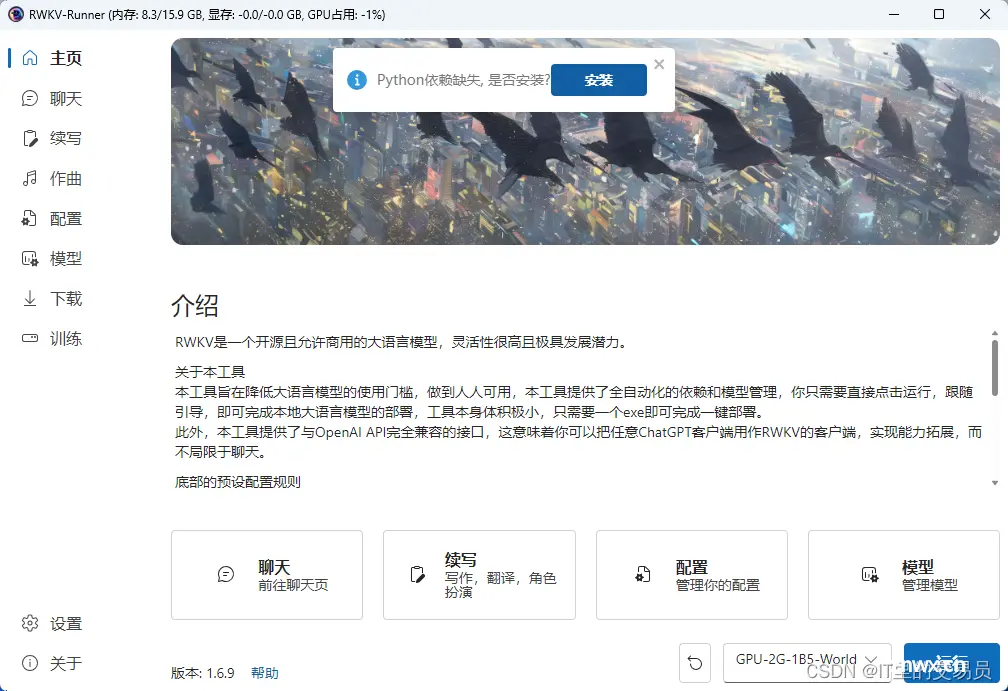

安装Python,还是不行,纳尼?还去依赖库,是啊,哪个Python不是一堆积木拼出来的。继续点安装。

会弹出一个cmd命令窗口,可以看到正在下载各种库,这个不用管,让系统自动下载就好,安装完第三方库,窗口会自动关闭。

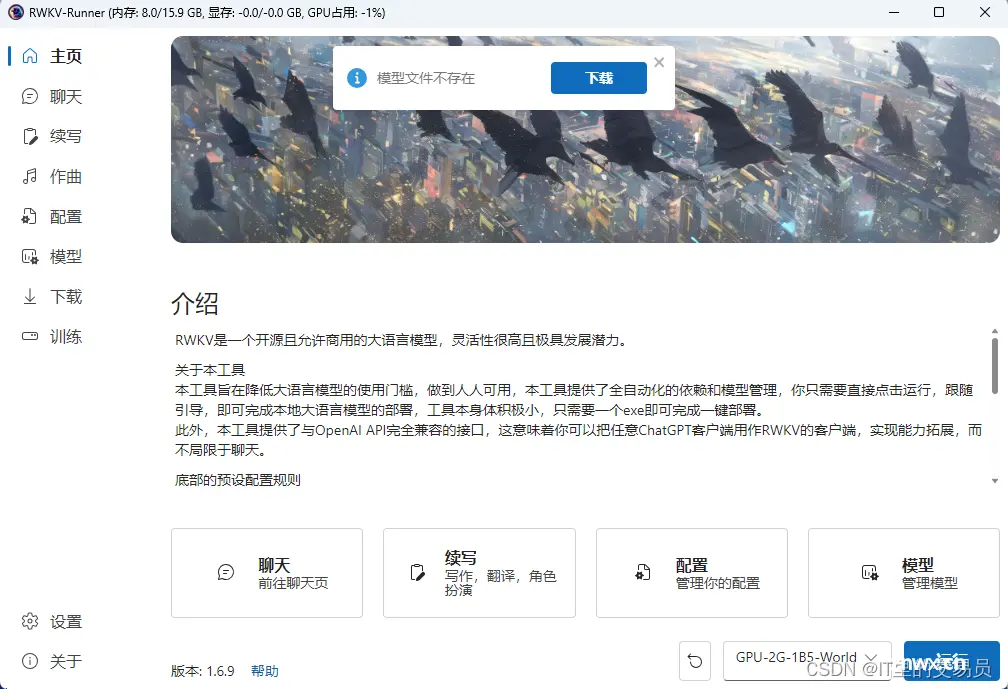

再次点击运行,又提示模型文件不存在!对头,这里虽然选择了默认的模型:GPU-2G-1B5-World,但模型文件我们并没有下载。

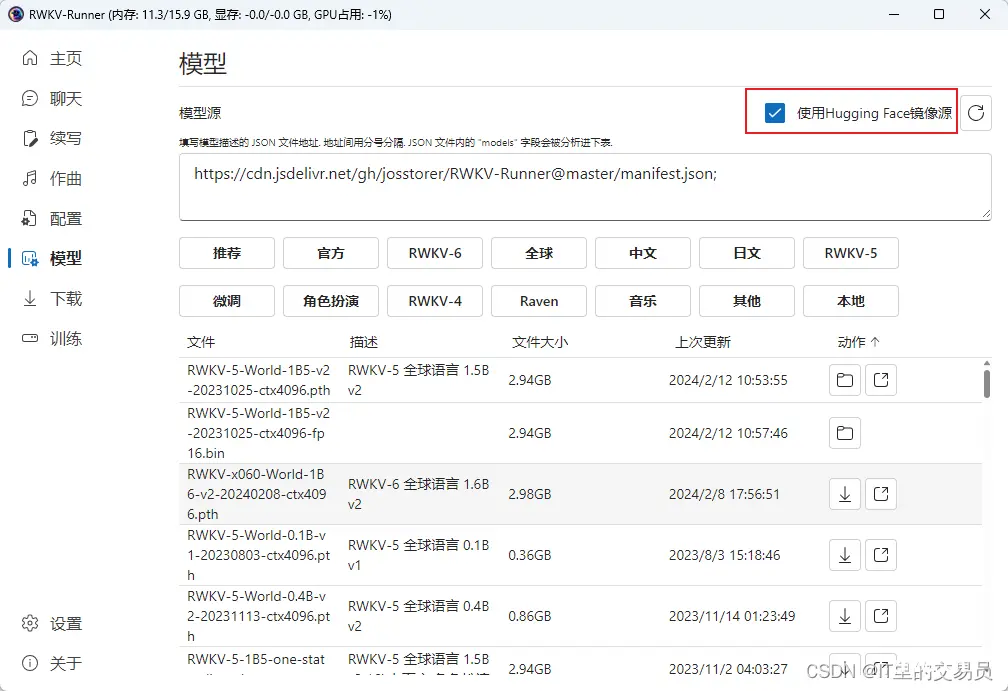

这里我们切换到“模型”页面,国内下载记着勾选“使用Hugging Face镜像源”,这样下载会快一些。

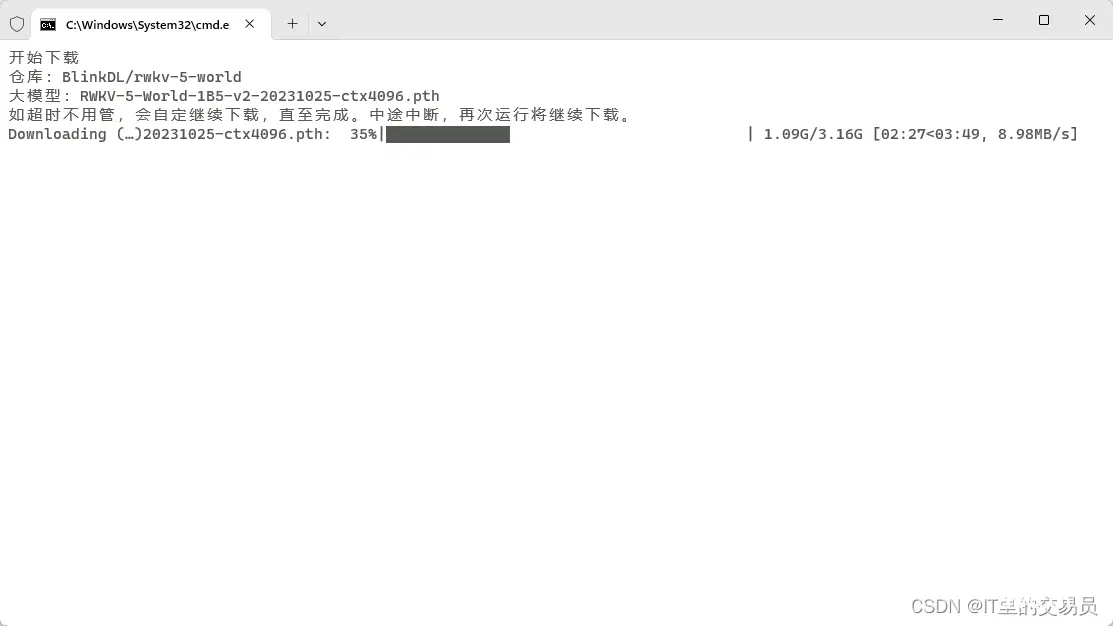

注:如果觉得这个下载也慢,也可以借用笔者的终极大法,参见之前文章进行下载。

【AI之路】使用huggingface_hub通过huggingface镜像站hf-mirror.com下载大模型(附代码,实现大模型自由)

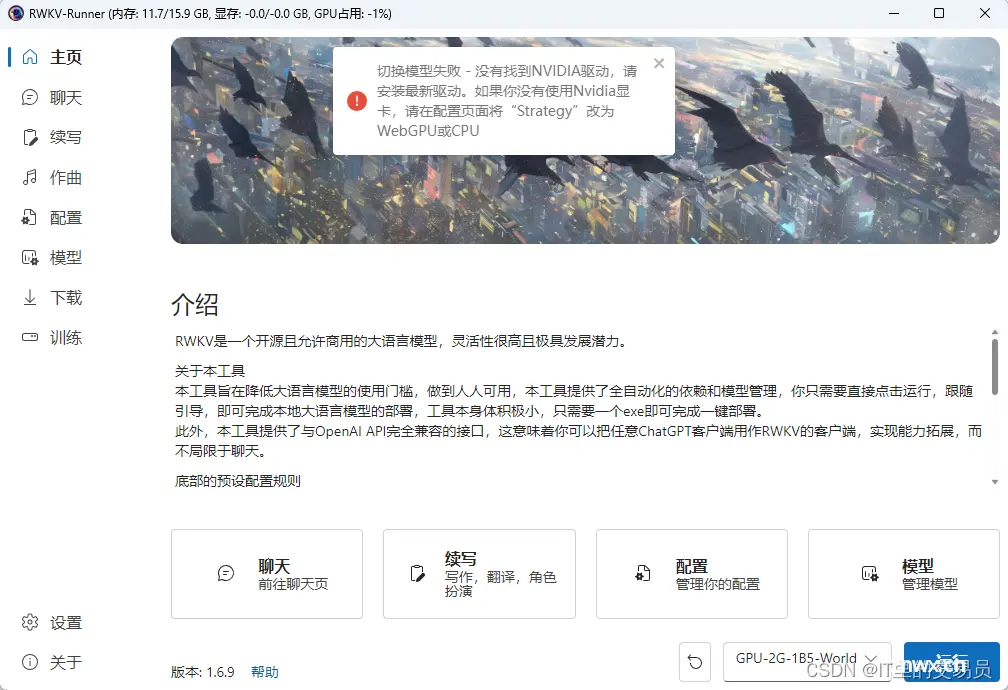

下载完大模型,再次点击运行,又报错。因为笔者这里没有使用英伟达的GPU,所以自然没有NVIDIA驱动,也没有CUDA可以进行加速,那就不能玩了吗?其实还是可以的。按如下修改即可。

进入配置页面,选择刚才下载的模型,将Strategy切换为CPU即可,如下图:

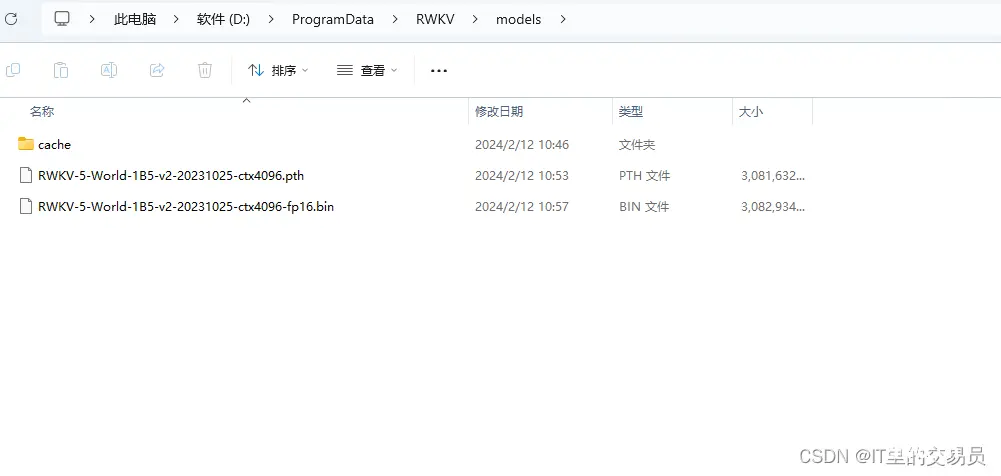

切换后,还需要对模型进行转化才可以使用。默认精度int8,选择fp16,之后转换为GGML格式。在models目录就会看到除了刚才下载的模型,又多了一个带fp16的bin文件。

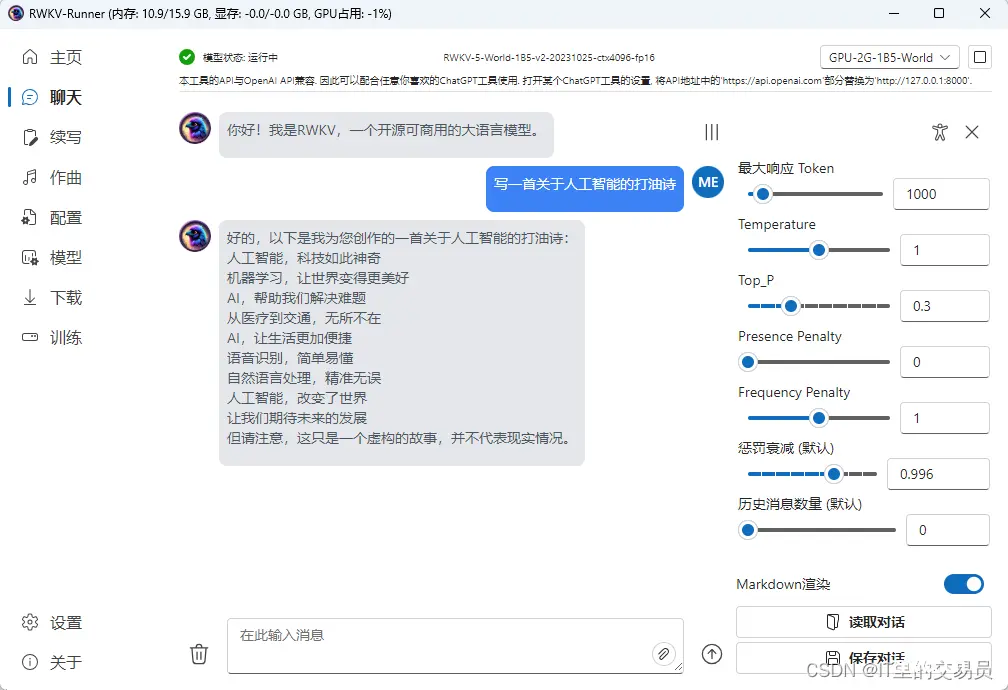

再次返回主界面,进入聊天,即可开启对话模式。如下:

在下面的对话框输入消息,并点击右侧的向上箭头发送给大模型,就可以看到大模型已经开始运行,并反馈结果了。

另外,这里我们可以调节右侧的参数,调整大模型的生成效果。这个UI作者也是非常用心的。把鼠标放在参数上就会显示参数的功用。

参数“最大响应Token”最重要,决定了一次对话生成内容的长度。可根据自己需要修改。GPU的话,可以放到最大,CPU放到最大就看你的CPU性能了。

总结

通过以上安装测试,终于完成RWKV大模型的加载,这样我们就可以随心所欲的生成需要的内容了。再也不用操心token不够用的问题了。不过大模型还是需要调教的,在电脑性能、大模型产能和效果之间取一个平衡才是最好。

另外,细心的小伙伴已经发现,这个大模型启动平台还有个web访问地址:http://127.0.0.1:8000/#/。我们直接打开地址可以看到如客户端 一般模样的UI。甚至还可以通过其它平台,使用这个界面调用。如果加上ddns还可以实现远程的访问。此为后话,有需要的小伙伴可以自行研究。

声明

本文内容仅代表作者观点,或转载于其他网站,本站不以此文作为商业用途

如有涉及侵权,请联系本站进行删除

转载本站原创文章,请注明来源及作者。