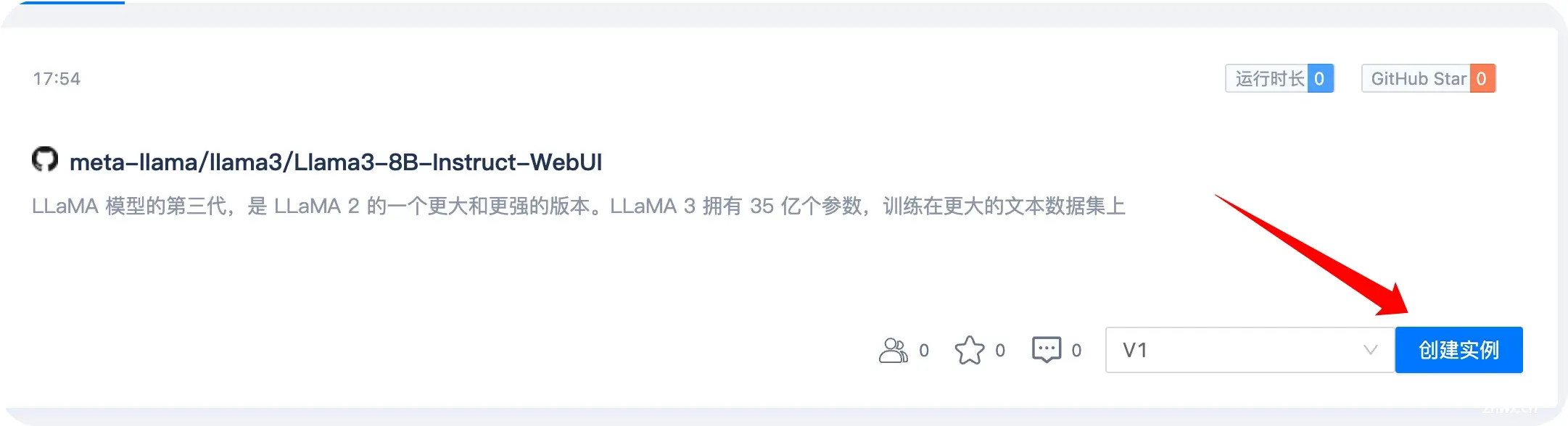

GpuMall智算云:meta-llama/llama3/Llama3-8B-Instruct-WebUI

GpuMall 2024-07-05 14:03:02 阅读 73

LLaMA 模型的第三代,是 LLaMA 2 的一个更大和更强的版本。LLaMA 3 拥有 35 亿个参数,训练在更大的文本数据集上GpuMall智算云 | 省钱、好用、弹性。租GPU就上GpuMall,面向AI开发者的GPU云平台

Llama 3 的推出标志着 Meta 基于 Llama 2 架构推出了四个新的开放型大语言模型。这些模型分为两种规模:8B 和 70B 参数,每种规模都提供预训练基础版和指令调优版。所有版本均可在各种消费级硬件上运行,并具有 8000 Token 的上下文长度。

<code>Meta-Llama-3-8b: 8B 基础模型#autodl#恒源云#矩池云#算力云#恒源云 实例迁移#autodl 官网#autodi#GpuMall#GPU云#AutoDL#AotuDL 算力云#GpuMall智算云#AI#大数据#算力租赁#大模型#深度学习#人工智能#算力变现

Meta-Llama-3-8b-instruct: 8B 基础模型的指令调优版

Meta-Llama-3-70b: 70B 基础模型

Meta-Llama-3-70b-instruct: 70B 基础模型的指令调优版

与 Llama 2 相比,Llama 3 最大的变化是采用了新的 Tokenizer,将词汇表大小扩展至 128,256(前版本为 32,000 Token)。这一更大的词汇库能够更高效地编码文本(无论输入还是输出),并有可能提升模型的多语种处理能力。不过,这也导致嵌入层的输入和输出矩阵尺寸增大,这是小型模型参数增加(从 Llama 2 的 7B 增至 Llama 3 的 8B)的主要原因之一。此外,8B 版本的模型现在采用了分组查询注意力(GQA),这是一种效率更高的表达方式,有助于处理更长的上下文。

创建实例

通过该模型创建实例,需要使用16G以上显存GPU,建议使用 3090 或 4090,否则因显存问题无法载入模型。

创建自定义端口

实例创建成功后,点击更多 - 创建自定义端口

输入<code>7860端口(该端口为实例中 text-generation-webui 监听的端口)

端口重置成功后点击<code>自定义端口7860,然后跳转到Llama3模型的web控制台

载入模型并使用

1.选择<code>Model

2.切换模型为Meta-Llama-3-8B-Instruct

3.点击Load来加载模型

4.等待模型加载成功

切换到Chat,然后就可以开始与Meta-Llama-3-8b-instruct模型开始对话了。

声明

本文内容仅代表作者观点,或转载于其他网站,本站不以此文作为商业用途

如有涉及侵权,请联系本站进行删除

转载本站原创文章,请注明来源及作者。