通俗易懂的GPT原理简介

qq_41771998 2024-06-23 16:31:01 阅读 74

GPT是自然语言处理领域中最受欢迎的模型之一。GPT全称为Generative Pre-trained Transformer,是一种基于Transformer模型的预训练语言模型。在接下来的文章中,我们将详细介绍GPT的原理。

一、前置知识

在了解GPT原理之前,需要了解以下一些基础知识:

1.自然语言处理:自然语言处理是指计算机处理人类自然语言的技术。目的是让计算机能够理解、分析和生成人类语言。

2.神经网络:神经网络是一种模拟人脑的计算模型,可以用来进行各种机器学习任务。它由许多神经元(节点)和它们之间的连接构成,可以通过训练来优化权重和偏置。

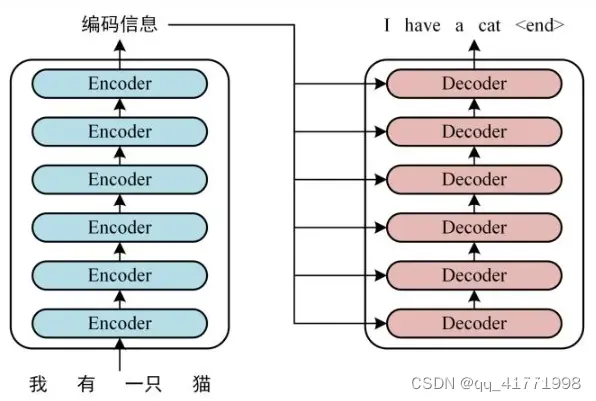

3.Transformer模型:Transformer是一种基于注意力机制的序列到序列模型,由Google在2017年提出,主要用于机器翻译任务。Transformer可以并行计算,因此在处理长序列数据时比循环神经网络更快。

二、GPT的结构

GPT是由多个Transformer编码器(Transformer Encoder)组成的模型,如下图所示:

每个Transformer编码器包含多个自注意力(self-attention)层和前馈神经网络层(feed-forward neural network layer)。每个自注意力层都包含三个线性变换(Linear Transformation),即查询(Query)、键(Key)和值(Value)。

在输入序列经过第一个Transformer编码器之后,它的隐藏状态(hidden state)被送入下一个Transformer编码器,这样一直进行下去,直到最后一个Transformer编码器。

在模型的末尾,还有一个线性变换层和一个softmax激活函数,用于将最后一个Transformer编码器的隐藏状态映射为预测标签的概率分布。

三、GPT的预训练

GPT的预训练过程包括两个阶段:无监督预训练和有监督微调。

无监督预训练

在无监督预训练阶段,GPT使用了大量的文本数据进行训练,包括Wikipedia、Gutenberg等。

训练数据会被分成一些不同的序列(sequence),每个序列被看作是一个任务,模型需要预测序列中下一个单词的概率分布。

对于每个序列,GPT将输入序列中的每个单词编码成向量表示,并将其输入到Transformer编码器中。每个编码器都会输出一个隐藏状态,代表模型对下一个单词的预测。然后,模型使用交叉熵损失函数(cross-entropy loss function)计算预测分布和真实下一个单词的概率分布之间的差异,并使用反向传播算法更新模型参数。

在训练过程中,GPT使用了遮蔽语言模型(Masked Language Model,MLM)的思想,即在输入序列中随机遮蔽一些单词,并要求模型预测这些遮蔽单词的概率分布。这可以使模型更好地学习单词的上下文信息。

2.有监督微调

在无监督预训练完成后,GPT通常需要进行有监督微调,以便在特定任务上取得更好的性能。微调的过程通常包括两个步骤:

首先,将预训练的GPT模型输入到一个特定任务的训练集中,从而使其在该任务上进行有监督训练。例如,如果我们想要使用GPT进行情感分类,我们将GPT模型输入到一个情感分类数据集中进行训练。

其次,我们可以对微调后的模型进行测试,以评估其在特定任务上的性能。

四、GPT的应用

由于GPT在自然语言处理中的卓越表现,它已经被广泛应用于各种任务中,包括:

1.语言建模:GPT在语言建模方面的性能非常出色,可以预测下一个单词、下一个句子甚至是下一个段落。

2.机器翻译:GPT可以将一种语言翻译成另一种语言,尤其是在处理长句子时效果更佳。

3.文本摘要:GPT可以生成文本摘要,使得用户可以快速地了解文本的主要内容。

4.情感分析:GPT可以识别文本中的情感,帮助用户了解文本的情感色彩。

5.自动问答:GPT可以回答用户提出的问题,从而为用户提供便捷的信息服务。

五、总结

综上所述,GPT是自然语言处理领域中最强大的模型之一,它的出色表现已经使得它在各种应用场景中得到了广泛的应用。

声明

本文内容仅代表作者观点,或转载于其他网站,本站不以此文作为商业用途

如有涉及侵权,请联系本站进行删除

转载本站原创文章,请注明来源及作者。