入门篇,带你了解CPU, GPU, TPU, NPU, DPU

今夕是何年, 2024-10-18 10:31:04 阅读 87

目录

CPU (中央处理器)

GPU (图形处理器)

TPU (张量处理单元)

NPU (神经网络处理器)

DPU (数据处理器)

CPU (中央处理器)

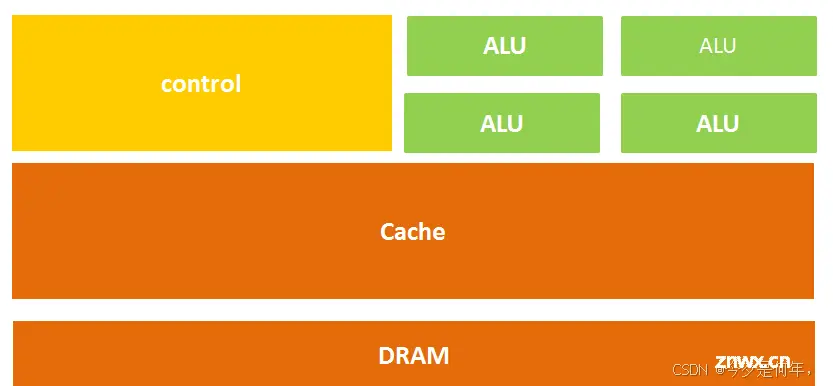

专业介绍: CPU是计算机系统的核心,负责执行操作系统和应用程序的指令。它由多个核心组成,每个核心可以独立执行任务。CPU的设计重点是处理复杂的逻辑运算和顺序任务,如分支预测、指令调度等。现代CPU通常包含多个层级的缓存(如L1、L2和L3缓存),以减少访问主存储器的延迟。CPU的架构设计如超标量(Superscalar)、乱序执行(Out-of-Order)和多线程(Multi-threading)等,都是为了提高其处理效率。

通俗易懂: 想象一下CPU就像一个多任务的超级大脑,它能够同时处理很多任务,比如计算数学题、管理文件、运行应用程序等。CPU就像一个指挥官,告诉计算机的各个部分该做什么,确保一切都井井有条。

GPU (图形处理器)

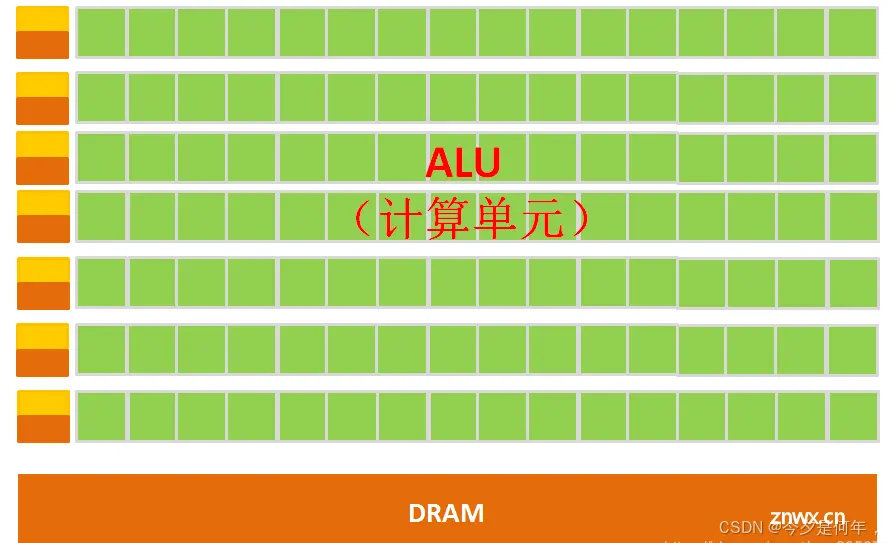

专业介绍: GPU最初是为图形和图像渲染设计的,但随着并行计算需求的增加,它们也被用于处理更广泛的计算任务。GPU拥有大量的并行处理单元,称为流处理器(Streaming Processors),这些处理器可以同时执行成千上万的计算任务。这种并行性使得GPU非常适合执行深度学习、科学计算和数据分析等任务。GPU的架构设计如统一内存访问(Unified Memory)和虚拟内存管理(Virtual Memory Management)等,都是为了提高其处理效率和灵活性。

通俗易懂: GPU就像一个专门处理图像和视频的超级助手。它特别擅长同时处理很多图像,比如在视频游戏中渲染复杂的场景。随着技术的发展,GPU也被用来帮助计算机学习新事物,比如通过分析大量数据来识别图片中的猫和狗。

TPU (张量处理单元)

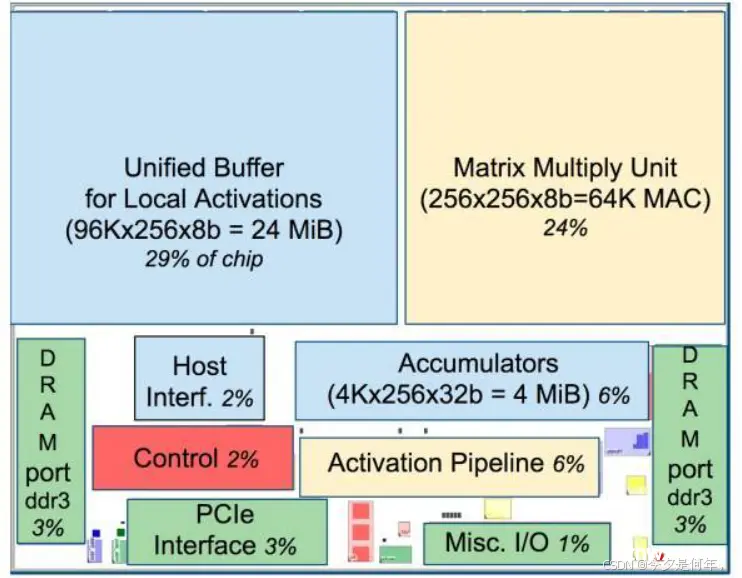

专业介绍: TPU是谷歌开发的一种专门为机器学习应用设计的处理器。它们优化了深度学习算法中的矩阵运算和并行处理,从而在执行深度学习模型训练和推理时提供更高的效率。TPU的设计包括专用的硬件加速器,如张量核心(Tensor Cores),这些核心可以高效地执行深度学习中的复杂数学运算。TPU的架构设计如低延迟的内存访问和高效的数据流管理,都是为了提高其在机器学习任务中的性能。

通俗易懂: TPU就像是专门为学习新事物(比如识别图片中的猫和狗)而设计的超级大脑。它特别擅长处理那些需要大量数学计算的任务。想象一下,TPU就像一个数学天才,能够快速解决复杂的数学问题,帮助计算机变得更聪明。

NPU (神经网络处理器)

专业介绍: NPU是为执行神经网络计算而设计的处理器。它们优化了深度学习算法中的矩阵运算和数据流,从而在执行这些任务时提供更高的性能和效率。NPU的设计包括专用的硬件加速器,如深度学习加速器(Deep Learning Accelerators),这些加速器可以高效地执行神经网络中的前向传播和反向传播。NPU的架构设计如专用的内存管理和数据流调度,都是为了提高其在神经网络任务中的性能。

通俗易懂: NPU就像是专门用来训练和运行“大脑”的处理器。它帮助计算机学习如何识别图片、理解语言等。想象一下,NPU就像一个训练师,帮助计算机通过分析大量数据来学习新技能。

DPU (数据处理器)

专业介绍: DPU是一种用于处理数据密集型任务的处理器,特别是在数据中心和边缘计算环境中。它们优化了数据的存储、传输和处理,以支持高效的数据操作。DPU的设计包括专用的硬件加速器,如数据流处理器(Data Flow Processors),这些处理器可以高效地处理数据流和执行数据密集型操作。DPU的架构设计如高效的内存访问和数据缓存管理,都是为了提高其在数据密集型任务中的性能。

通俗易懂: DPU就像是数据的超级搬运工。它帮助计算机快速处理和移动大量的数据,比如在处理大量用户数据或进行数据分析时。想象一下,DPU就像一个物流经理,确保数据在计算机系统中高效、准确地流动。

每种处理器都有其独特的优势和应用场景,选择哪种处理器取决于具体的任务需求和性能要求。例如,CPU适合处理复杂的逻辑运算和顺序任务,GPU适合处理并行计算密集型任务,TPU和NPU适合处理深度学习和神经网络任务,而DPU适合处理数据密集型任务。通过合理选择和组合这些处理器,可以显著提高计算机系统的整体性能和效率。

声明

本文内容仅代表作者观点,或转载于其他网站,本站不以此文作为商业用途

如有涉及侵权,请联系本站进行删除

转载本站原创文章,请注明来源及作者。