AI-Ollama安装部署总结

Z天蝎座 2024-09-16 14:31:01 阅读 94

简介

Ollama 是一个基于 Go 语言开发的可以本地运行大模型的开源框架。

官网地址

<code>https://ollama.com/

github地址

https://github.com/ollama/ollama

博主运行环境

| 内存 | 48G 金士顿 |

|---|---|

| cpu | 12代I7 |

| gpu | RTX3060 laptop 12G |

| cuda | CUDA Version: 12.1 |

| 系统 | windows11 |

| docker | 4.34.0 |

windows安装

直接访问官网地址下载exe安装即可,默认直接装在c盘下面。

C:\Users\yourname\AppData\Local\Programs\Ollama

环境变量

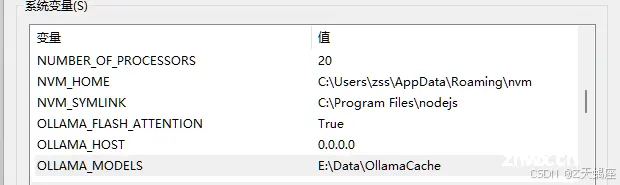

windows加入系统变量

#作用提高长文本推理速度

OLLAMA_FLASH_ATTENTION True

#作用可访问的ip以及端口 默认是11434

OLLAMA_HOST 0.0.0.0:11434

#模型存放位置

OLLAMA_MODELS E:\Data\OllamaCache

#设置 Ollama 服务的并行处理数量为 2,表示可以同时处理 2个请求。

OLLAMA_NUM_PARALLEL 2

如图所示

检验安装

声明

本文内容仅代表作者观点,或转载于其他网站,本站不以此文作为商业用途

如有涉及侵权,请联系本站进行删除

转载本站原创文章,请注明来源及作者。