AI 时代的程序员:如何在变革中保持核心竞争力(万字长文)

CSDN 2024-08-14 09:31:02 阅读 54

你是否曾经想象过,有一天你的代码伙伴可能不再是人类,而是一个能够瞬间生成复杂算法的 AI?这个未来已经悄然来临。随着 ChatGPT、Midjourney 和 Claude 等 AIGC 技术的迅猛发展,AI 辅助编程工具正在重塑我们的工作方式。面对这场技术革命,我们该如何应对?本文将深入探讨 AI 时代程序员的核心竞争力,以及如何在这个快速变化的环境中保持领先地位。

AI 编程助手的崛起

在过去的几年里,我们见证了 AI 技术在编程领域的快速发展。从简单的代码补全工具到能够生成完整函数的 AI 助手,这些技术正在改变我们编写代码的方式。以下是几个引人注目的 AI 编程工具:

GitHub Copilot:由 OpenAI 和 GitHub 合作开发,基于 GPT-3.5 架构,能够根据注释和上下文生成代码片段。

TabNine:利用深度学习技术,提供智能代码补全和建议。

Kite:专注于 Python 开发的 AI 辅助工具,提供实时代码补全和文档查询。

CodeGeeX:清华大学开发的开源 AI 编程助手,支持多种编程语言。

这些工具的出现引发了一个重要问题:AI 是否会取代程序员?答案是否定的。AI 更像是一个强大的助手,而不是替代品。让我们看看 AI 如何改变我们的工作流程。

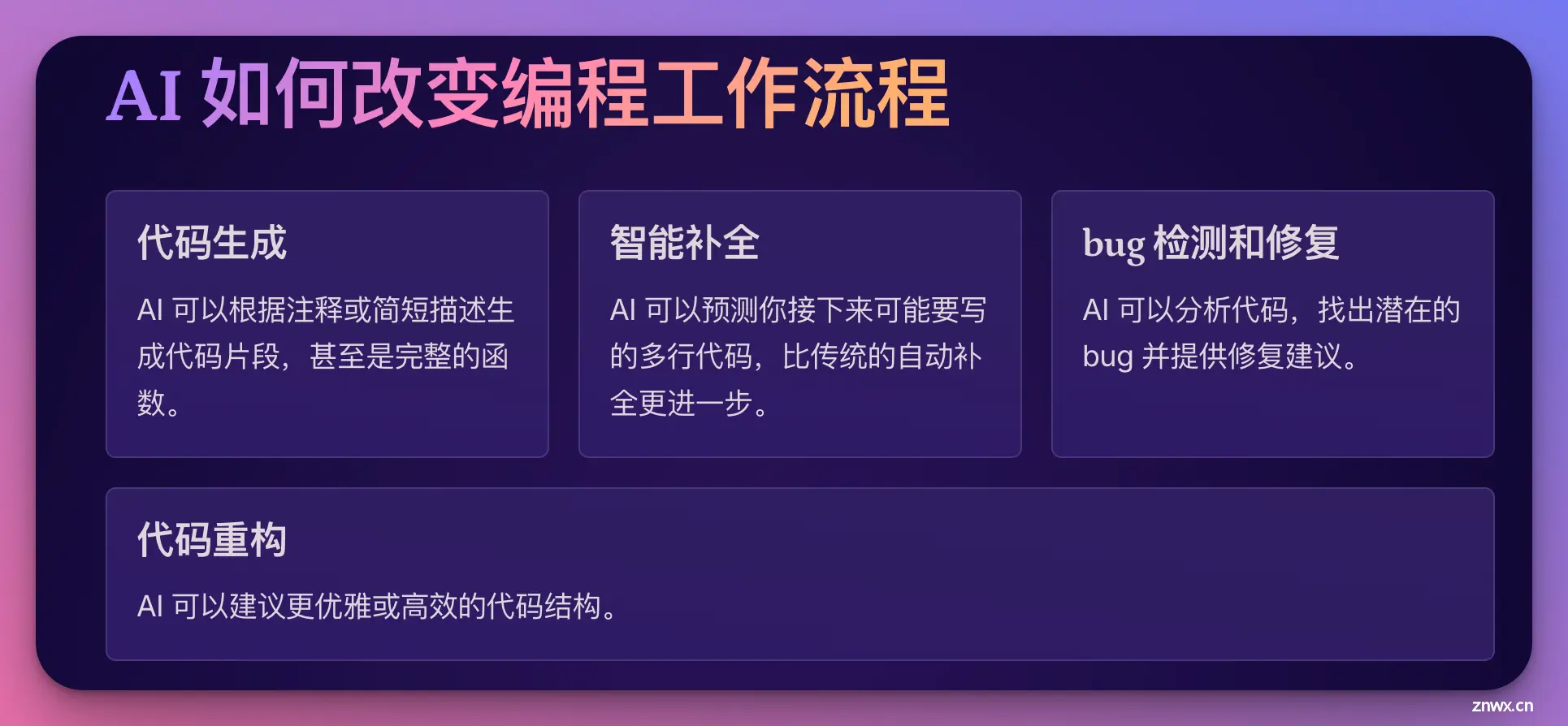

AI 如何改变编程工作流程

AI 编程助手正在以多种方式改变我们的工作方式:

代码生成:AI 可以根据注释或简短描述生成代码片段,甚至是完整的函数。

智能补全:比传统的自动补全更进一步,AI 可以预测你接下来可能要写的多行代码。

bug 检测和修复:AI 可以分析代码,找出潜在的 bug 并提供修复建议。

代码重构:AI 可以建议更优雅或高效的代码结构。

自然语言转代码:将自然语言描述转换为可执行的代码片段。

让我们通过一个实际的例子来看看 AI 如何改变我们的编码过程:

假设我们需要实现一个函数,用于计算给定数组中的最大子数组和(即 Kadane 算法)。传统的编码方式可能是这样的:

<code>def max_subarray_sum(arr):

max_sum = float('-inf')

current_sum = 0

for num in arr:

current_sum = max(num, current_sum + num)

max_sum = max(max_sum, current_sum)

return max_sum

# 测试

arr = [-2, 1, -3, 4, -1, 2, 1, -5, 4]

print(max_subarray_sum(arr)) # 输出: 6

现在,让我们看看使用 AI 编程助手(如 GitHub Copilot)后的工作流程:

首先,我们可能只需要写下函数的注释:

# 实现 Kadane 算法来计算最大子数组和

def max_subarray_sum(arr):

AI 助手会根据这个注释自动生成完整的函数实现:

# 实现 Kadane 算法来计算最大子数组和

def max_subarray_sum(arr):

max_sum = float('-inf')

current_sum = 0

for num in arr:

current_sum = max(num, current_sum + num)

max_sum = max(max_sum, current_sum)

return max_sum

# 测试函数

arr = [-2, 1, -3, 4, -1, 2, 1, -5, 4]

result = max_subarray_sum(arr)

print(f"最大子数组和为: { result}")

我们可以根据需要对生成的代码进行微调或优化。

这个例子展示了 AI 如何加速我们的编码过程。它不仅生成了正确的算法实现,还添加了测试代码。这让我们可以将更多精力集中在算法的理解和优化上,而不是基础代码的编写。

然而,这也带来了新的挑战。如果 AI 可以轻松生成这样的代码,我们作为程序员的价值在哪里?这就引出了我们下一个重要话题:AI 时代程序员的核心竞争力。

AI 时代程序员的核心竞争力

面对 AI 的快速发展,程序员需要重新审视自己的核心竞争力。以下几个方面将成为 AI 时代程序员的关键能力:

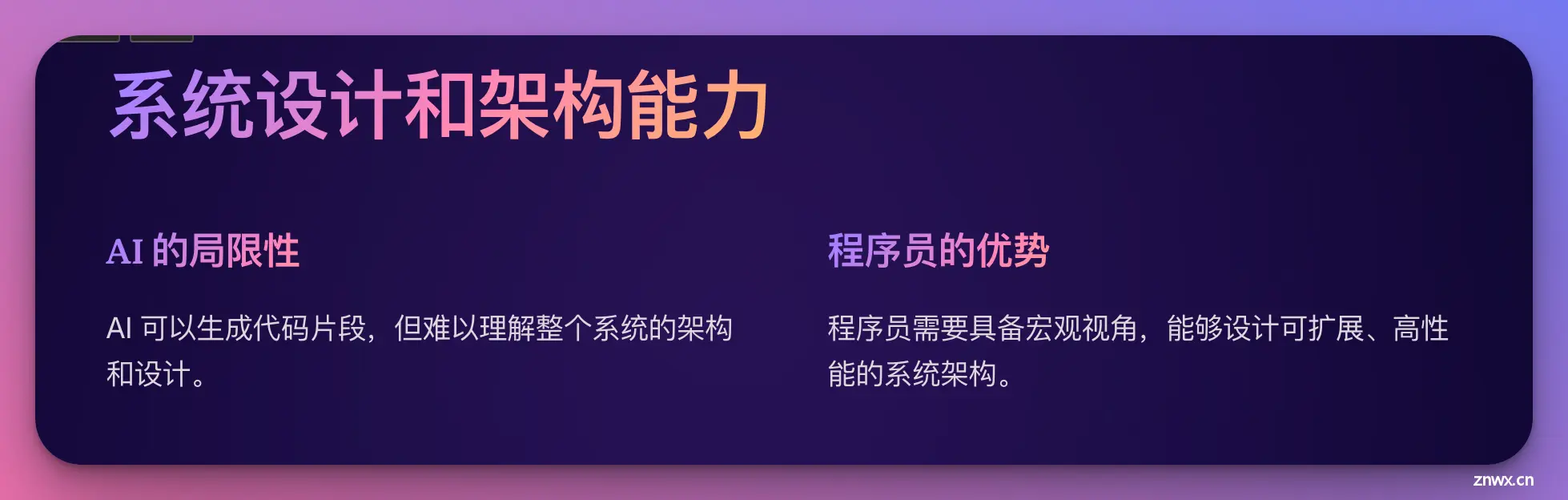

系统设计和架构能力

AI 可以生成代码片段,但难以理解整个系统的架构和设计。程序员需要具备宏观视角,能够设计可扩展、高性能的系统架构。

例如,在设计一个大数据处理系统时,你需要考虑:

数据接入层:如何高效地收集和存储大量数据?计算层:选择批处理还是流处理?如何优化计算资源?存储层:选择什么样的存储系统?如何平衡成本和性能?服务层:如何设计 API 以满足不同客户端的需求?

这些决策需要深入的技术知识和丰富的经验,是 AI 难以替代的。

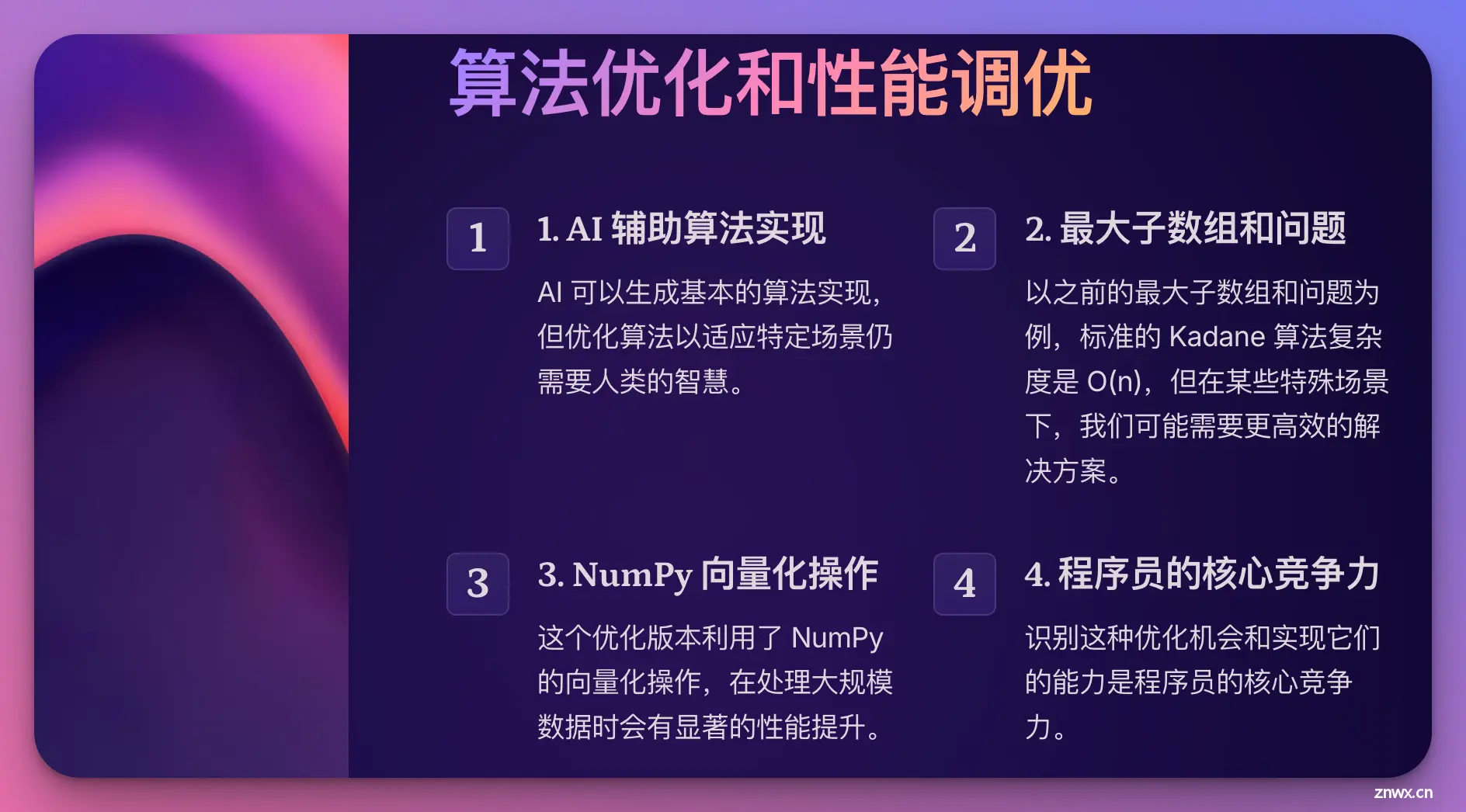

算法优化和性能调优

虽然 AI 可以生成基本的算法实现,但优化算法以适应特定场景仍需要人类的智慧。

以之前的最大子数组和问题为例,标准的 Kadane 算法复杂度是 O(n),但在某些特殊场景下,我们可能需要更高效的解决方案:

<code>import numpy as np

def fast_max_subarray_sum(arr):

cumsum = np.cumsum(arr)

return np.max(cumsum) - np.min(np.minimum.accumulate(np.concatenate(([0], cumsum[:-1]))))

# 测试

arr = np.array([-2, 1, -3, 4, -1, 2, 1, -5, 4])

print(fast_max_subarray_sum(arr)) # 输出: 6

这个优化版本利用了 NumPy 的向量化操作,在处理大规模数据时会有显著的性能提升。识别这种优化机会和实现它们的能力是程序员的核心竞争力。

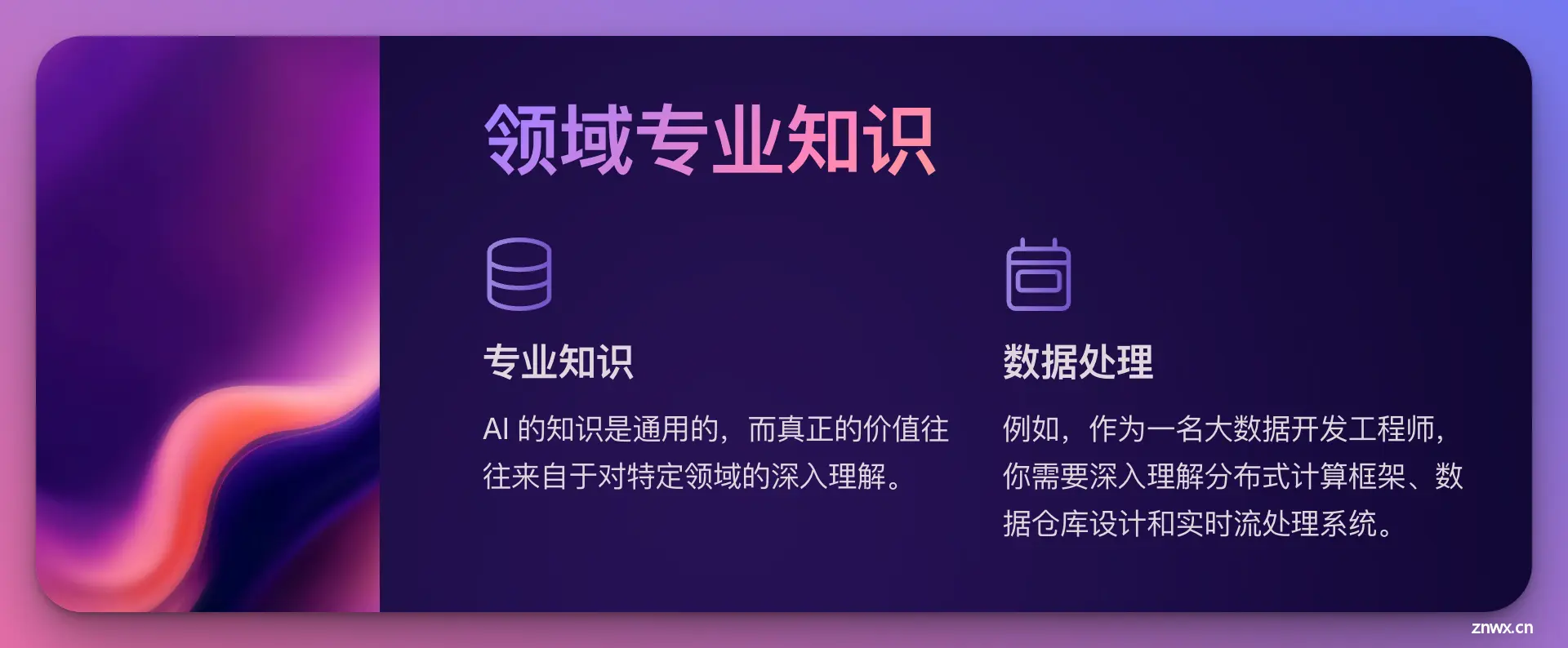

领域专业知识

AI 的知识是通用的,而真正的价值往往来自于对特定领域的深入理解。例如,作为一名大数据开发工程师,你需要深入理解:

分布式计算框架(如 Hadoop、Spark)的内部工作原理数据仓库设计和数据建模的最佳实践实时流处理系统(如 Flink、Kafka Streams)的使用场景和优化技巧

这些专业知识让你能够做出更好的技术决策,设计更高效的数据处理流程。

问题分析和抽象能力

将复杂的业务问题转化为可编程的模型是程序员的重要技能。AI 可以帮助我们编写代码,但它无法理解业务需求并将其转化为技术方案。

例如,假设你正在为一家电商公司开发一个实时推荐系统。你需要考虑:

如何定义用户兴趣模型?哪些因素会影响推荐的准确性?如何平衡推荐的多样性和准确性?如何处理冷启动问题?

这些问题需要你深入理解业务需求,并将其抽象为可实现的算法和数据模型。

持续学习和适应能力

技术领域日新月异,保持学习的热情和能力至关重要。例如,近年来在大数据领域,我们见证了从批处理到流处理的转变,从传统的 ETL 到实时数据集成的演进。

持续学习可能包括:

关注最新的技术趋势和论文参与开源项目尝试新的编程语言或框架参加技术会议和工作坊

沟通和协作能力

在 AI 辅助编程的时代,"软技能"变得越来越重要。能够清晰地表达想法、有效地与团队协作、理解和转化业务需求的能力将成为程序员的关键优势。

例如,在一个大数据项目中,你可能需要:

与数据科学家讨论模型的实现和优化向产品经理解释技术方案的可行性和局限性协调后端、前端和运维团队,确保整个数据管道的顺畅运行

这些能力远远超出了简单的代码编写,它们构成了 AI 时代程序员的核心竞争力。接下来,让我们通过一个实际的案例来看看如何将这些能力应用到实践中。

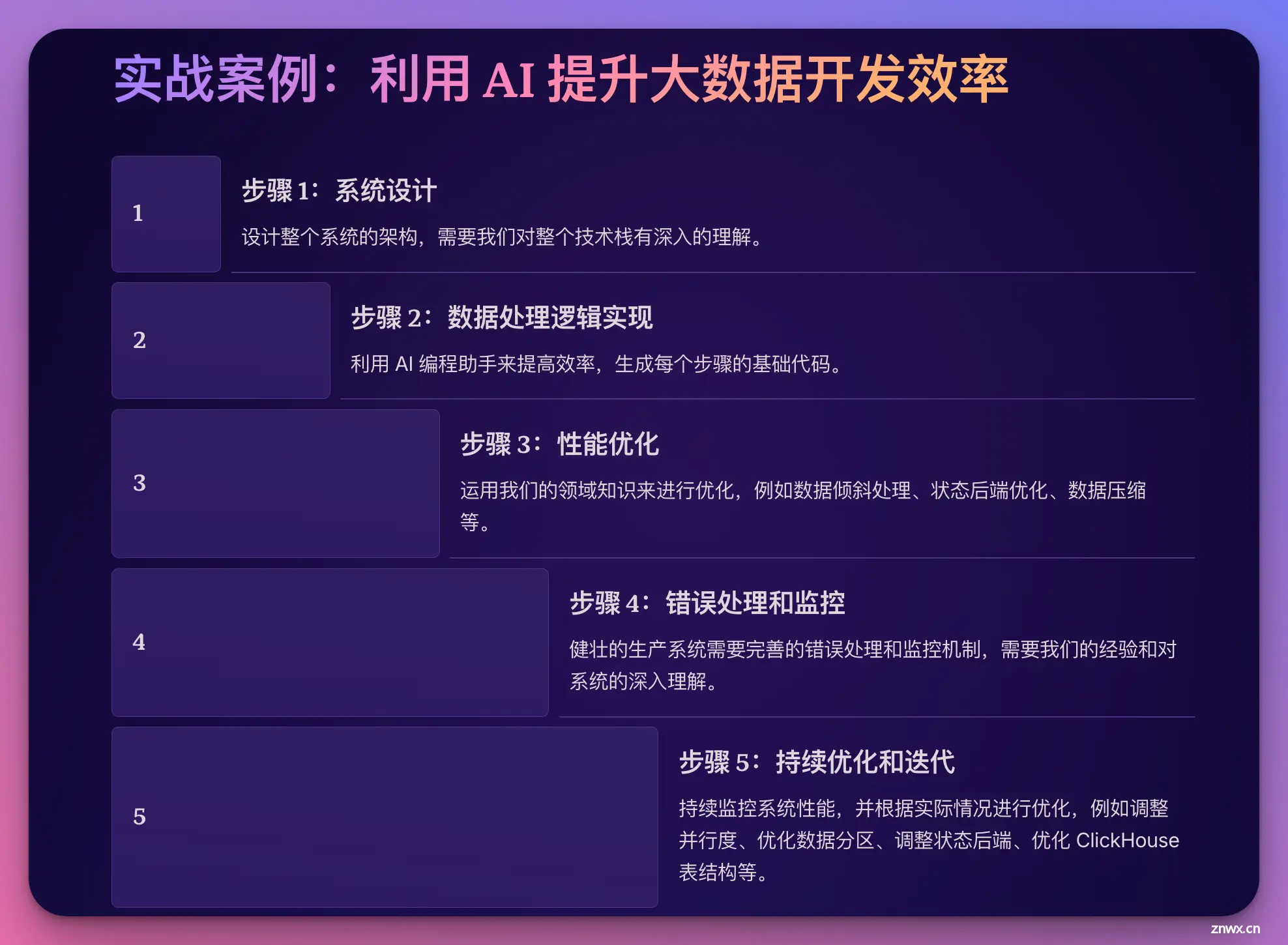

实战案例:利用 AI 提升大数据开发效率

让我们通过一个实际的大数据开发案例来看看如何在 AI 时代提升工作效率和价值。

假设我们需要开发一个实时数据处理系统,用于分析电商平台的用户行为数据。这个系统需要处理海量的点击流数据,实时计算各种指标,并为推荐系统提供数据支持。

步骤 1:系统设计

首先,我们需要设计整个系统的架构。这是 AI 难以替代的部分,需要我们对整个技术栈有深入的理解。

<code>[用户行为数据] -> [Kafka] -> [Flink] -> [ClickHouse] -> [API服务]

^ | ^

| v |

[日志收集] [Redis] [离线数据仓库]

这个架构包括:

使用 Kafka 作为消息队列,接收实时的用户行为数据使用 Flink 进行实时数据处理使用 ClickHouse 作为实时数据存储,支持快速的分析查询使用 Redis 缓存热点数据构建离线数据仓库用于深度分析和模型训练

步骤 2:数据处理逻辑实现

接下来,我们需要实现核心的数据处理逻辑。这里我们可以利用 AI 编程助手来提高效率。

首先,我们定义数据处理的主要步骤:

数据清洗和格式化会话划分用户行为分析实时指标计算

然后,我们可以使用 AI 助手来生成每个步骤的基础代码。例如,对于会话划分,我们可以这样使用 AI:

# 使用 Flink 实现会话划分逻辑

# 会话超时时间设为30分钟

AI 可能会生成如下代码:

from pyflink.datastream import StreamExecutionEnvironment

from pyflink.table import StreamTableEnvironment, DataTypes

from pyflink.table.expressions import col

from pyflink.table.window import Session

env = StreamExecutionEnvironment.get_execution_environment()

t_env = StreamTableEnvironment.create(env)

# 假设我们已经有了一个用户行为数据流

user_behavior = t_env.from_path("user_behavior")

# 定义会话窗口

session_window = Session.with_gap("30.minutes")

# 应用会话窗口并计算会话指标

session_metrics = user_behavior \

.window(session_window.on(col("event_time")).alias("w")) \

.group_by(col("user_id"), col("w")) \

.select(

col("好的,我们继续完成这个实战案例的内容。

```python

col("user_id"),

col("w").start.alias("session_start"),

col("w").end.alias("session_end"),

col("event_type").count.alias("event_count")

)

# 将结果写入 ClickHouse

session_metrics.execute_insert("clickhouse_sessions")

这段代码展示了如何使用 Flink 的 Table API 来实现会话划分。AI 生成的代码为我们提供了一个很好的起点,但作为经验丰富的大数据开发工程师,我们需要进一步优化和完善这个实现。

步骤 3:性能优化

生成的代码可能在处理大规模数据时存在性能问题。这时,我们需要运用我们的领域知识来进行优化。例如:

数据倾斜处理:对于热门用户,可能会导致数据倾斜。我们可以实现一个两阶段的聚合策略:

from pyflink.datastream import StreamExecutionEnvironment

from pyflink.table import StreamTableEnvironment, DataTypes

from pyflink.table.expressions import col

from pyflink.table.window import Session

env = StreamExecutionEnvironment.get_execution_environment()

t_env = StreamTableEnvironment.create(env)

# 假设我们已经有了一个用户行为数据流

user_behavior = t_env.from_path("user_behavior")

# 定义会话窗口

session_window = Session.with_gap("30.minutes")

# 第一阶段:局部聚合

local_agg = user_behavior \

.window(session_window.on(col("event_time")).alias("w")) \

.group_by(col("user_id"), col("w")) \

.select(

col("user_id"),

col("w").start.alias("session_start"),

col("w").end.alias("session_end"),

col("event_type").count.alias("event_count")

)

# 第二阶段:全局聚合

global_agg = local_agg \

.window(session_window.on(col("session_start")).alias("global_w")) \

.group_by(col("user_id"), col("global_w")) \

.select(

col("user_id"),

col("global_w").start.alias("session_start"),

col("global_w").end.alias("session_end"),

col("event_count").sum.alias("total_event_count")

)

# 将结果写入 ClickHouse

global_agg.execute_insert("clickhouse_sessions")

状态后端优化:对于长时间运行的 Flink 作业,合适的状态后端配置至关重要。我们可以使用 RocksDB 状态后端来处理大规模状态:

from pyflink.datastream import StreamExecutionEnvironment

from pyflink.datastream.state_backend import RocksDBStateBackend

env = StreamExecutionEnvironment.get_execution_environment()

# 设置 RocksDB 状态后端

rocks_db_state_backend = RocksDBStateBackend("hdfs://namenode:40010/flink/checkpoints", True)

env.set_state_backend(rocks_db_state_backend)

# 设置检查点间隔

env.enable_checkpointing(60000) # 60 seconds

数据压缩:在数据传输和存储过程中使用压缩可以显著减少网络和磁盘 I/O:

# Flink 配置

env.get_config().set_string("taskmanager.memory.framework.off-heap.size", "128mb")

env.get_config().set_string("taskmanager.memory.task.off-heap.size", "800mb")

env.get_config().set_string("state.backend.rocksdb.memory.managed", "true")

env.get_config().set_string("state.backend.rocksdb.memory.fixed-per-slot", "128mb")

# ClickHouse 写入配置

clickhouse_sink = ClickHouseSink.builder() \

.set_host("clickhouse-server") \

.set_database("events") \

.set_table("sessions") \

.set_write_local("true") \

.set_compression_codec("ZSTD") \

.build()

global_agg.add_sink(clickhouse_sink)

步骤 4:错误处理和监控

健壮的生产系统需要完善的错误处理和监控机制。这是 AI 难以全面考虑的方面,需要我们的经验和对系统的深入理解:

from pyflink.datastream import StreamExecutionEnvironment

from pyflink.datastream.connectors import FlinkKafkaConsumer, FlinkKafkaProducer

from pyflink.common.serialization import SimpleStringSchema

env = StreamExecutionEnvironment.get_execution_environment()

# 配置错误处理

env.get_config().set_restart_strategy("fixed-delay", { "restart-attempts": 3, "delay-between-attempts": 10000})

# 配置 Kafka 消费者

kafka_consumer = FlinkKafkaConsumer(

"user_behavior",

SimpleStringSchema(),

{ "bootstrap.servers": "kafka:9092", "group.id": "flink-consumer-group"}

)

kafka_consumer.set_start_from_latest()

# 配置死信队列

dead_letter_producer = FlinkKafkaProducer(

"dead_letter_queue",

SimpleStringSchema(),

{ "bootstrap.servers": "kafka:9092"}

)

# 主数据处理逻辑

data_stream = env.add_source(kafka_consumer)

# 添加监控和告警逻辑

data_stream = data_stream \

.map(process_event) \

.map(lambda x: x, output_type=Types.STRING()) \

.add_sink(dead_letter_producer).name("Dead Letter Queue")

# 添加性能指标收集

data_stream = data_stream \

.map(collect_metrics) \

.add_sink(metrics_sink).name("Metrics Sink")

# 主要业务逻辑处理

result = data_stream \

.key_by(lambda x: x['user_id']) \

.window(TumblingEventTimeWindows.of(Time.minutes(5))) \

.apply(WindowFunction())

result.add_sink(clickhouse_sink)

env.execute("User Behavior Analysis Job")

这个优化后的实现考虑了错误处理、监控和性能优化等关键因素,这些都是 AI 难以全面考虑的方面。

步骤 5:持续优化和迭代

在实际生产环境中,我们需要持续监控系统性能,并根据实际情况进行优化。这可能包括:

调整并行度:根据数据量和集群资源动态调整任务的并行度。优化数据分区:根据数据特征选择合适的分区策略,以提高处理效率。调整状态后端:根据状态大小和访问模式选择合适的状态后端。优化 ClickHouse 表结构:根据查询模式优化表结构和索引。

例如,我们可以实现一个动态调整并行度的逻辑:

from pyflink.datastream import StreamExecutionEnvironment

from pyflink.common import WatermarkStrategy, Time

from pyflink.datastream.functions import RuntimeContext, MapFunction

class DynamicParallelism(MapFunction):

def __init__(self):

self.value_state = None

def open(self, runtime_context: RuntimeContext):

self.value_state = runtime_context.get_state(ValueStateDescriptor("count", Types.LONG()))

def map(self, value):

count = self.value_state.value()

if count is None:

count = 0

count += 1

self.value_state.update(count)

# 每处理1百万条记录,检查一次是否需要调整并行度

if count % 1_000_000 == 0:

current_parallelism = self.get_parallelism()

target_parallelism = self.calculate_target_parallelism(count)

if target_parallelism != current_parallelism:

self.set_parallelism(target_parallelism)

return value

def calculate_target_parallelism(self, count):

# 根据处理的记录数计算目标并行度

# 这里的逻辑需要根据实际情况进行调整

return min(max(1, count // 10_000_000), 100)

env = StreamExecutionEnvironment.get_execution_environment()

data_stream = env.add_source(kafka_consumer)

data_stream = data_stream \

.assign_timestamps_and_watermarks(

WatermarkStrategy.for_bounded_out_of_orderness(Time.seconds(5))

) \

.map(DynamicParallelism())

# 后续处理逻辑...

env.execute("Dynamic Parallelism Job")

这个例子展示了如何实现动态调整并行度的逻辑,这是一个需要深入理解系统行为和性能特征的高级优化技巧。

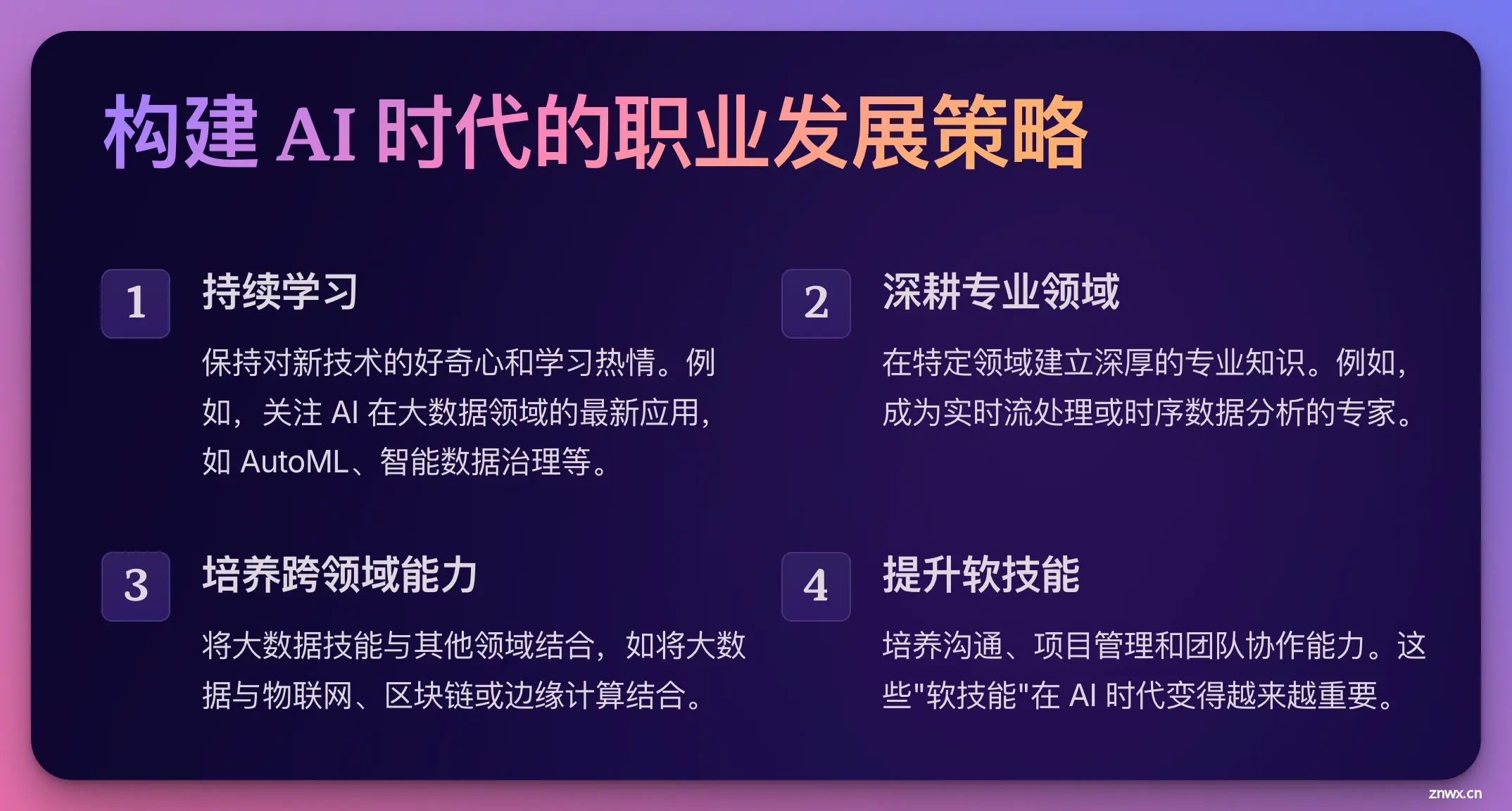

构建 AI 时代的职业发展策略

面对 AI 带来的变革,我们需要制定清晰的职业发展策略:

持续学习:保持对新技术的好奇心和学习热情。例如,关注 AI 在大数据领域的最新应用,如 AutoML、智能数据治理等。

深耕专业领域:在特定领域建立深厚的专业知识。例如,成为实时流处理或时序数据分析的专家。

培养跨领域能力:将大数据技能与其他领域结合,如将大数据与物联网、区块链或边缘计算结合。

提升软技能:培养沟通、项目管理和团队协作能力。这些"软技能"在 AI 时代变得越来越重要。

参与开源社区:通过参与开源项目,既可以提升技术能力,也可以扩展职业网络。

关注商业价值:学会将技术创新与业务价值联系起来,提升自己在组织中的价值。

实践 AI 辅助编程:学习如何有效地使用 AI 编程助手,将其作为提高生产力的工具,而不是威胁。

结语:拥抱变革,引领未来

AI 时代的到来并不意味着程序员的末日,而是一个重新定义自我价值的机会。通过不断学习、深化专业知识、培养跨领域能力和提升软技能,我们可以在这个充满机遇和挑战的新时代中茁壮成长。

记住,AI 是强大的工具,但它仍然需要人类的创造力、洞察力和判断力来发挥最大价值。作为程序员,我们的角色正在从简单的代码编写者转变为复杂系统的设计者、问题的解决者和创新的推动者。

让我们以开放和积极的态度拥抱这些变化,将 AI 视为助力我们提升效率、释放创造力的工具。通过不断学习和适应,我们不仅能在 AI 时代保持竞争力,还能成为这场技术革命的引领者。

未来属于那些能够与 AI 和谐共处、善用 AI 提升自身价值的人。让我们携手共创这个激动人心的 AI 新时代!

声明

本文内容仅代表作者观点,或转载于其他网站,本站不以此文作为商业用途

如有涉及侵权,请联系本站进行删除

转载本站原创文章,请注明来源及作者。