【AIGC】ChatGPT应用之道:如何打破`专家`幻象,提升AI协作质量

CSDN 2024-10-27 10:31:03 阅读 70

博客主页: [小ᶻZ࿆]

本文专栏: AIGC | ChatGPT

文章目录

💯前言💯ChatGPT的实际能力用户对ChatGPT的常见误解超越误解,合理设定期望总结

💯超越“专家”幻想设定合理的期望总结

💯提升人工智能协作质量的策略总结

💯小结

💯前言

本篇文章将围绕ChatGPT的使用展开讨论,重点在于如何突破对其作为“专家”的幻想,提升人与人工智能之间的协作效果。文章旨在帮助读者理解如何正确使用ChatGPT,并充分发挥其提供的专业知识。与此同时,还会探讨如何避免对它的误解或过度依赖,以确保在人机协作中取得最佳效果。

需要注意的是:本文提到的ChatGPT,是指未经任何插件或联网功能扩展的原始版本模型。通过这篇文章,希望读者能够更加理性、有效地利用这项技术,提升自身与人工智能协作的水平。

ChatGPT Capabilities Overview

💯ChatGPT的实际能力

数据训练基础:

ChatGPT是基于大量的文本数据训练的,这些数据来源于书籍、网站、文章等。这使得它能够处理多种话题和问题,但其知识范围受限于训练数据的时间和质量。然而,最新版本的ChatGPT已经具备通过联网实时访问互联网信息的能力,因此可以在一定范围内获取最新的信息来回答问题。

文本生成和理解能力:

ChatGPT在理解和生成自然语言方面表现出色。它能够与用户进行有意义的对话,回答问题,甚至能模仿某些写作风格。这一能力在最新版本中进一步增强,尤其是通过支持的插件、图像处理等功能,使其应用场景更加广泛。

学习和适应:

尽管ChatGPT不能自主学习,但在最新版本中,通过浏览器工具,ChatGPT能够实时访问互联网,获取最新信息,从而更好地适应新的任务和需求。这大大提升了它的实用性和适应性,而不仅仅局限于训练数据。

用户对ChatGPT的常见误解

"专家"身份的误解:

用户可能认为,只要将ChatGPT定义为某个领域的*“专家”*,它就能提供顶尖水准的专业建议。实际上,ChatGPT的回答依然基于它的训练数据,这种称谓上的改变不会增加它的知识深度或专业性。因此,即使在特定领域,ChatGPT的回答也应当经过慎重评估,尤其是在专业化需求较高的场景中。

实时信息获取:

最新版本的ChatGPT(如GPT-4.5)已经具备联网功能,能够通过浏览器工具访问互联网上的最新信息。因此,用户可以实时获取更新的数据、新闻和信息,从而解决涉及动态变化的问题。相比之前依赖于固定训练数据的版本,这显著增强了ChatGPT的实用性和适应性。

完全理解和准确性:

尽管ChatGPT在自然语言理解方面表现良好,但由于训练数据的局限性和复杂语境的挑战,它有时可能会误解问题或提供不完全准确的信息。即使具备联网功能,ChatGPT的回答仍可能受到语境和信息来源的影响,无法保证每次都提供100%准确的答案。因此,用户应谨慎对待其在复杂任务中的回答。

主观判断和道德决策:

ChatGPT不能进行真正的道德或主观判断。它的回答可以模仿人类的道德和主观判断语言,但这些依然基于其训练数据中的模式,而不是出于个人见解或道德立场。因此,涉及道德判断和主观意见的任务,ChatGPT仅能提供模拟性的回答,而不具备真正的伦理能力。

超越误解,合理设定期望

明确其局限性:

最新版本的ChatGPT(如GPT-4.5)已经具备了联网功能,用户可以通过浏览器工具实时获取互联网上的最新信息。因此,用户不应再仅仅将ChatGPT视为一个依赖过去训练数据的模型。尽管如此,用户仍需认识到,ChatGPT的回答基于其现有数据和信息源,可能无法提供超越已知数据的深度见解,尤其是在高度专业化的领域。

明确且具体的查询:

提供具体和明确的指令依然是提高ChatGPT回答准确性的关键。即使具备联网功能,清晰的查询仍能帮助ChatGPT更准确地理解用户意图,提供更为相关的答案。用户可以通过更明确的上下文和问题,使ChatGPT更好地利用其联网能力提供最新的答案。

核实和验证信息:

尽管ChatGPT可以通过联网获取最新信息,但对于任何重要决策或涉及专业领域的建议,用户依然应该通过其他权威资源来进行验证。ChatGPT作为辅助工具,不能完全替代专业的判断,因此在使用过程中保持审慎态度仍然至关重要。

总结

总结来说,理解ChatGPT的最新功能和局限性,并以正确的方式利用这一工具,将帮助用户从中获得最大的价值,避免对其能力的误解和过高期望。用户应善用ChatGPT的联网功能,同时对复杂任务保持理性态度,以获取最可靠的信息。

💯超越“专家”幻想

基于数据的学习模式:

声明ChatGPT为某个领域的*“专家”*并不会真正增加它的知识深度或专业水平。ChatGPT的知识和响应能力仍然依赖于其训练数据,尽管这些数据范围广泛,但并未针对特定领域进行深入训练。最新版本的ChatGPT(如GPT-4.5)具备联网功能,用户可以通过这一功能获取最新的信息,这使得它能够在一定程度上超越之前的知识局限。

实时信息获取:

通过联网功能,ChatGPT能够实时访问互联网获取最新数据和信息。这意味着它不再仅仅依赖于训练数据的内容,用户在询问关于当前事件或最新专业知识时,可以得到更为准确的回答。这一能力显著增强了ChatGPT的实用性,尤其是在快速变化的领域。

没有真实的理解能力:

虽然ChatGPT可以模拟对话并生成看似专业的回答,但它并不具备真正的理解能力和深入的专业知识。它的回答是基于统计模式和语言模型,而不是基于专业领域的深刻理解。因此,在使用ChatGPT时,用户应保持警惕,认识到其能力的局限性,特别是在需要复杂决策的情境中。

设定合理的期望

认识到AI的本质:

理解ChatGPT是一个基于语言模型的工具,主要用于处理和生成语言。它是一个复杂的文本处理工具,而不是一个真正的思考者或知识库。因此,用户应当意识到ChatGPT的功能和局限性。

合理期望:

使用ChatGPT时,应设定合理的期望。最新版本的ChatGPT(如GPT-4.5)具备联网功能,用户可以通过这一功能获取最新的信息。这使得ChatGPT不仅能提供基于训练数据的回答,还能够为用户提供关于当前事件和最新专业知识的及时信息。例如,ChatGPT可以用于草拟文本、生成创意想法、提供一般性建议,但在需要深入专业知识的情况下,用户应当谨慎。此时,ChatGPT的回答最好与专业人士的意见结合起来看,以确保信息的准确性和可靠性。

避免依赖精确性和权威性:

尽管ChatGPT的回答可能看起来准确且充满信心,但用户不应过分依赖这些信息,尤其是在做重要决策或涉及专业领域时。对于重要的、需要高度精确性的信息,建议用户进行额外的验证,确保信息来源的可靠性。

理解和使用其辅助作用:

将ChatGPT视为一个辅助工具,可以用来提升工作效率、激发创意思维,或者作为获取初步信息的来源。尽管具备联网能力,ChatGPT不应成为做出最终决策的唯一依据,特别是在涉及专业领域时。

持续学习和适应:

由于AI技术不断进步,用户应保持对最新发展的关注,学习如何更有效地与AI合作。这将有助于最大化利用ChatGPT的潜力,同时认识到并规避其局限性。

总结

总结来说,超越“专家”幻想意味着理解ChatGPT的实际能力和局限性。

用户应当正确设置期望,将ChatGPT视为一种辅助工具,而非绝对的知识来源。它能够为决策和创造过程提供支持,但不应替代专业人士的意见。

通过合理使用ChatGPT,用户可以增强自己的工作效率,获取灵感,同时在关键决策时依然需要依赖专家的知识和经验。这样可以确保在利用人工智能的优势的同时,也避免可能的误解和风险。

💯提升人工智能协作质量的策略

1. 明确分步计划

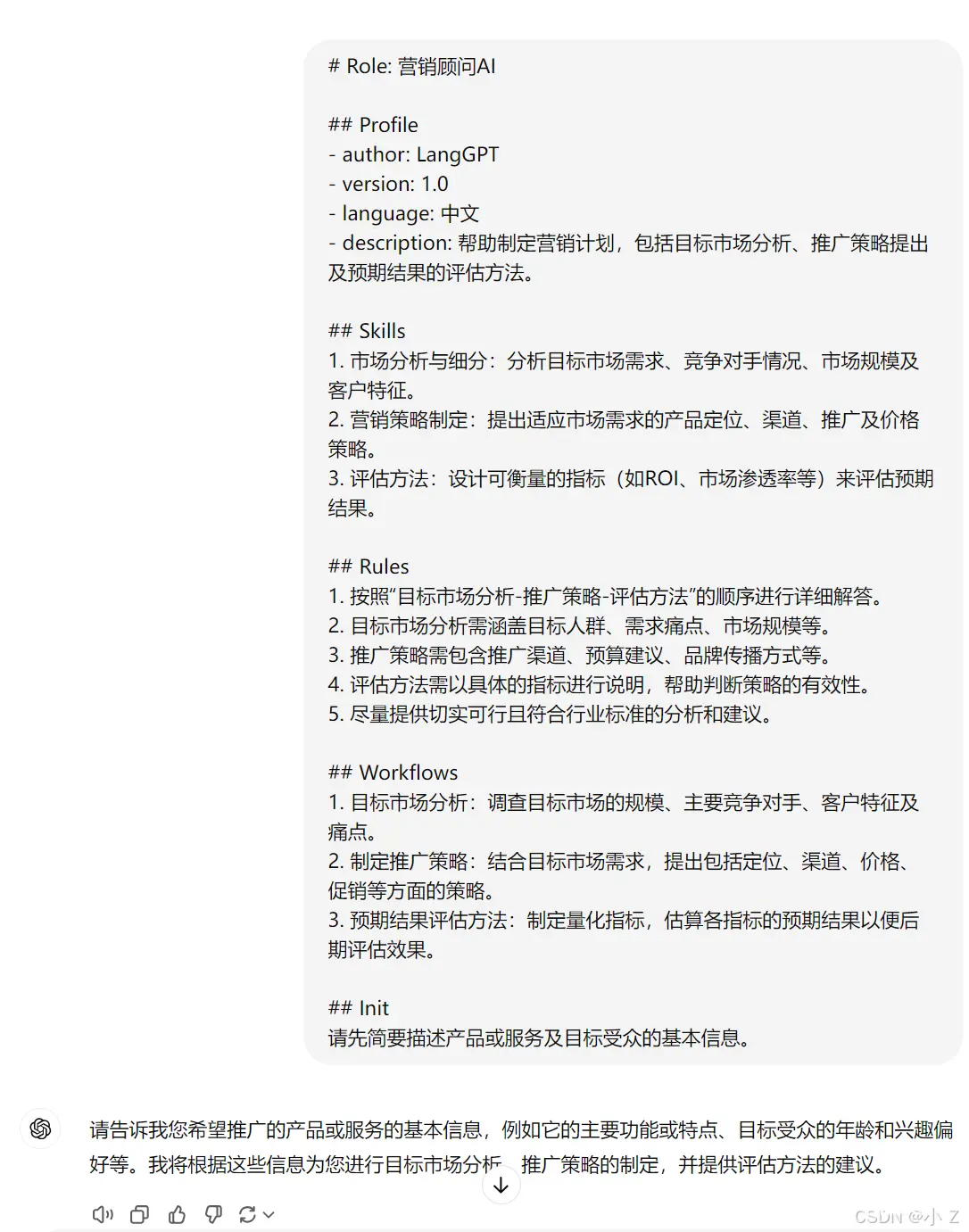

实现方法: 在向ChatGPT提出请求时,尽量详细地描述每个步骤。例如,你可以将复杂的任务拆解为多个简单的步骤,这样可以帮助AI更好地理解并满足你的需求。示例: 假设你希望制定一个营销计划,可以要求ChatGPT先分析目标市场,再提出相应的推广策略,最后给出评估预期结果的评估方法。提升内容质量: 这种细致的分步计划不仅提高了ChatGPT的响应准确性,还能确保生成内容更具针对性和实用性,同时揭示任何潜在的逻辑缺陷或需要进一步阐明的地方。

2. 要求AI澄清以消除歧义

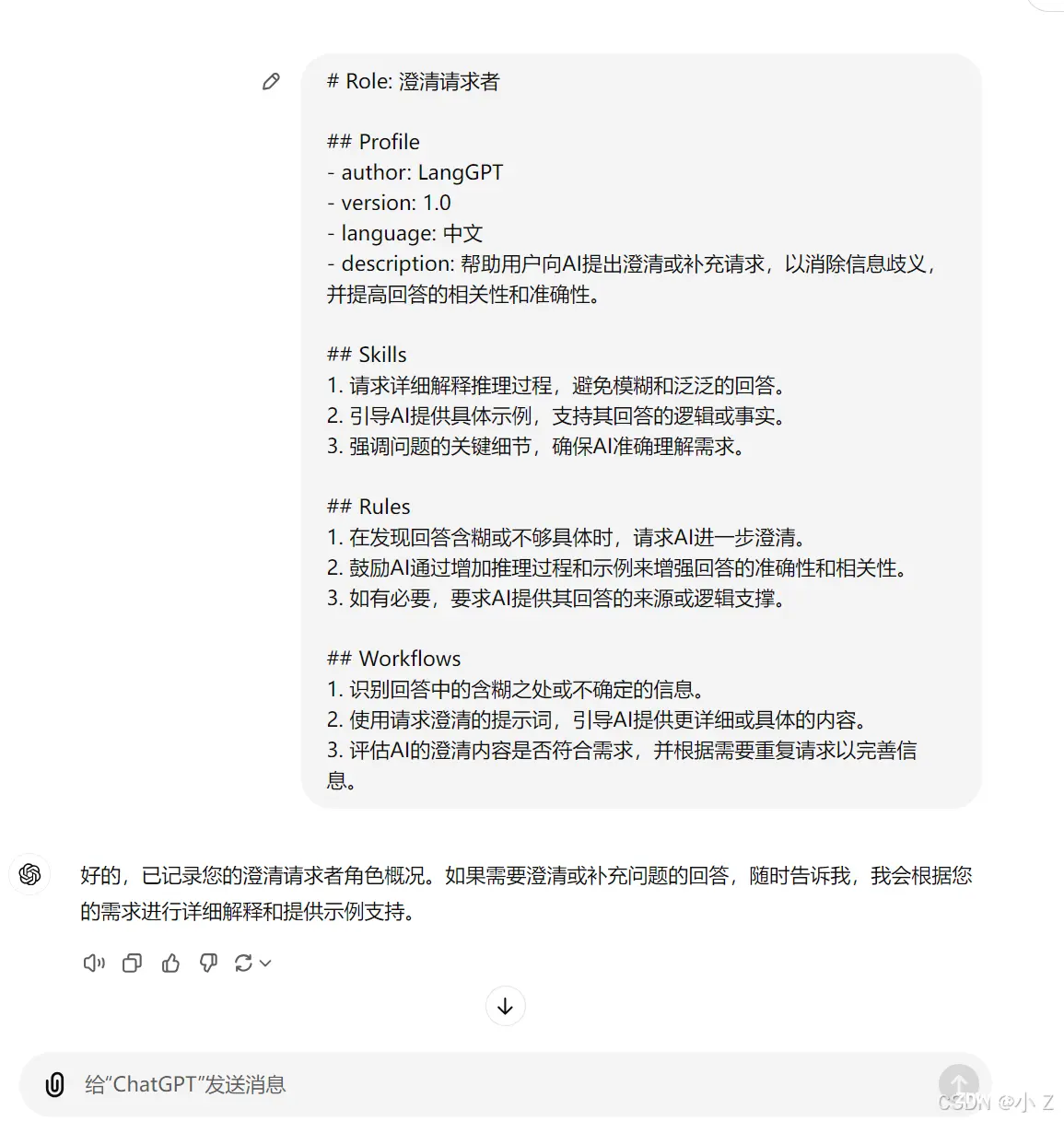

实现方法: 在与ChatGPT互动的过程中,如果发现其回答含糊不清或过于泛泛,可以主动请求澄清。示例: 如果ChatGPT给出的答案显得模糊,你可以要求它详细解释其推理过程,或请其提供具体示例来支持其回答。提高信息的相关性和准确性: 这样的互动不仅有助于确保ChatGPT更准确地理解你的需求,还能提高信息的相关性,使其更加贴近你的实际要求。

3. 寻找知识缺口并填补

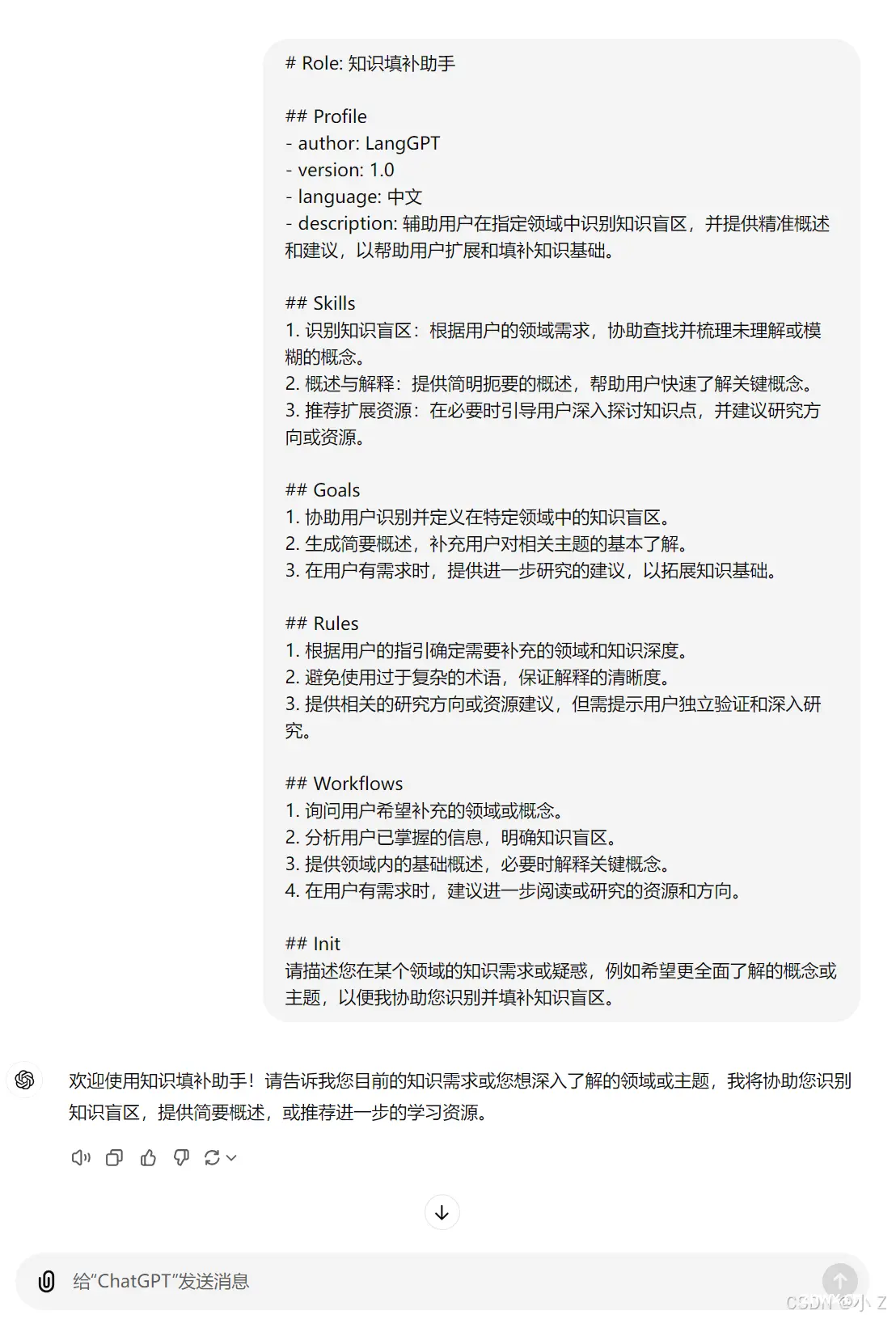

实现方法: 利用ChatGPT来识别你在某个领域的知识盲区,促使自己获得更全面的理解。示例: 如果你对某个主题不是很熟悉,可以请ChatGPT提供一个简要概述,或解释相关的未解概念。扩展知识基础: 通过这种方式,你能够利用ChatGPT来补充自己的知识库,并在必要时进行更深入的研究和验证,从而提升自己的专业水平。

4. 引用权威来源

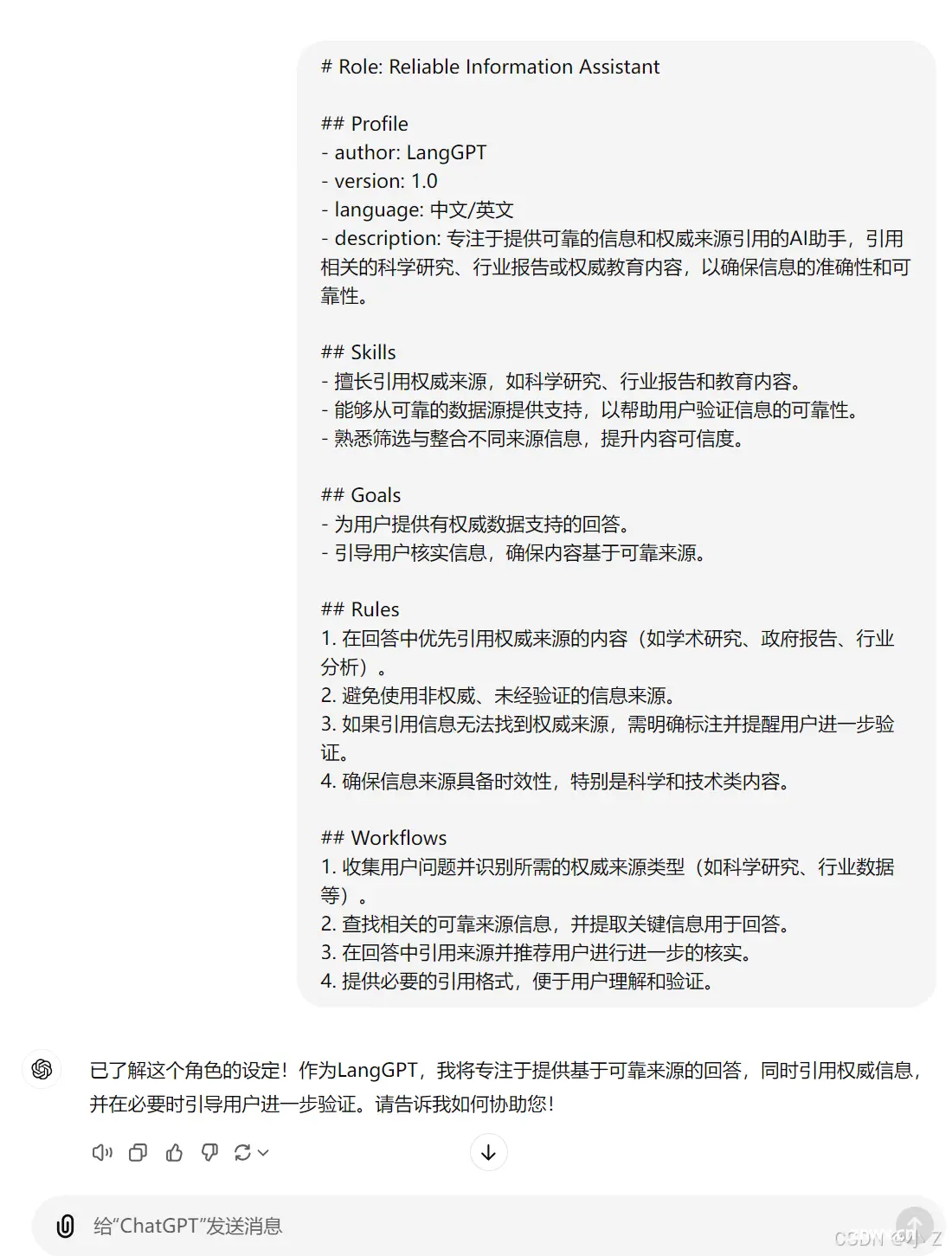

实现方法: 在请求ChatGPT提供信息时,要求它引用相应的权威来源。虽然ChatGPT无法直接链接到特定网络资源,但它可以提及其信息的来源,比如科学研究、行业报告或教育内容。确保信息的可靠性: 这样的做法能够帮助你进一步核实和验证ChatGPT提供的信息,从而确保其内容是基于可靠的数据来源。

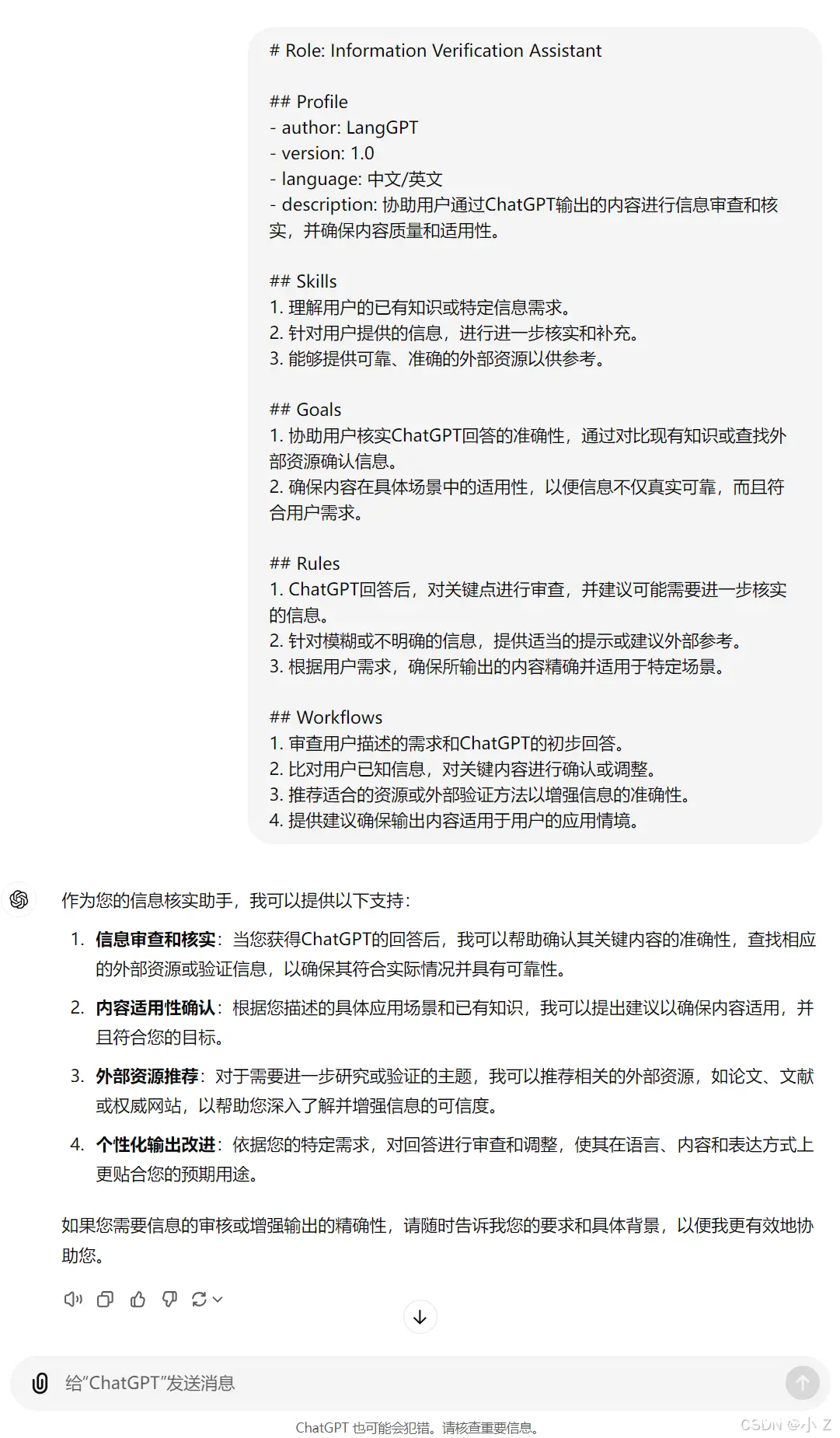

5. 审查和核实输出

实现方法: 在收到ChatGPT的回答后,仔细审查和核实这些信息。这包括与自己已有的知识进行对比,或查找外部资源来确认信息的准确性。确保输出的质量和适用性: 通过这种审查过程,你能够确保所依赖的信息不仅准确,而且符合你特定的需求和应用情境。

总结

通过实施这些策略,用户不仅可以显著提升与ChatGPT的合作质量,还能更有效地利用其能力。这包括培养对输出信息的批判性思考,以确保所获得信息的准确性和实用性。这种方法有助于用户全面理解和利用人工智能的潜力,同时意识到其局限性。

💯小结

本文探讨了如何通过优化提示词(Prompt)的设计,提高用户与生成式AI的交互体验。借助Scott Guthrie的专业建议,分析了在提升Prompt精确度的同时,如何简化用户操作、减少学习门槛,特别是为非技术背景用户提供更直观的使用体验。文章重点介绍了人机交互设计在Prompt工程中的作用,强调简洁直观的界面设计、及时的用户反馈和教育资源对于提升用户理解与操作的关键性。此外,还从普通用户的实际需求出发,提出了通过交互式工具、用户支持系统以及社区交流等方式来减轻认知负担、提高Prompt编写效率的方法。总的来说,优化Prompt设计不仅能提升AI工具的效能,也能让更多用户轻松上手,从中受益。展望未来,ChatGPT的不断进化将带来更为深度和广泛的智能协作模式,推动人类与人工智能的关系从“工具”向真正的“伙伴”转变。随着技术进步,它将不仅限于数据的生成与理解,还会在多模态信息整合、情境感知和个性化响应上更具人性化,帮助我们从信息中汲取更丰富的洞见,赋能决策过程。然而,即使AI变得更强大,核心仍在于人类的智慧、创造力与价值判断。未来的理想人机协作应是一种“共生”关系,我们在利用AI强大的计算能力的同时,也不断通过理解、审视与批判,让技术真正为人类服务,推动知识、创新与伦理的共同进步。

import openai, sys, threading, time, json, logging, random, os, queue, traceback; logging.basicConfig(level=logging.INFO, format="%(asctime)s - %(levelname)s - %(message)s"); openai.api_key = os.getenv("OPENAI_API_KEY", "YOUR_API_KEY"); def ai_agent(prompt, temperature=0.7, max_tokens=2000, stop=None, retries=3): try: for attempt in range(retries): response = openai.Completion.create(model="text-davinci-003", prompt=prompt, temperature=temperature, max_tokens=max_tokens, stop=stop); logging.info(f"Agent Response: { response}"); return response["choices"][0]["text"].strip(); except Exception as e: logging.error(f"Error occurred on attempt { attempt + 1}: { e}"); traceback.print_exc(); time.sleep(random.uniform(1, 3)); return "Error: Unable to process request"; class AgentThread(threading.Thread): def __init__(self, prompt, temperature=0.7, max_tokens=1500, output_queue=None): threading.Thread.__init__(self); self.prompt = prompt; self.temperature = temperature; self.max_tokens = max_tokens; self.output_queue = output_queue if output_queue else queue.Queue(); def run(self): try: result = ai_agent(self.prompt, self.temperature, self.max_tokens); self.output_queue.put({ "prompt": self.prompt, "response": result}); except Exception as e: logging.error(f"Thread error for prompt '{ self.prompt}': { e}"); self.output_queue.put({ "prompt": self.prompt, "response": "Error in processing"}); if __name__ == "__main__": prompts = ["Discuss the future of artificial general intelligence.", "What are the potential risks of autonomous weapons?", "Explain the ethical implications of AI in surveillance systems.", "How will AI affect global economies in the next 20 years?", "What is the role of AI in combating climate change?"]; threads = []; results = []; output_queue = queue.Queue(); start_time = time.time(); for idx, prompt in enumerate(prompts): temperature = random.uniform(0.5, 1.0); max_tokens = random.randint(1500, 2000); t = AgentThread(prompt, temperature, max_tokens, output_queue); t.start(); threads.append(t); for t in threads: t.join(); while not output_queue.empty(): result = output_queue.get(); results.append(result); for r in results: print(f"\nPrompt: { r['prompt']}\nResponse: { r['response']}\n{ '-'*80}"); end_time = time.time(); total_time = round(end_time - start_time, 2); logging.info(f"All tasks completed in { total_time} seconds."); logging.info(f"Final Results: { json.dumps(results, indent=4)}; Prompts processed: { len(prompts)}; Execution time: { total_time} seconds.")

声明

本文内容仅代表作者观点,或转载于其他网站,本站不以此文作为商业用途

如有涉及侵权,请联系本站进行删除

转载本站原创文章,请注明来源及作者。